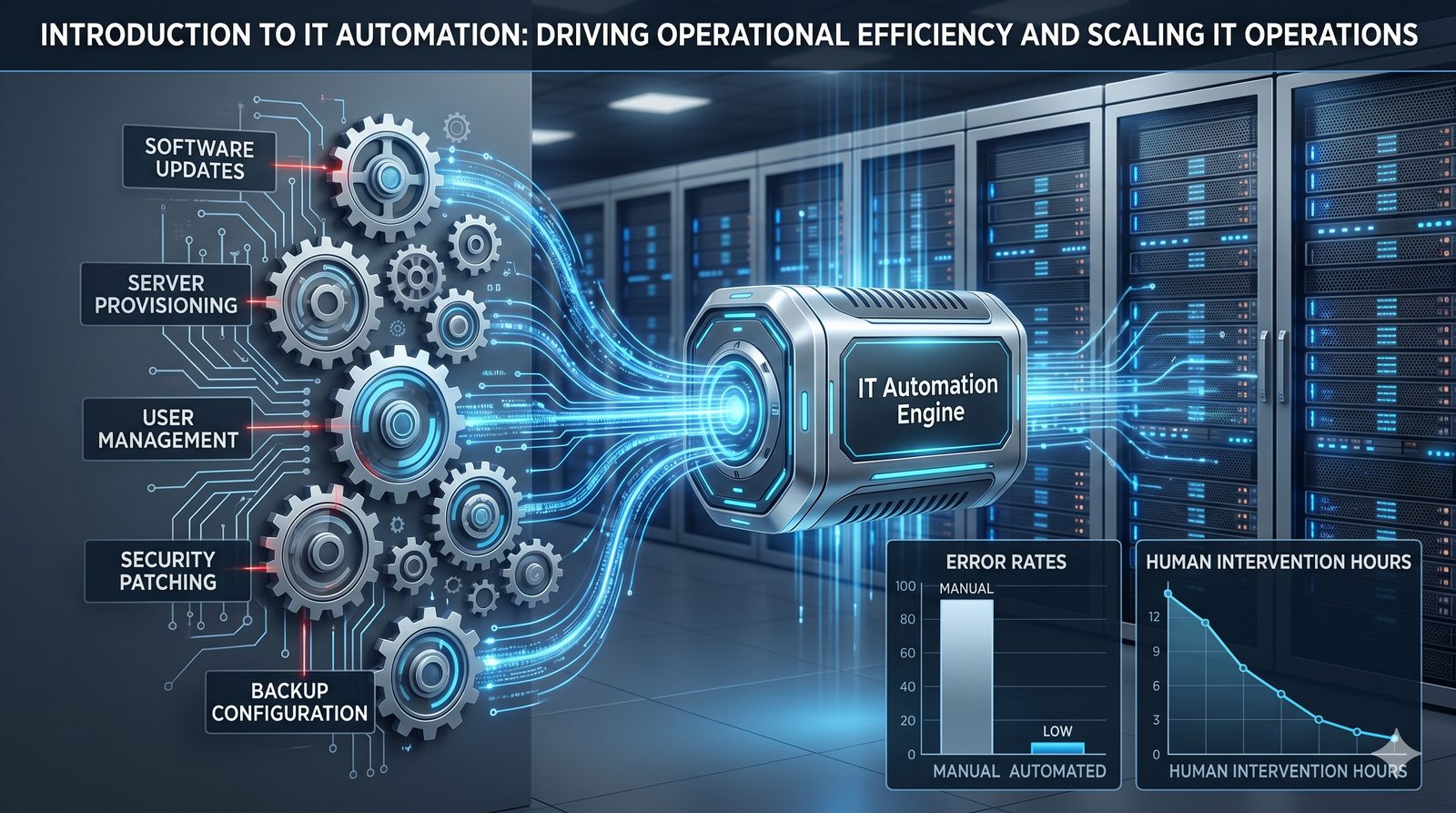

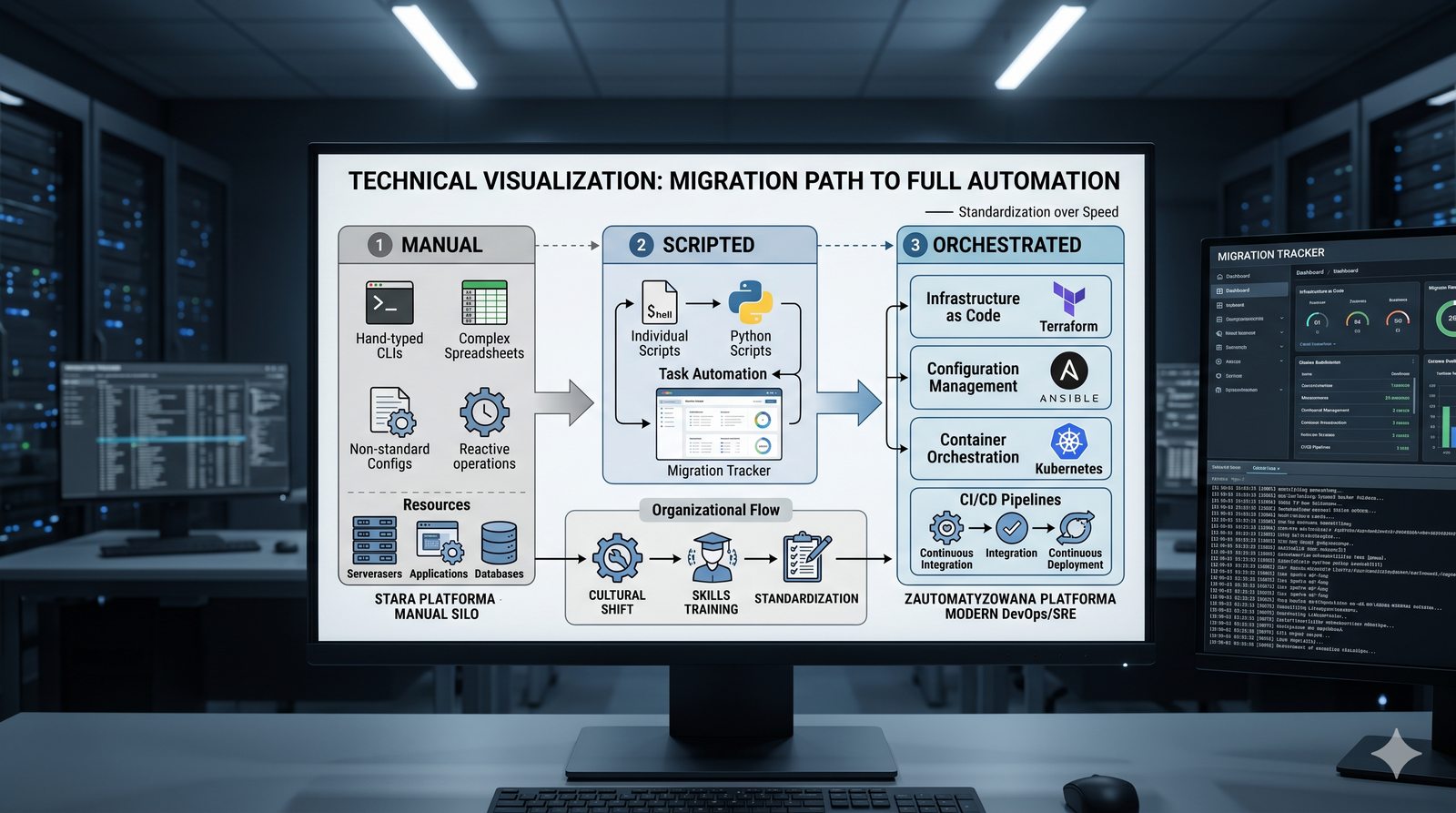

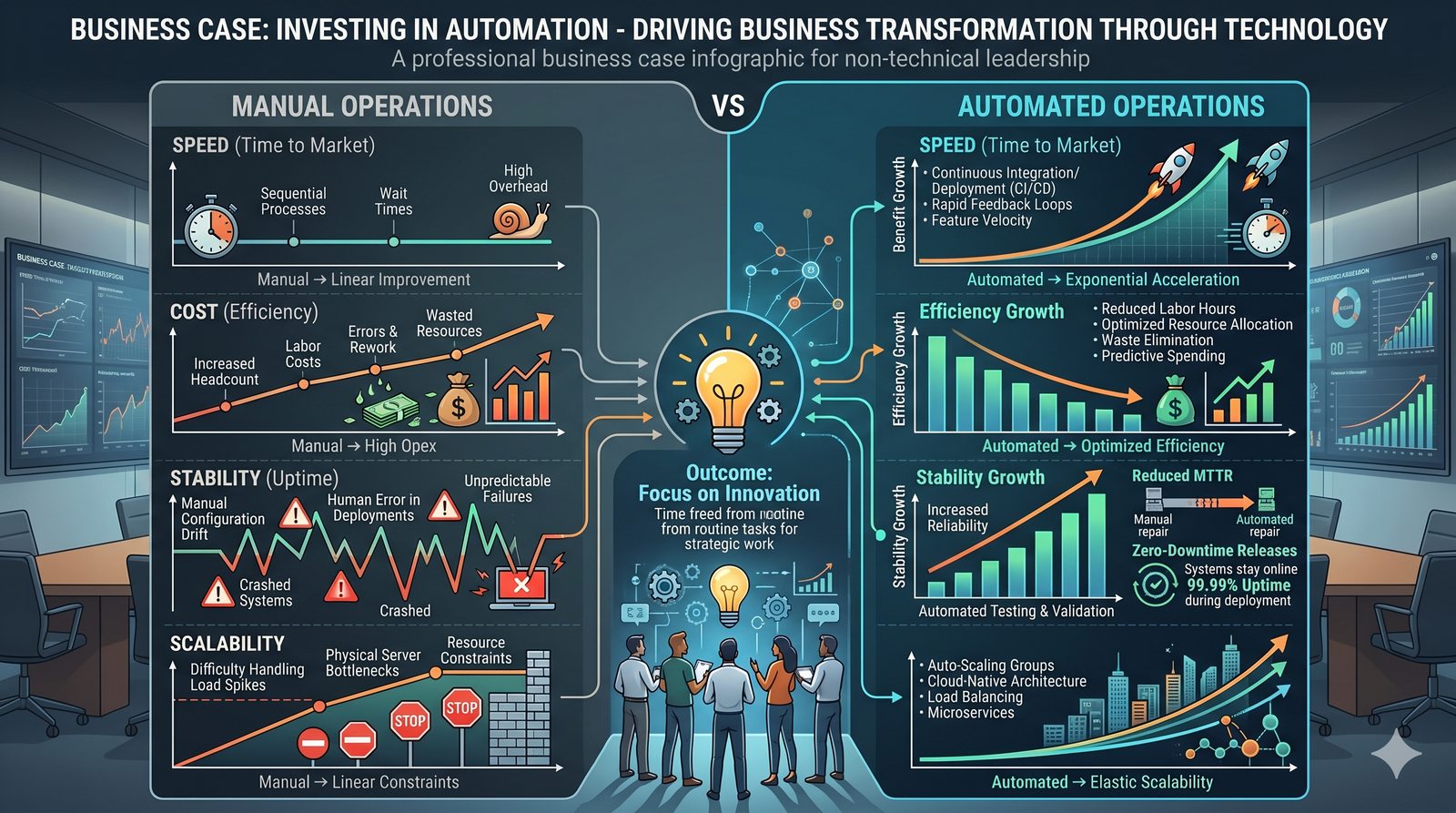

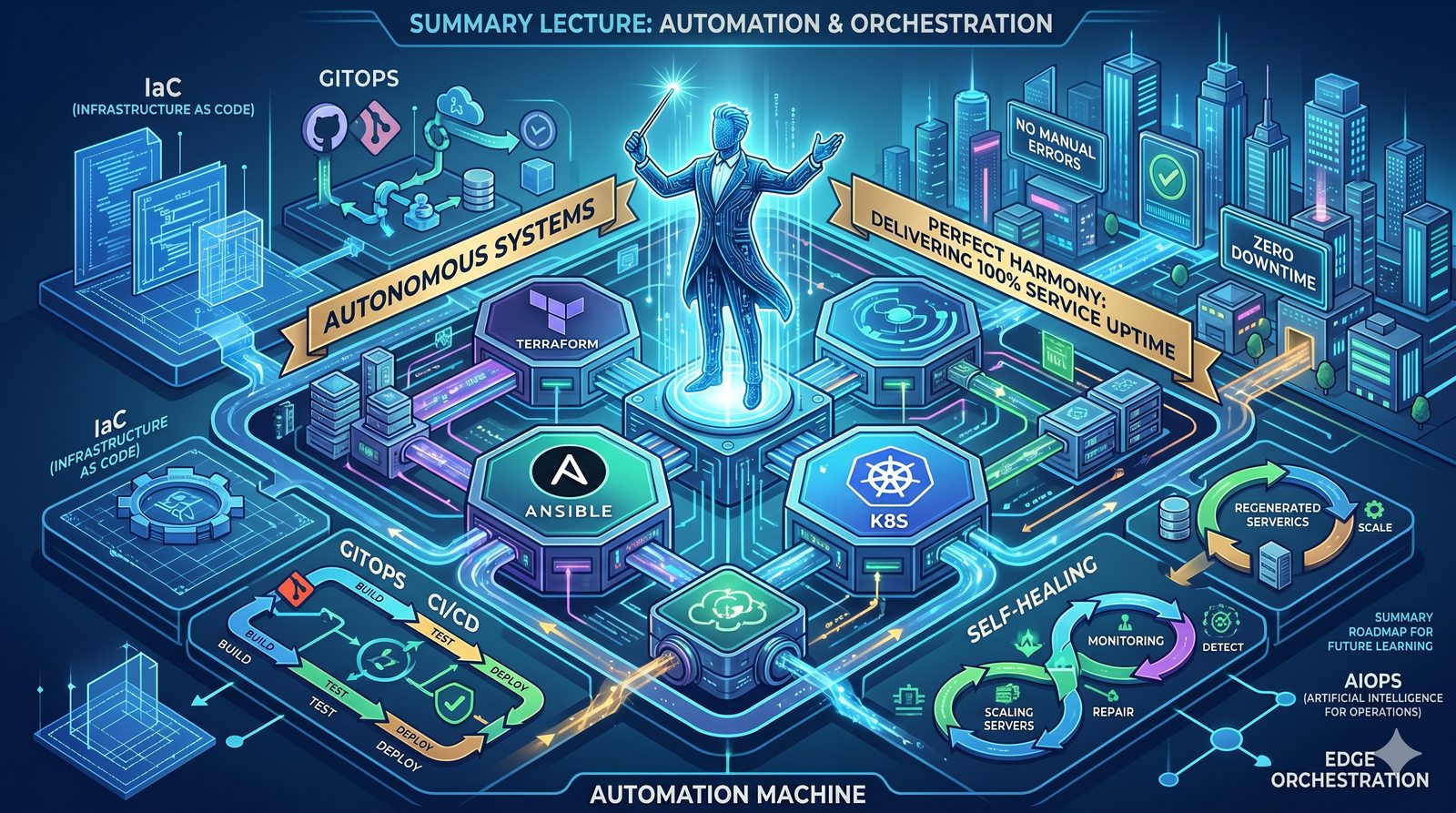

Automatyzacja w IT to wykorzystanie technologii do wykonywania powtarzalnych zadań i procesów bez interwencji człowieka. Jej celem jest zwiększenie efektywności, redukcja kosztów, a przede wszystkim minimalizacja ryzyka błędów ludzkich, które są nieuniknione przy ręcznym zarządzaniu złożonymi systemami. Automatyzacja przekształca operacje IT z reaktywnych w proaktywne, pozwalając inżynierom skupić się na zadaniach o wyższej wartości, takich jak projektowanie i optymalizacja, zamiast na gaszeniu pożarów i wykonywaniu żmudnych, powtarzalnych czynności.

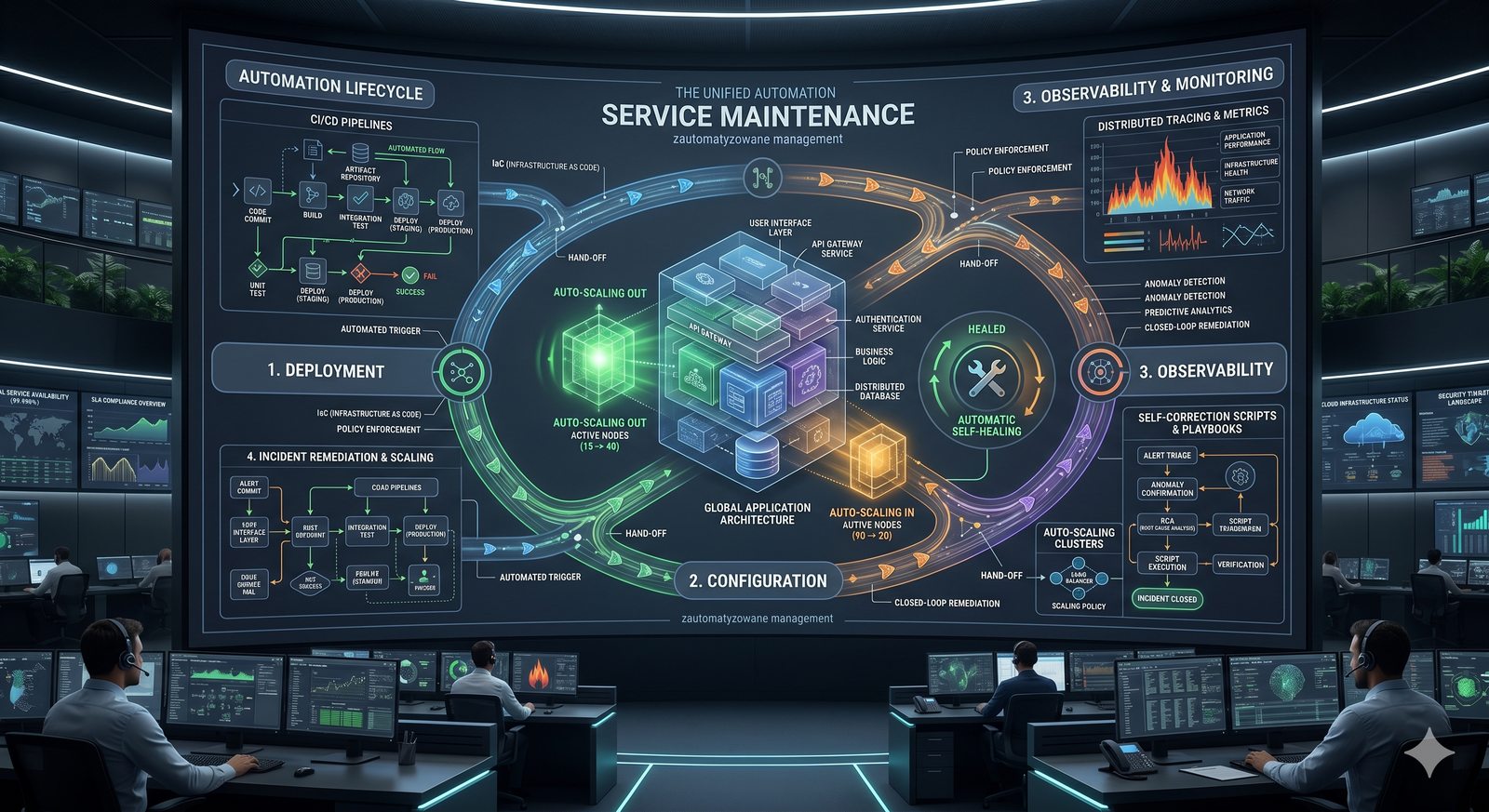

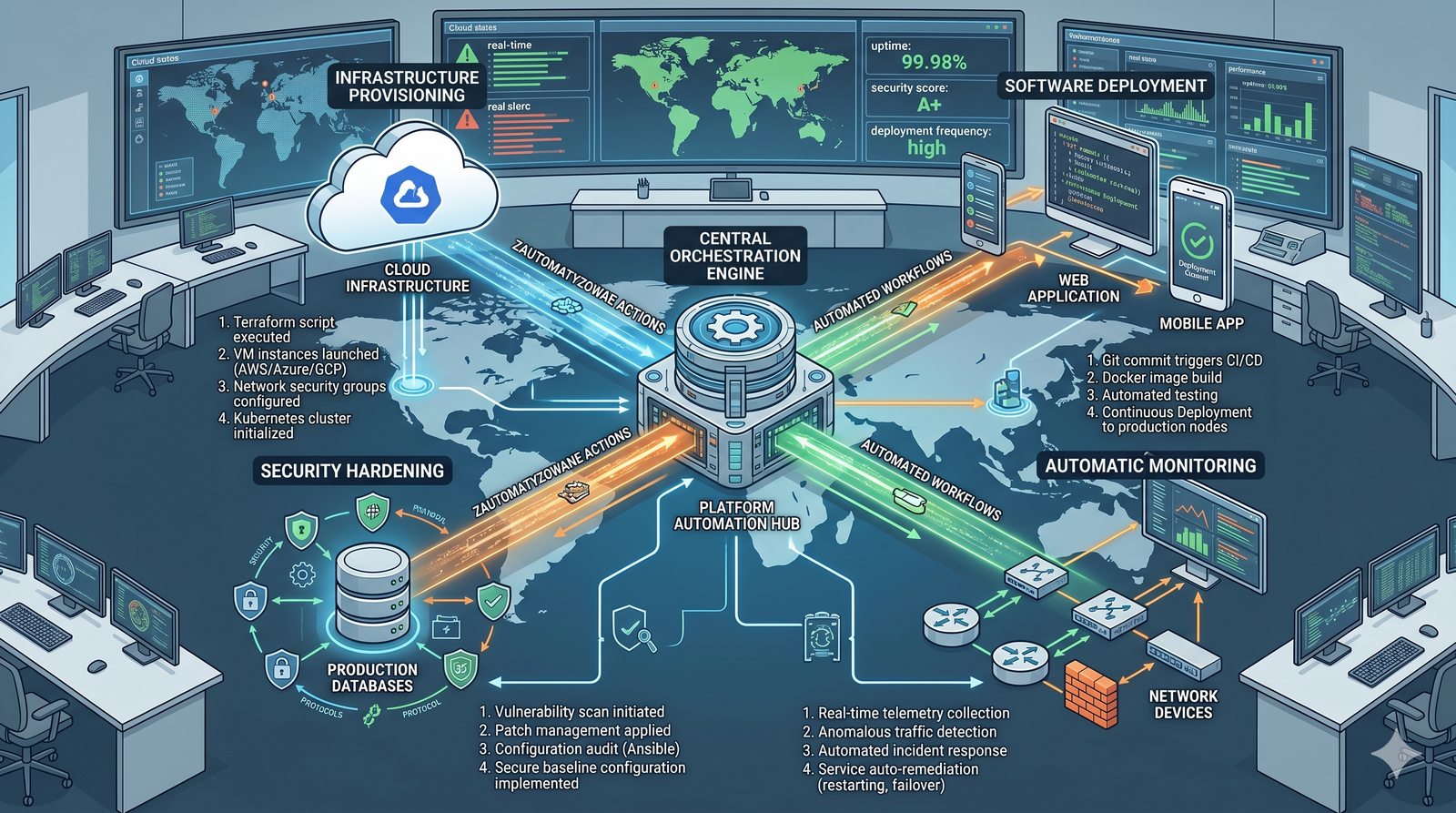

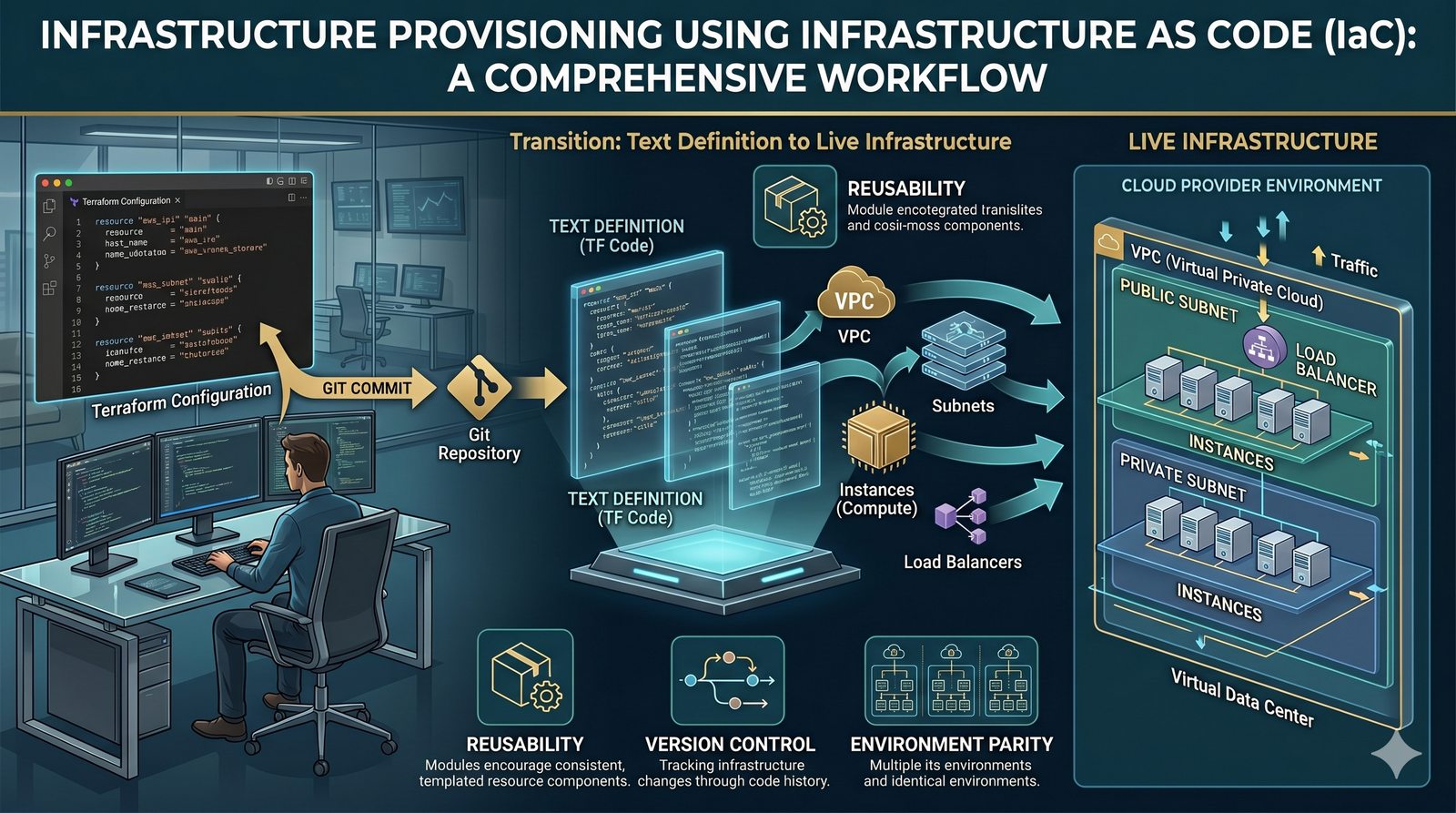

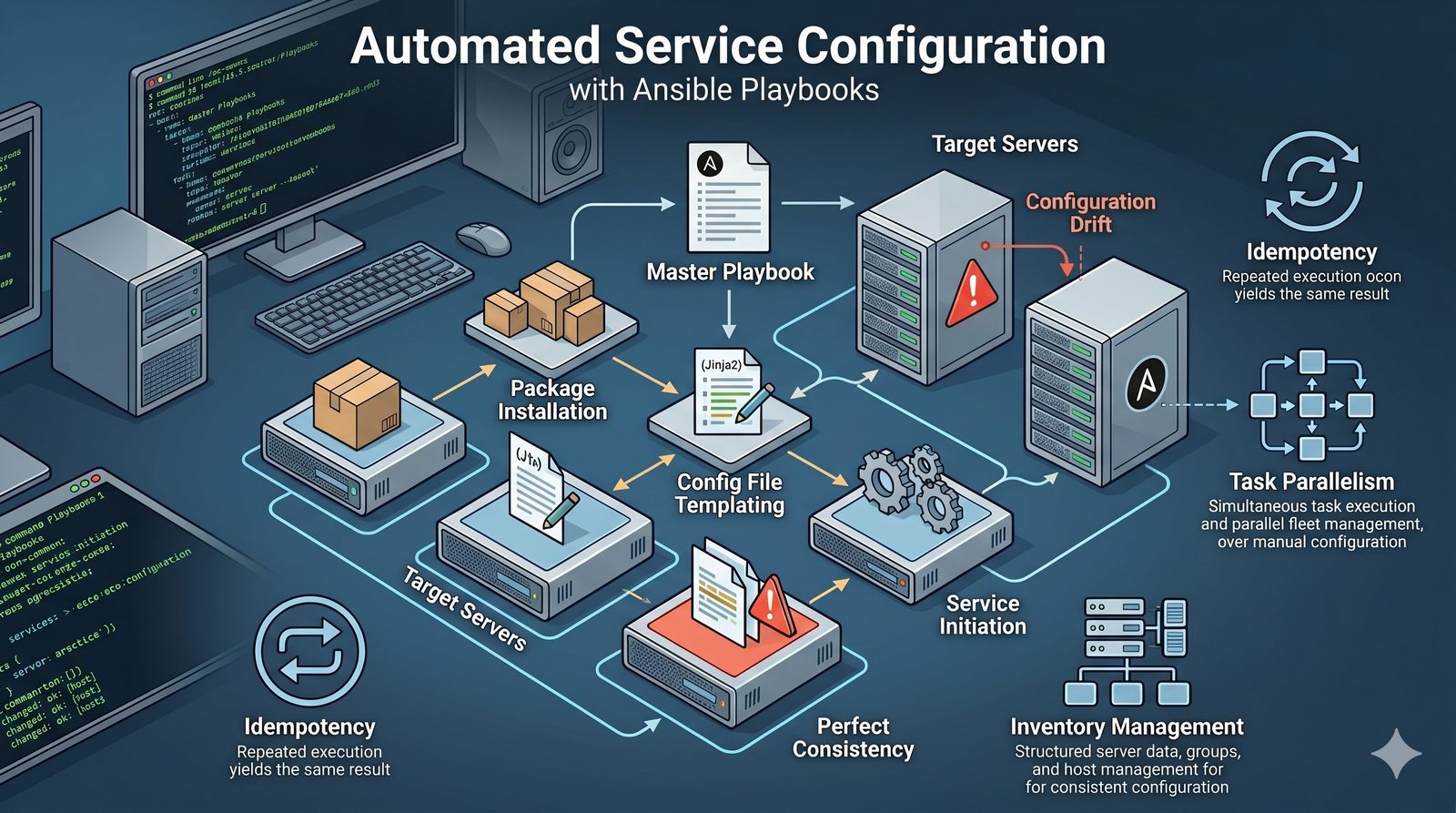

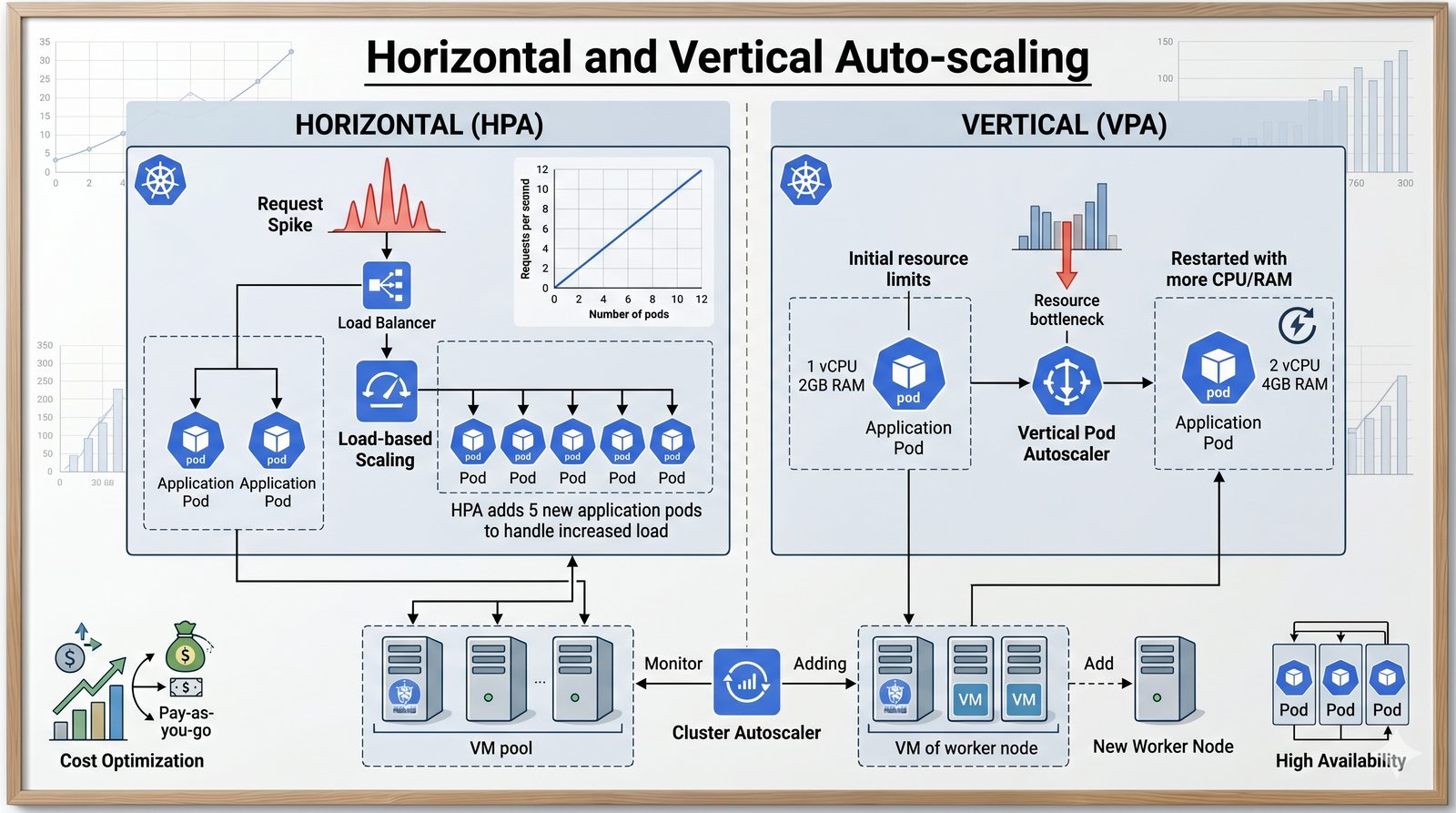

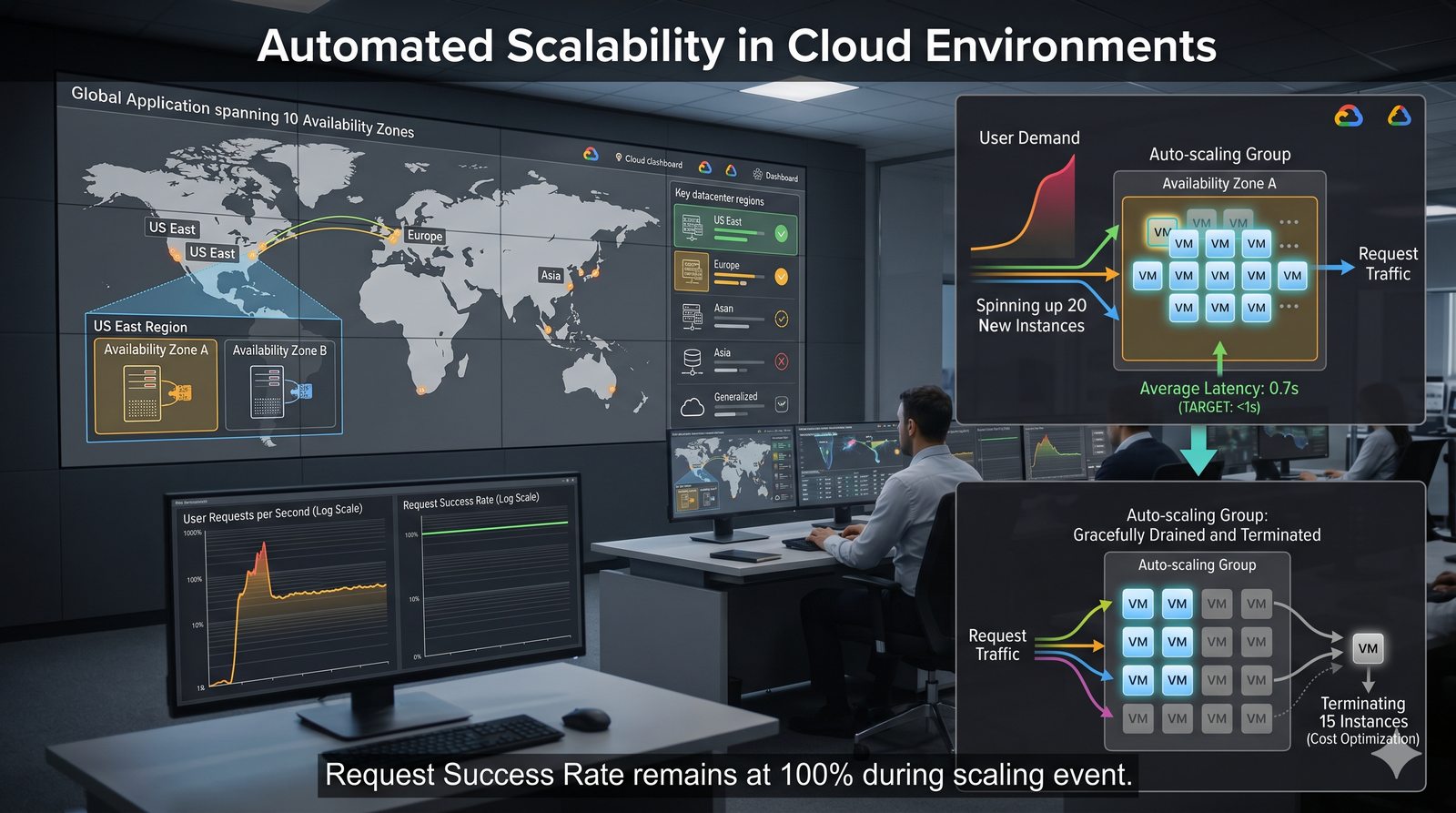

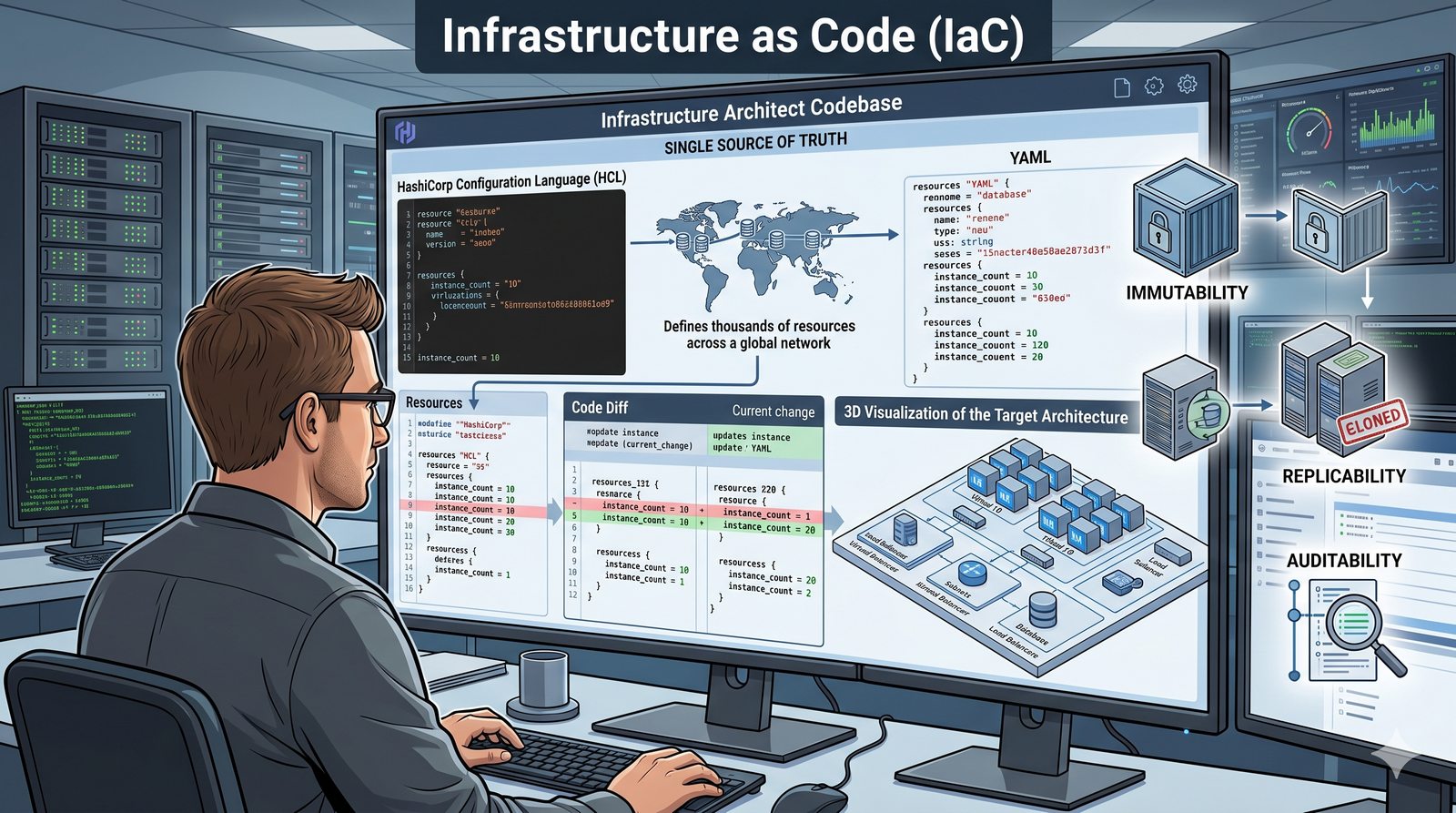

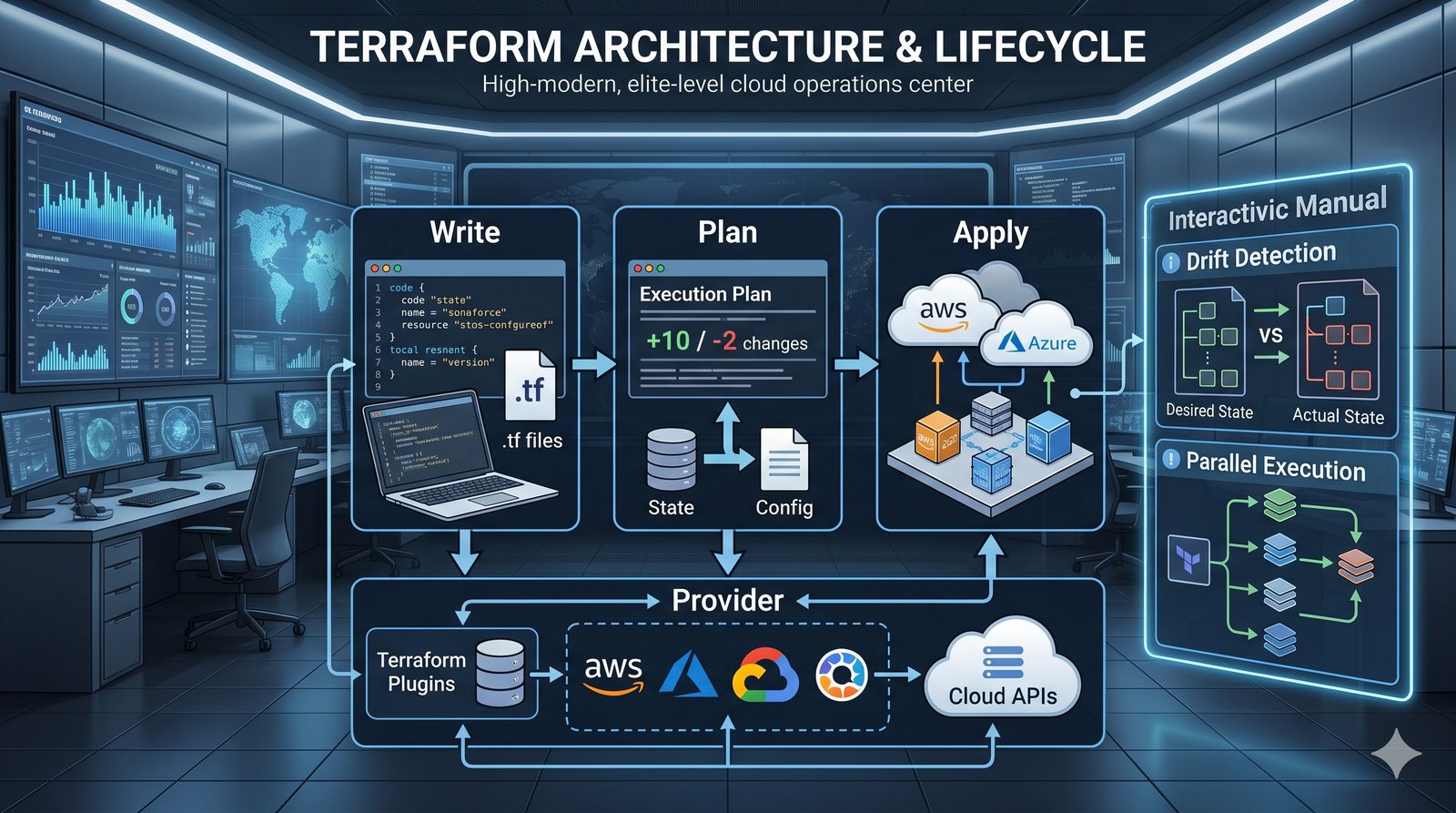

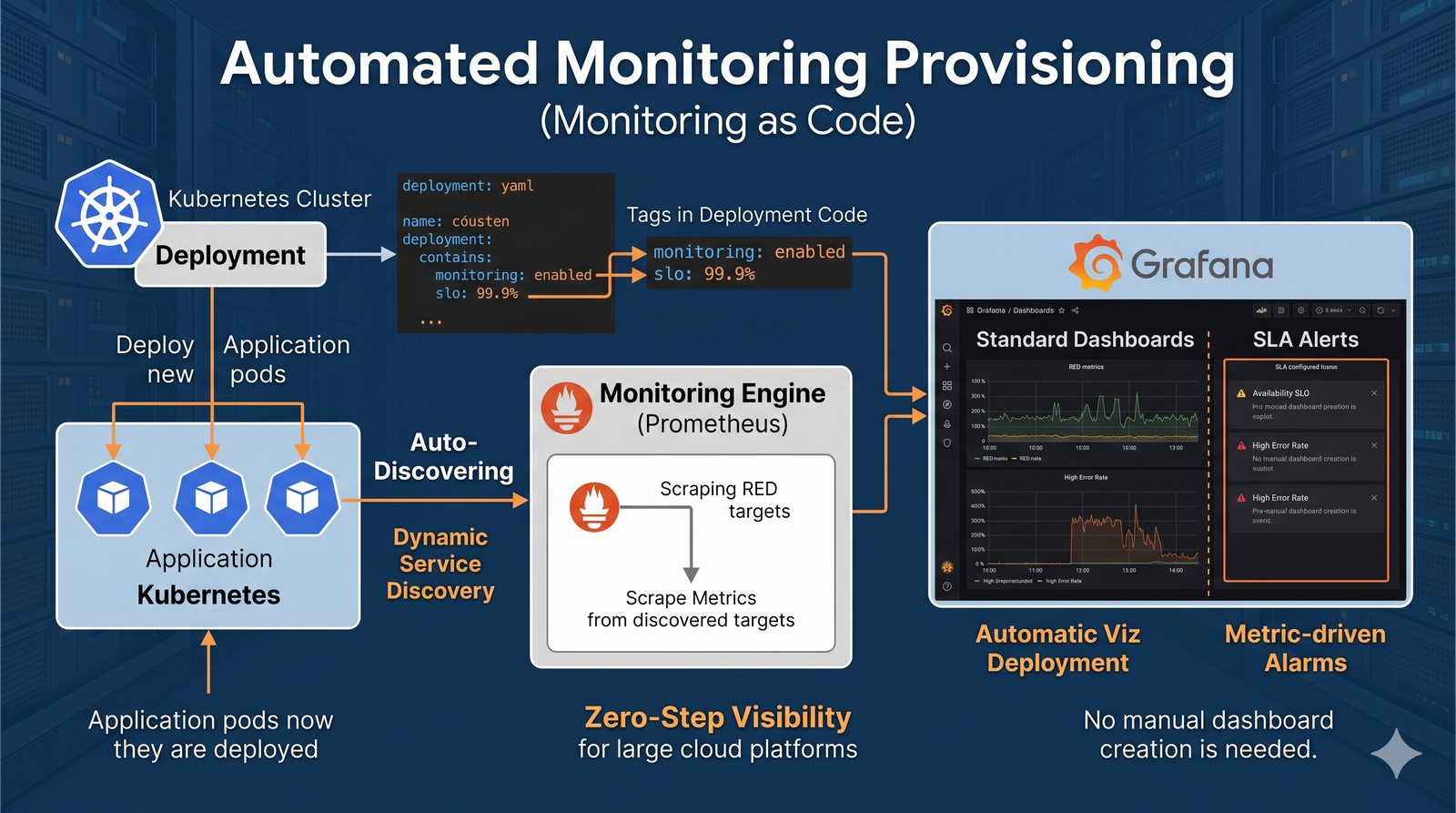

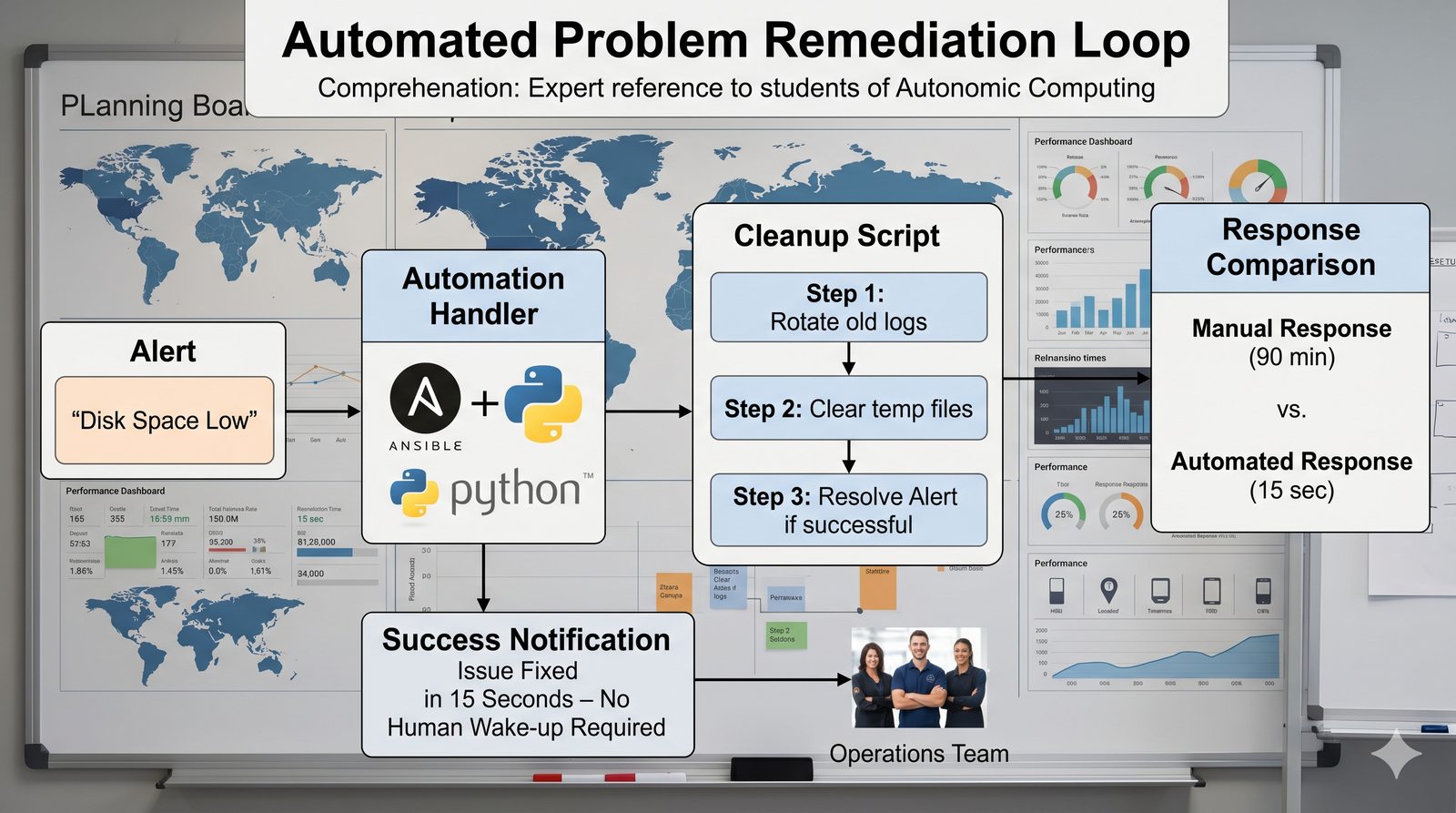

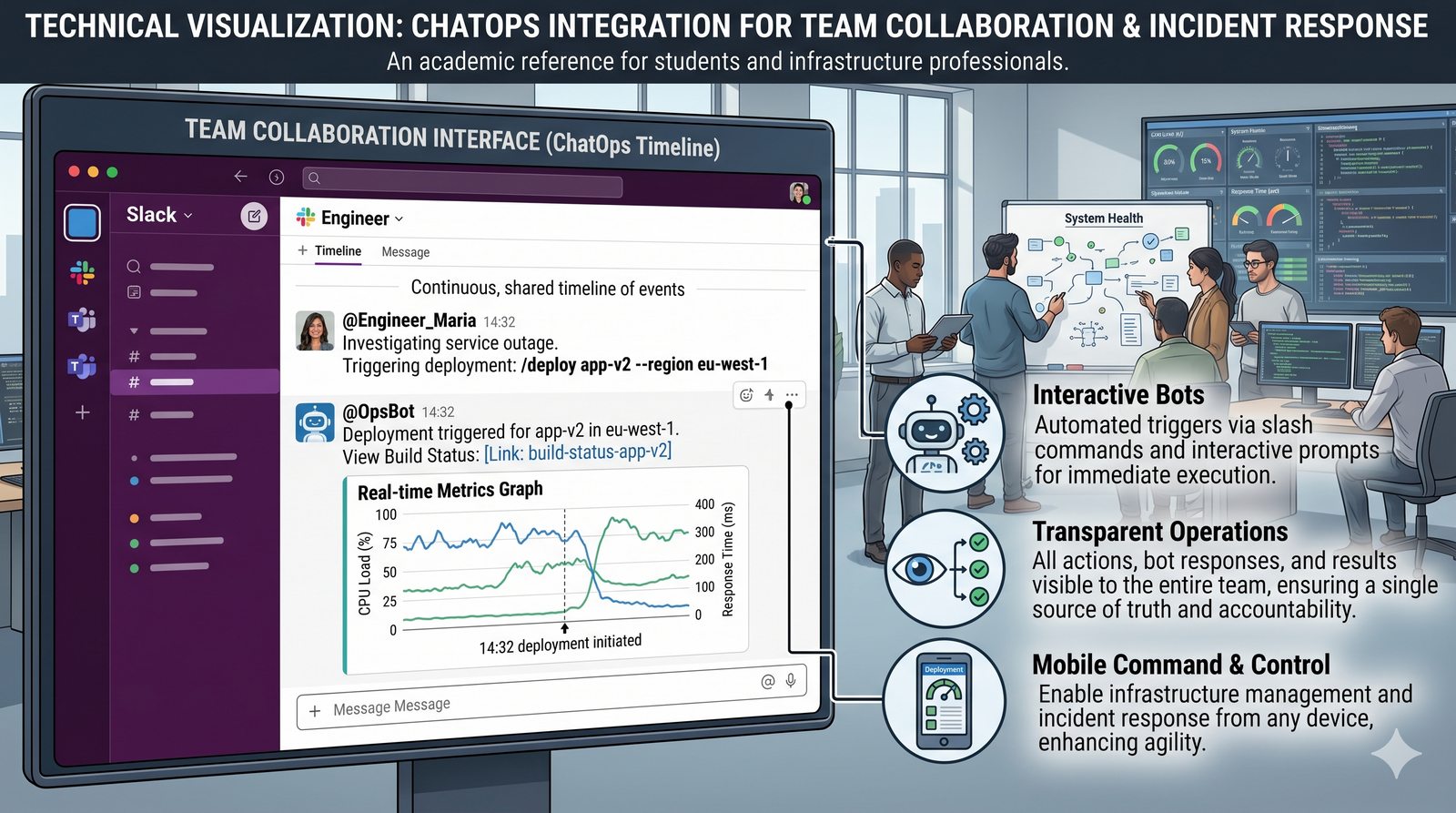

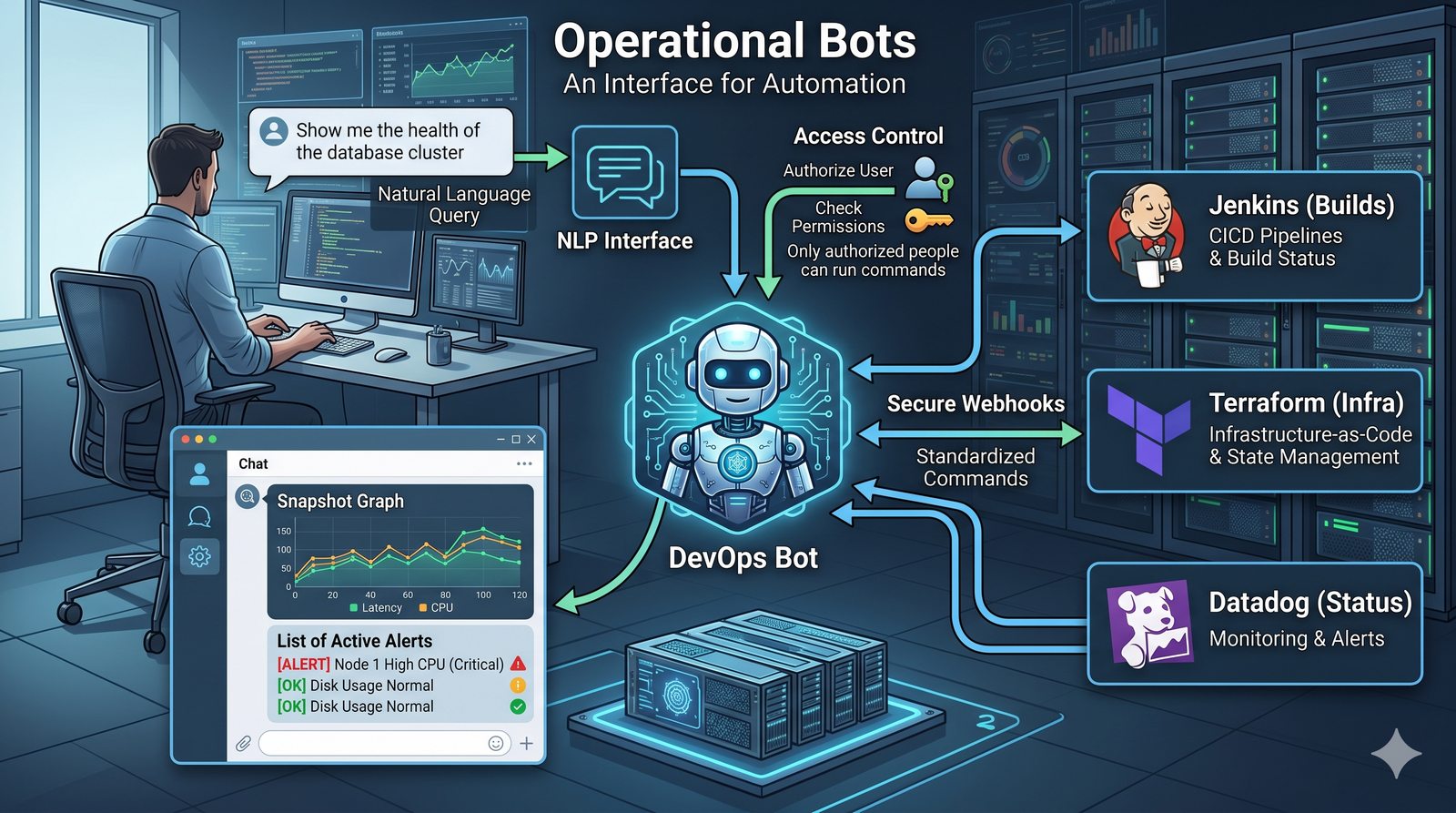

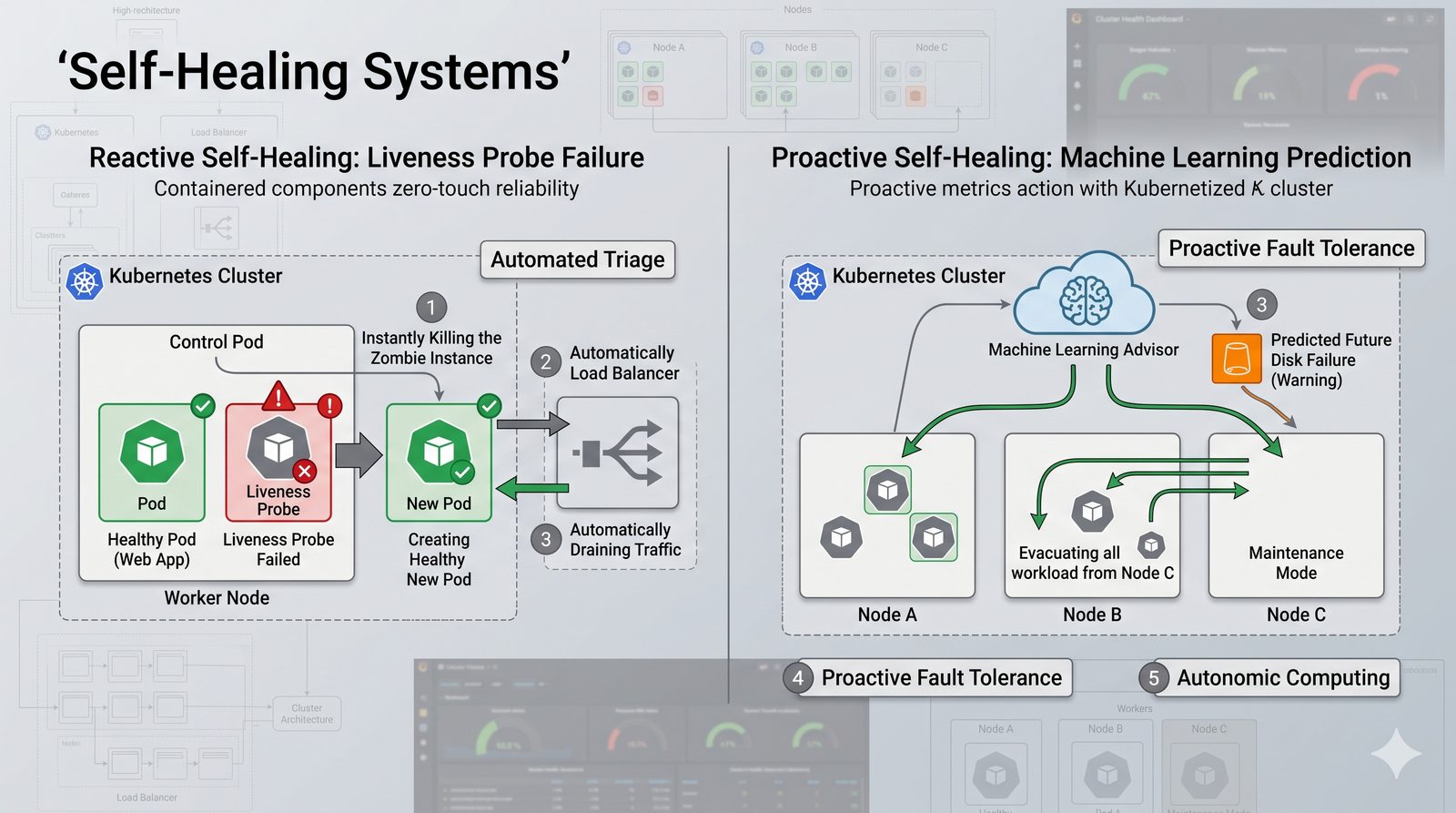

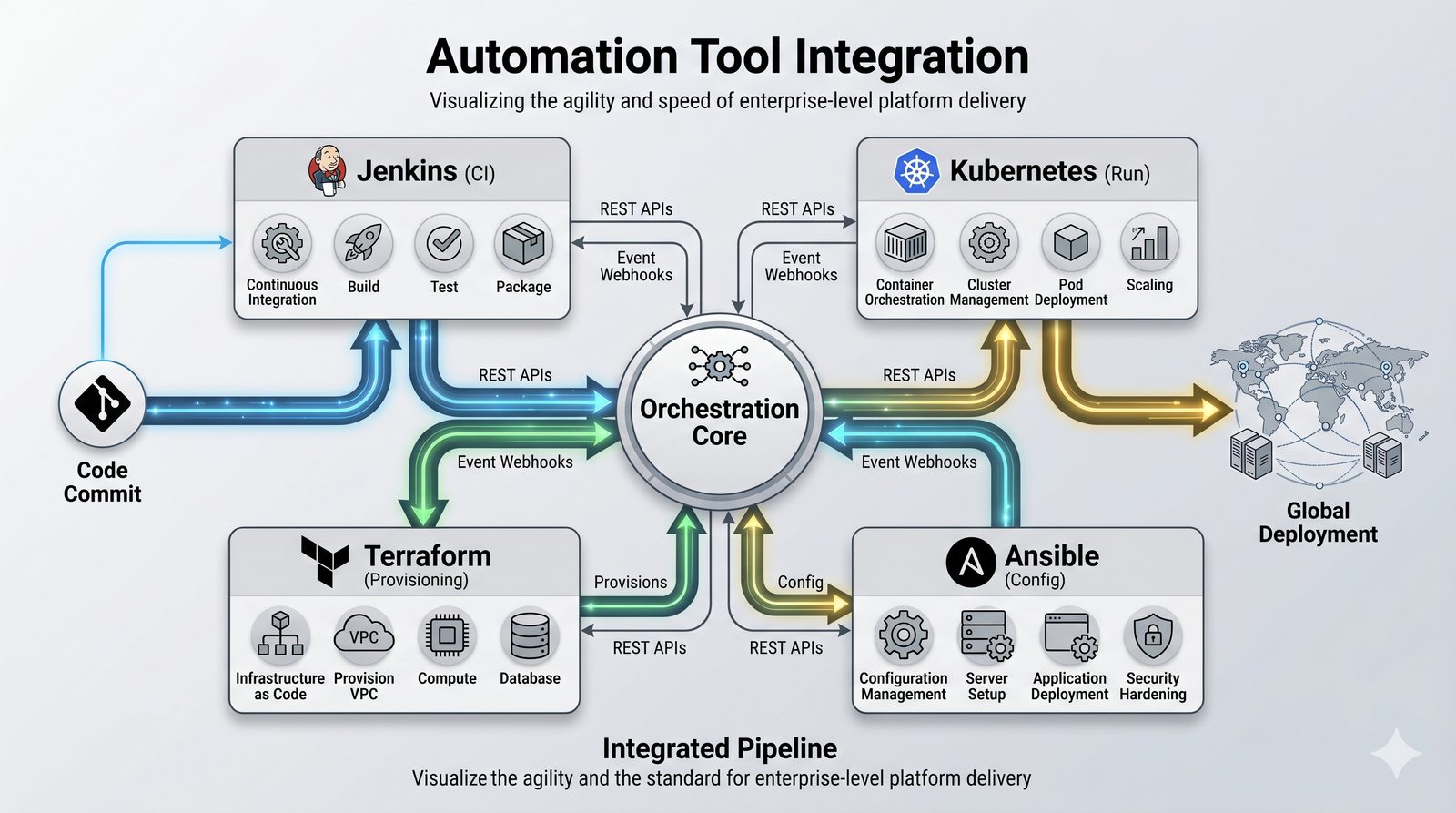

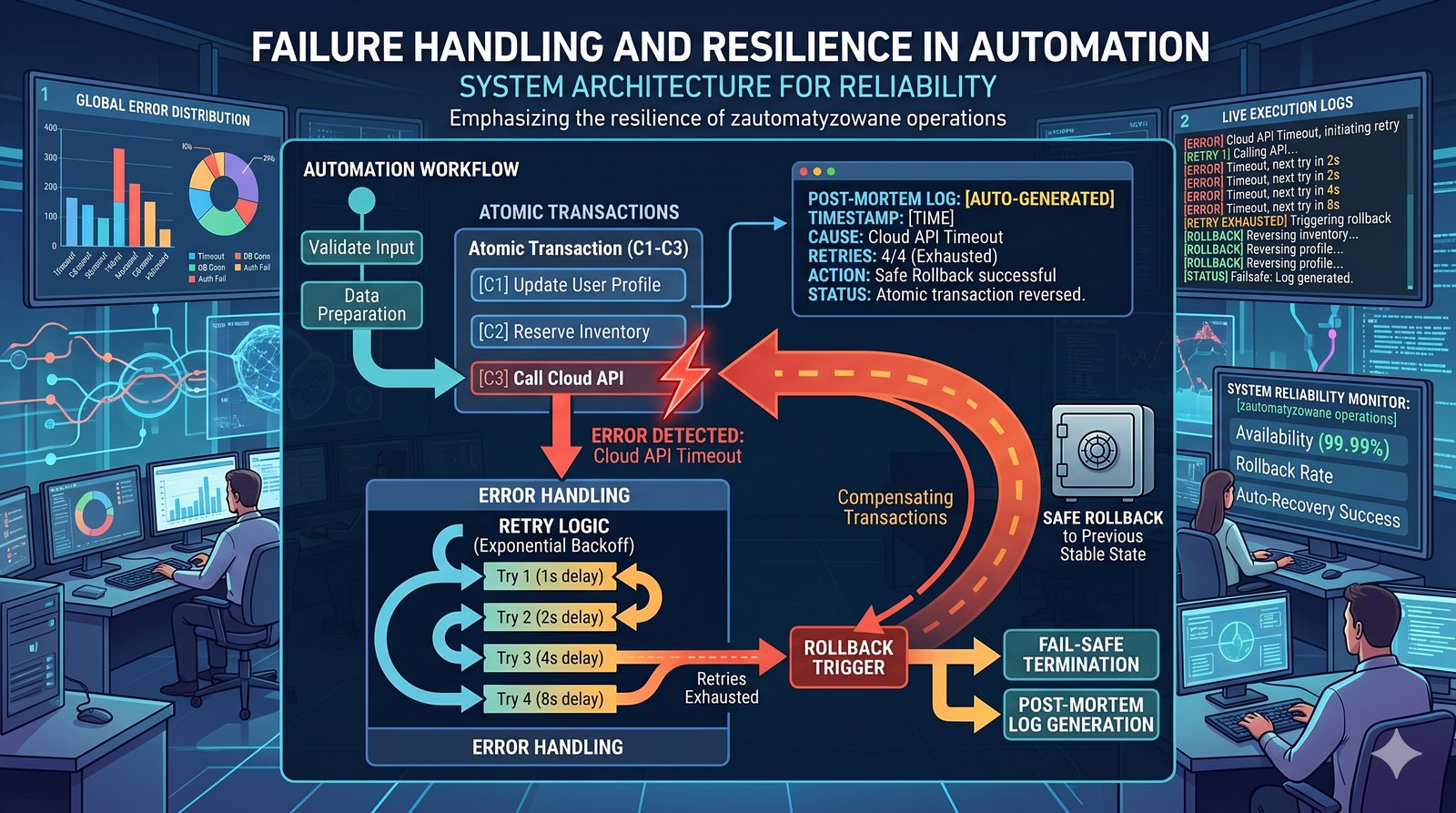

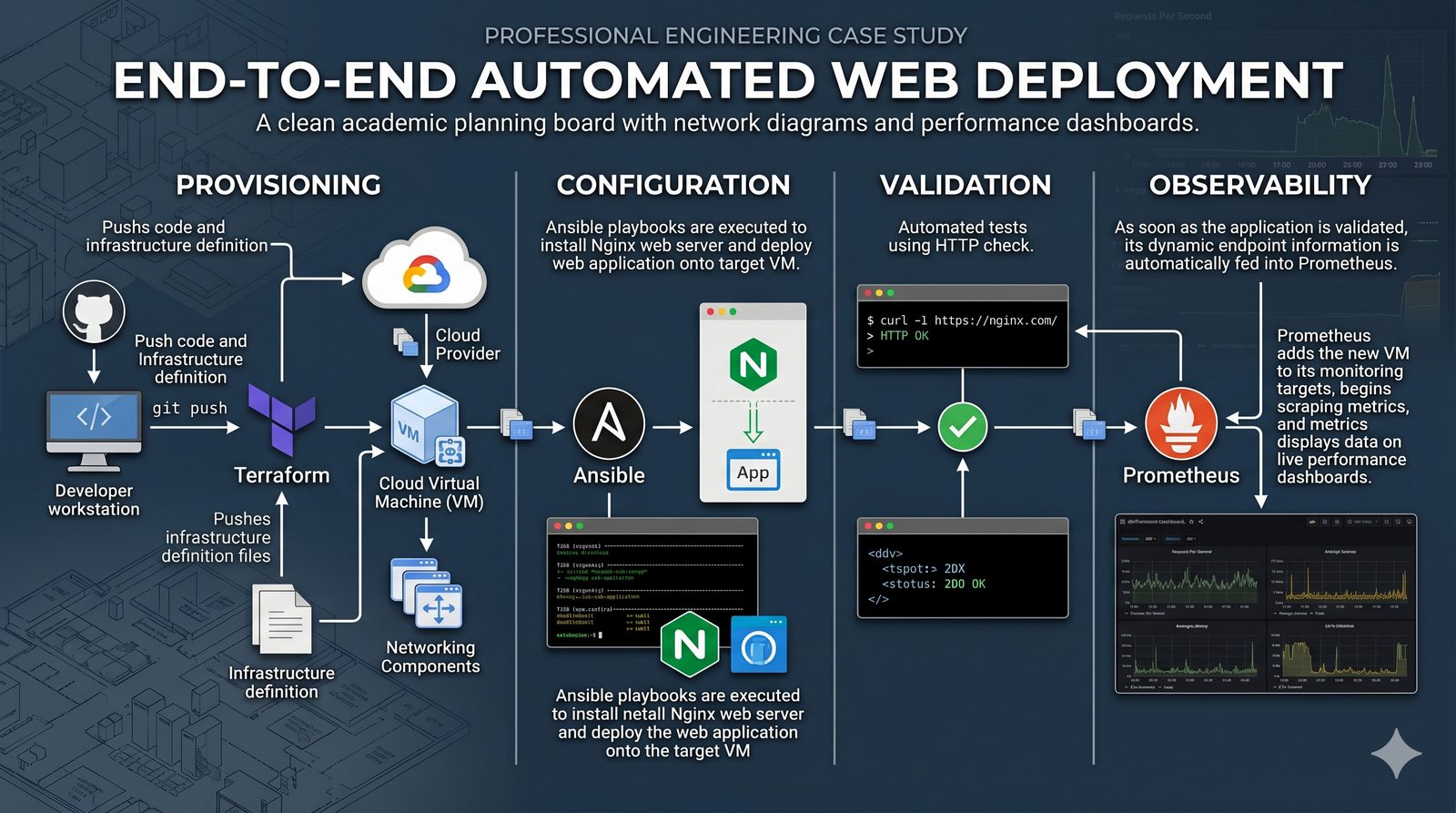

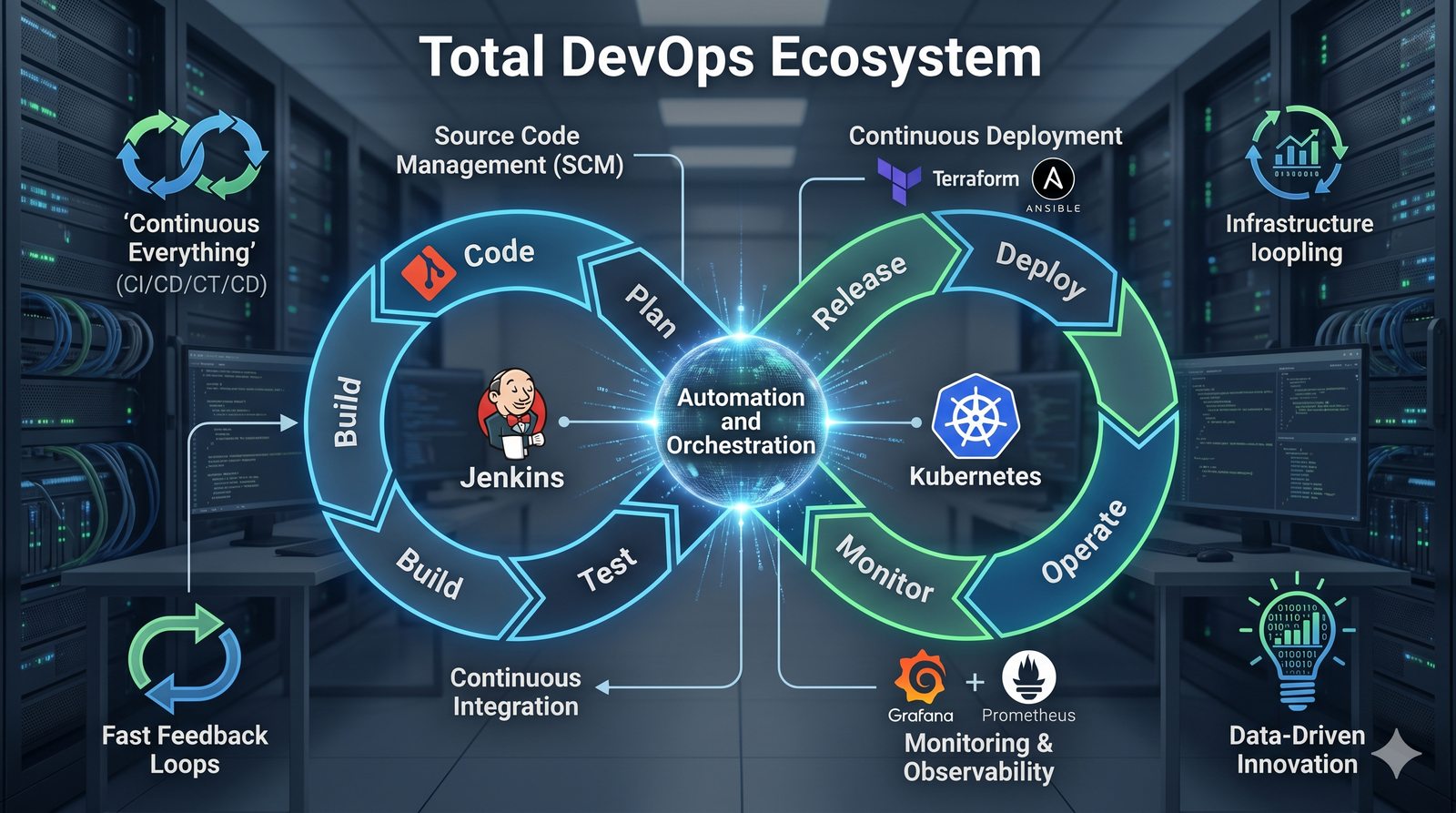

W kontekście utrzymania usług, automatyzacja odgrywa kluczową rolę na każdym etapie cyklu życia systemu. Umożliwia ona zautomatyzowane provisionowanie infrastruktury, spójną i powtarzalną konfigurację usług, a także zautomatyzowane procesy wdrażania i testowania. Co więcej, automatyzacja jest fundamentem nowoczesnego monitoringu i reagowania na incydenty, pozwalając na automatyczne skalowanie usług w odpowiedzi na obciążenie oraz na automatyczne naprawianie niektórych rodzajów awarii. Jest to klucz do budowania niezawodnych i skalowalnych systemów w dynamicznym świecie IT.