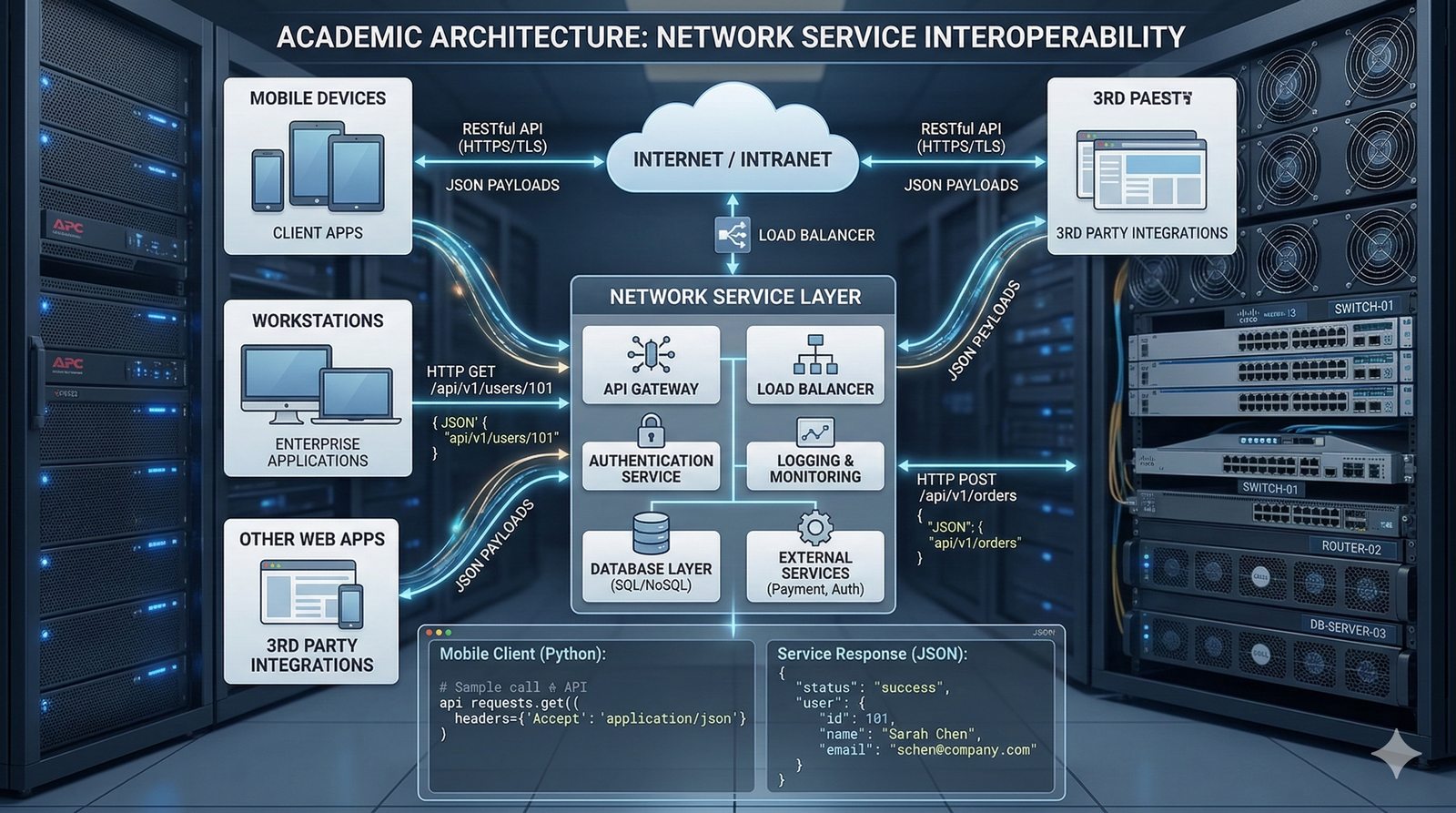

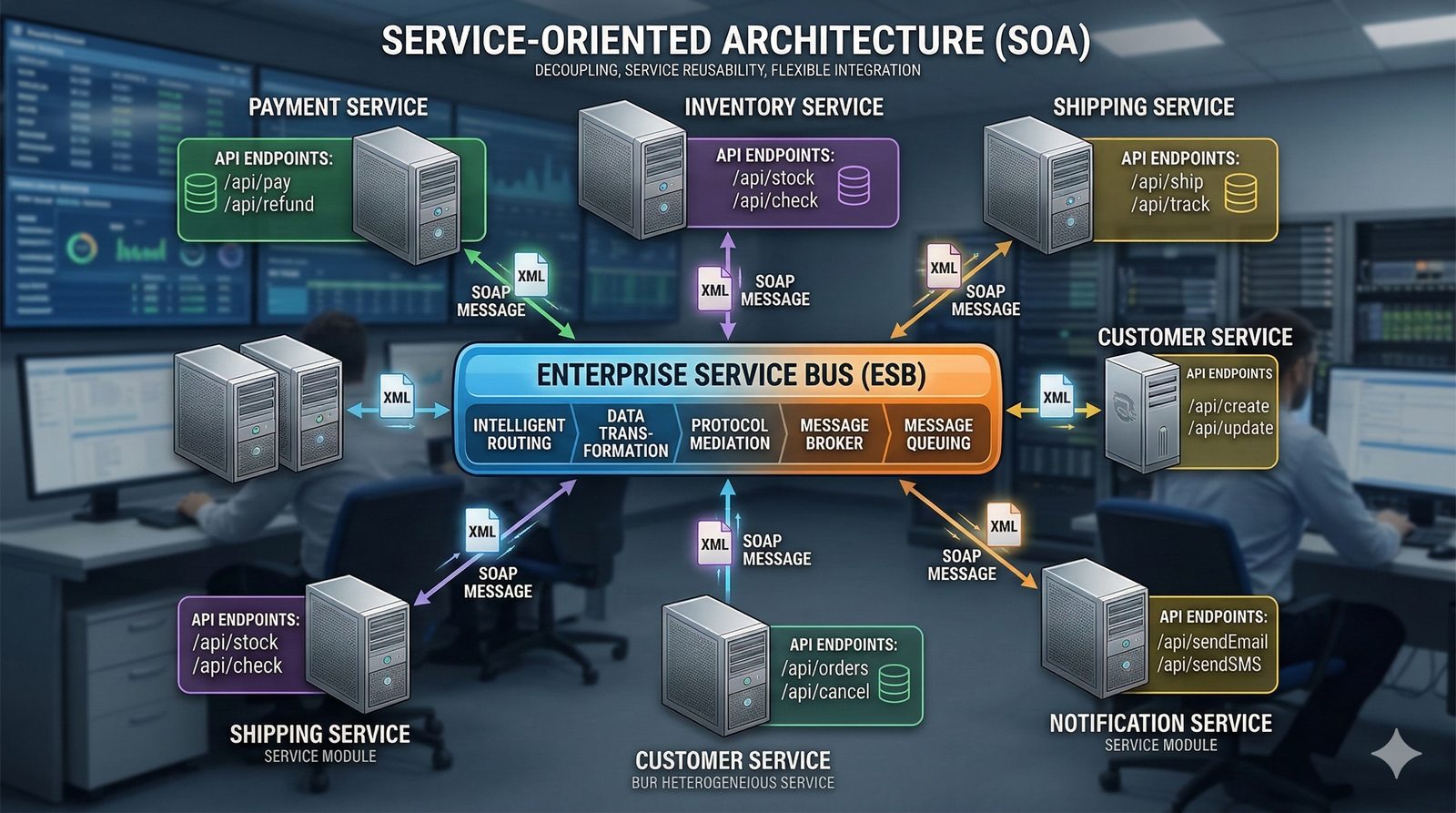

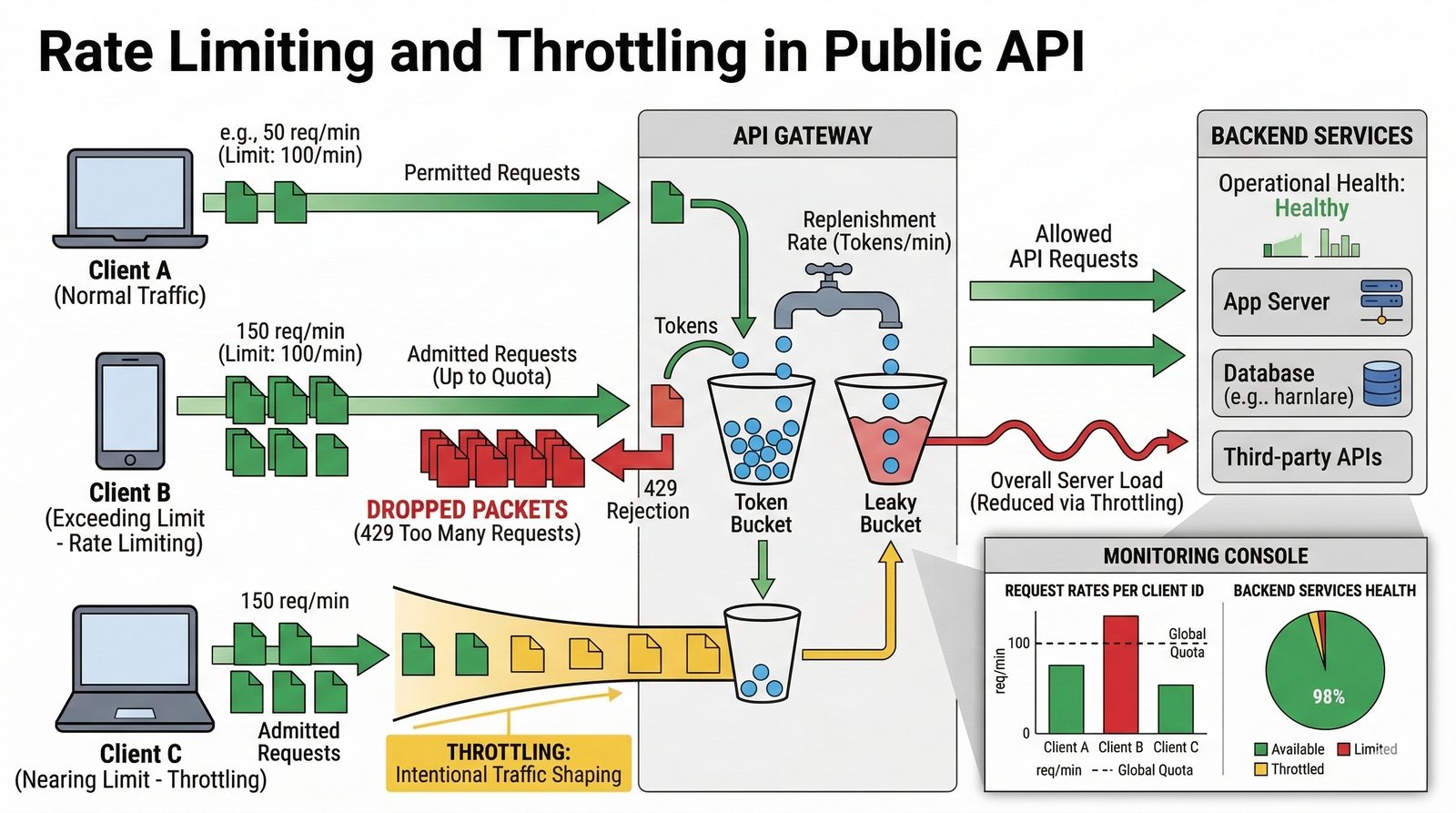

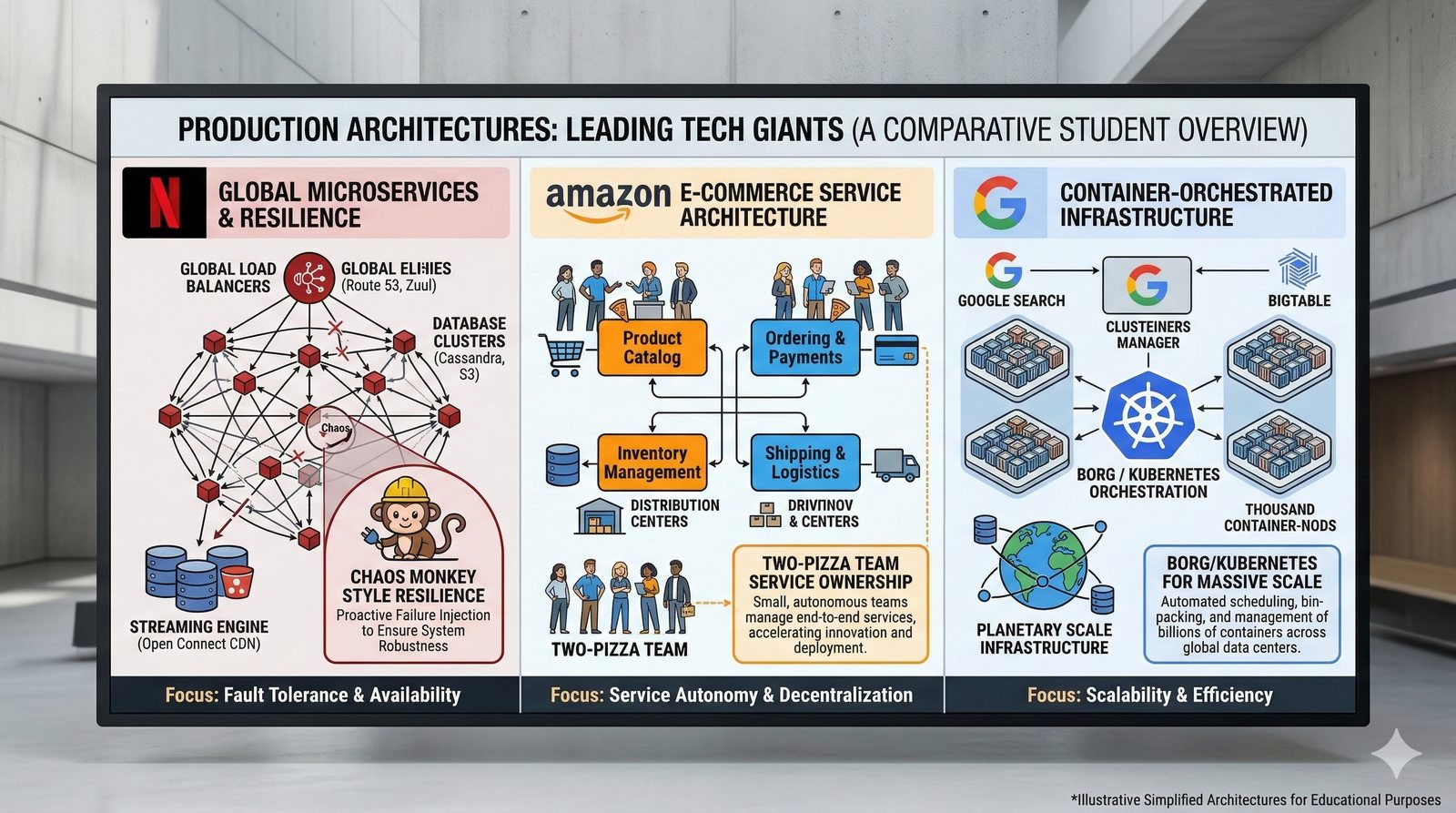

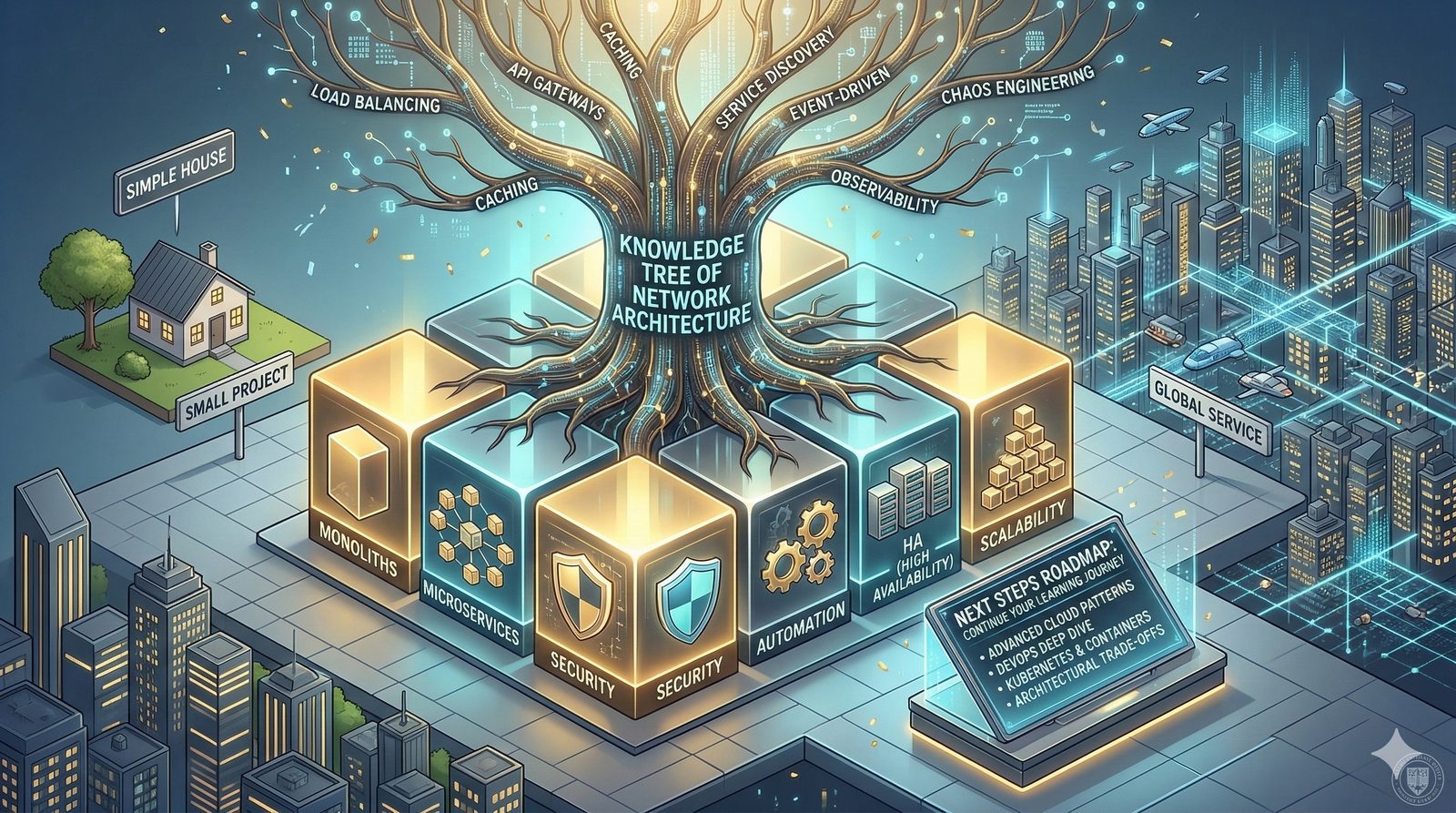

Usługa sieciowa to fundamentalny komponent współczesnej informatyki, umożliwiający komunikację i wymianę danych między różnymi aplikacjami lub systemami za pośrednictwem sieci komputerowej. W praktyce jest to oprogramowanie, które wykonuje określone zadania, takie jak dostarczanie danych, uwierzytelnianie użytkowników czy przetwarzanie transakcji, udostępniając swoje funkcje innym programom. Usługi te działają w oparciu o standardowe protokoły, na przykład HTTP, co zapewnia interoperacyjność, czyli zdolność do współpracy systemów stworzonych w różnych technologiach. Dzięki temu deweloperzy mogą budować złożone aplikacje, składając je z mniejszych, wyspecjalizowanych usług, co znacząco przyspiesza rozwój i ułatwia utrzymanie systemów.

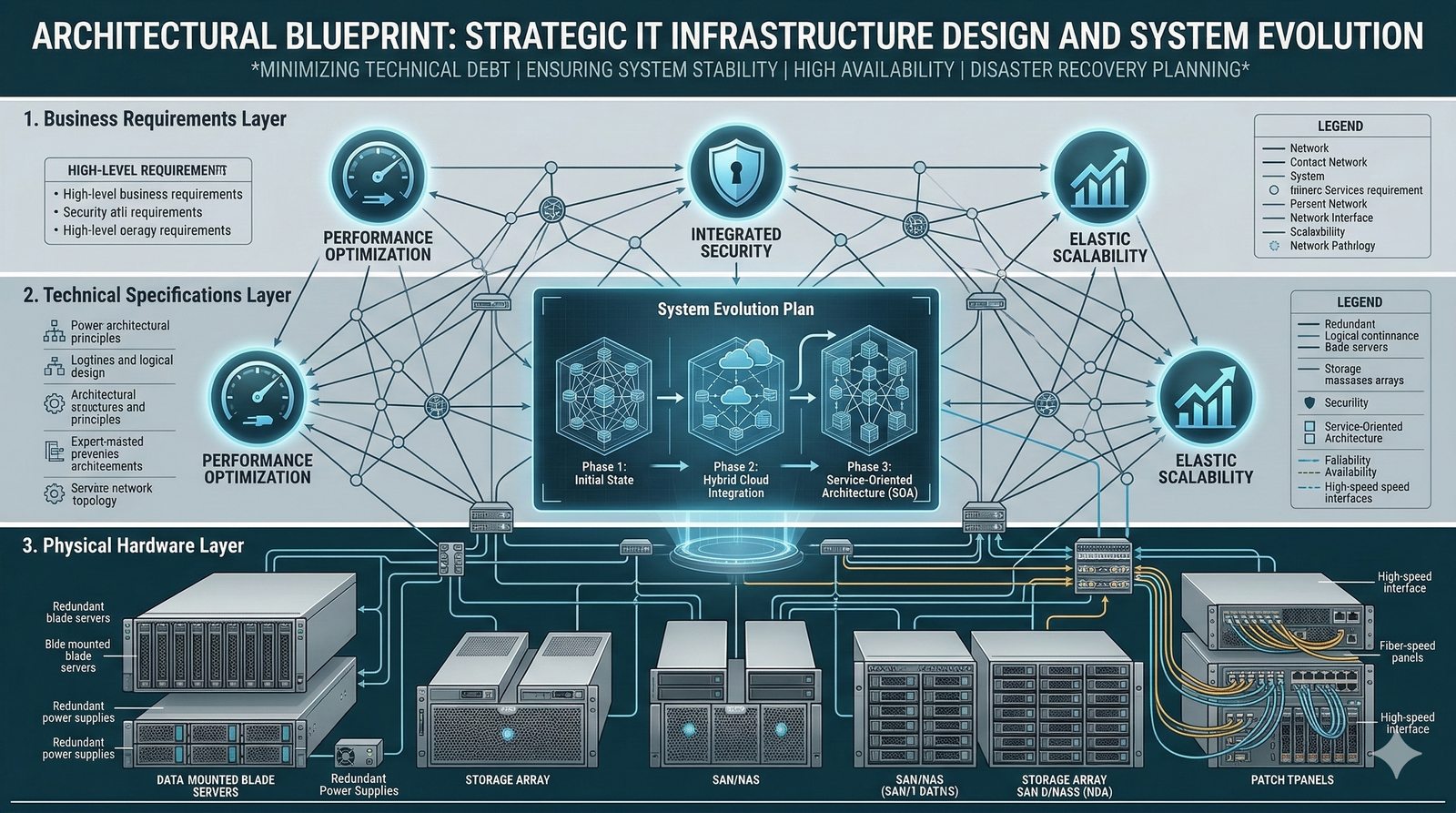

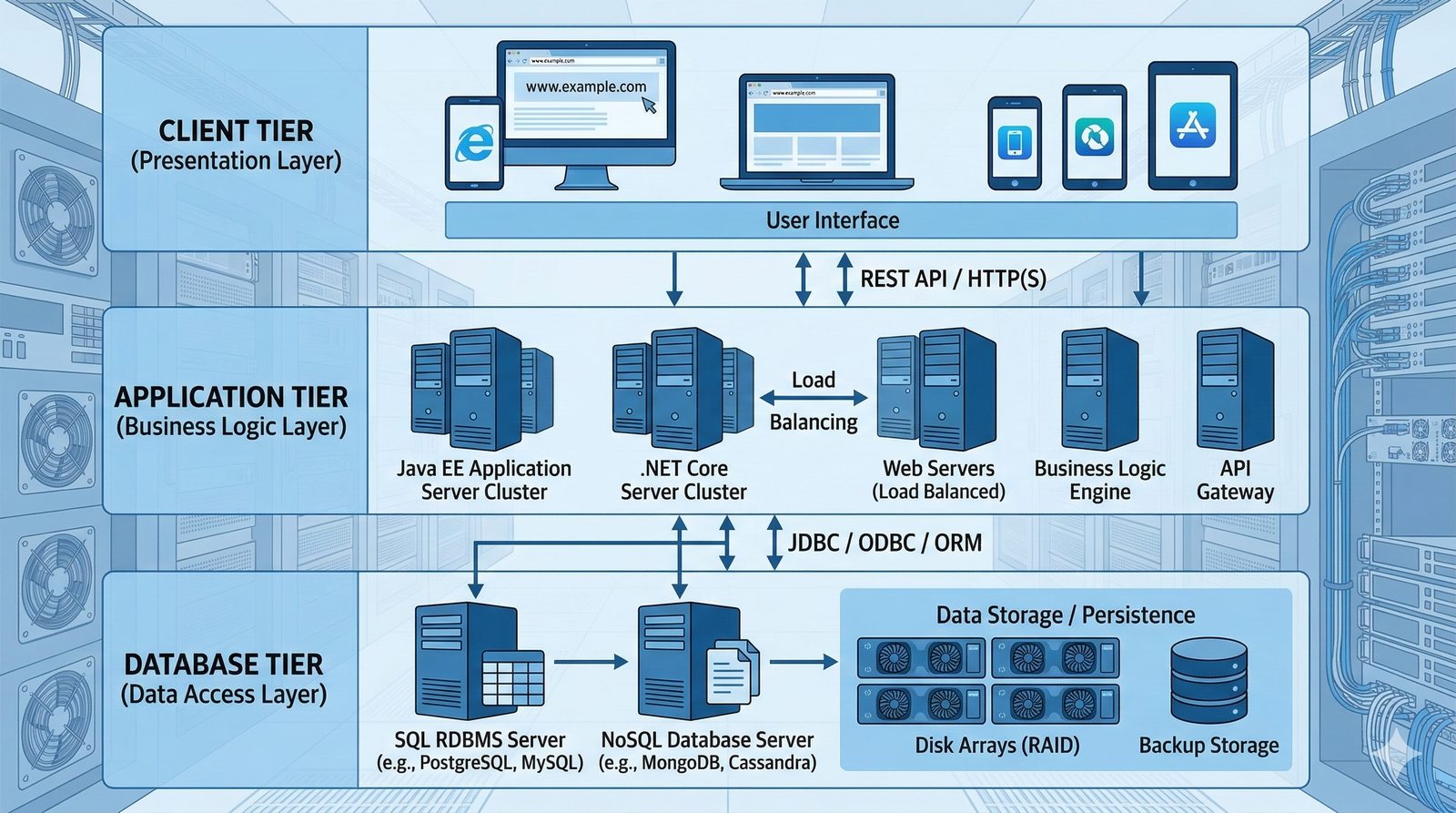

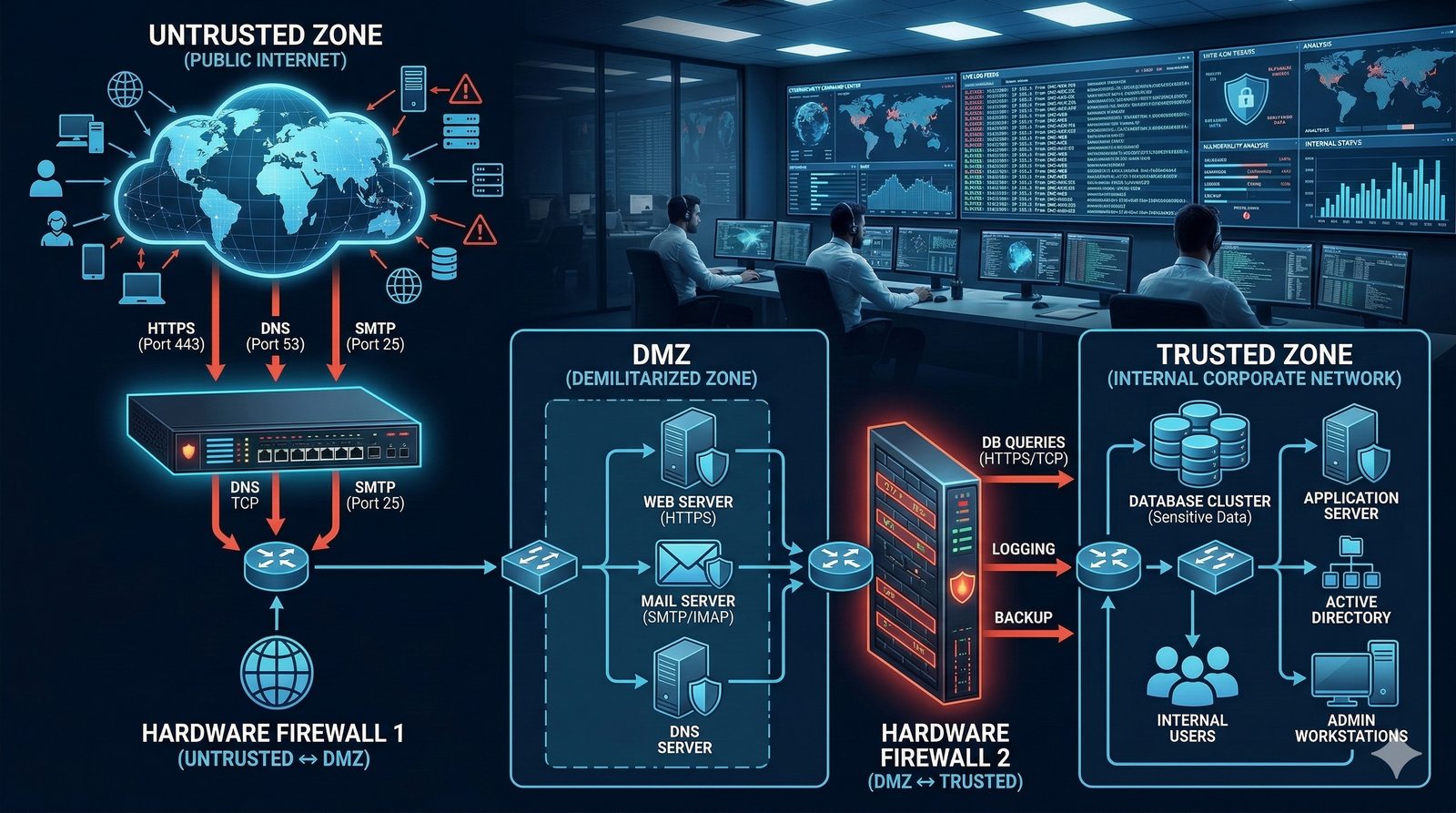

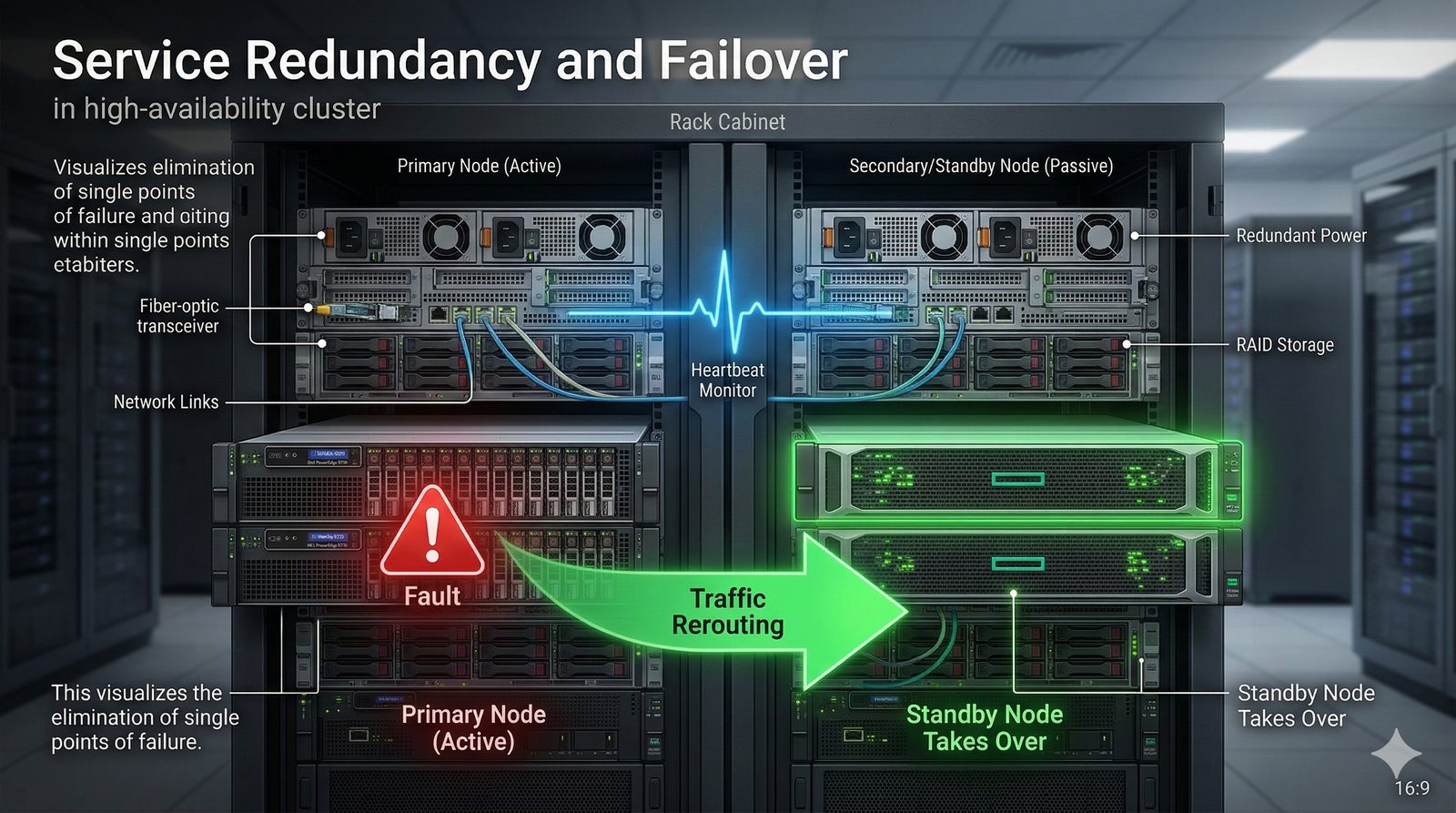

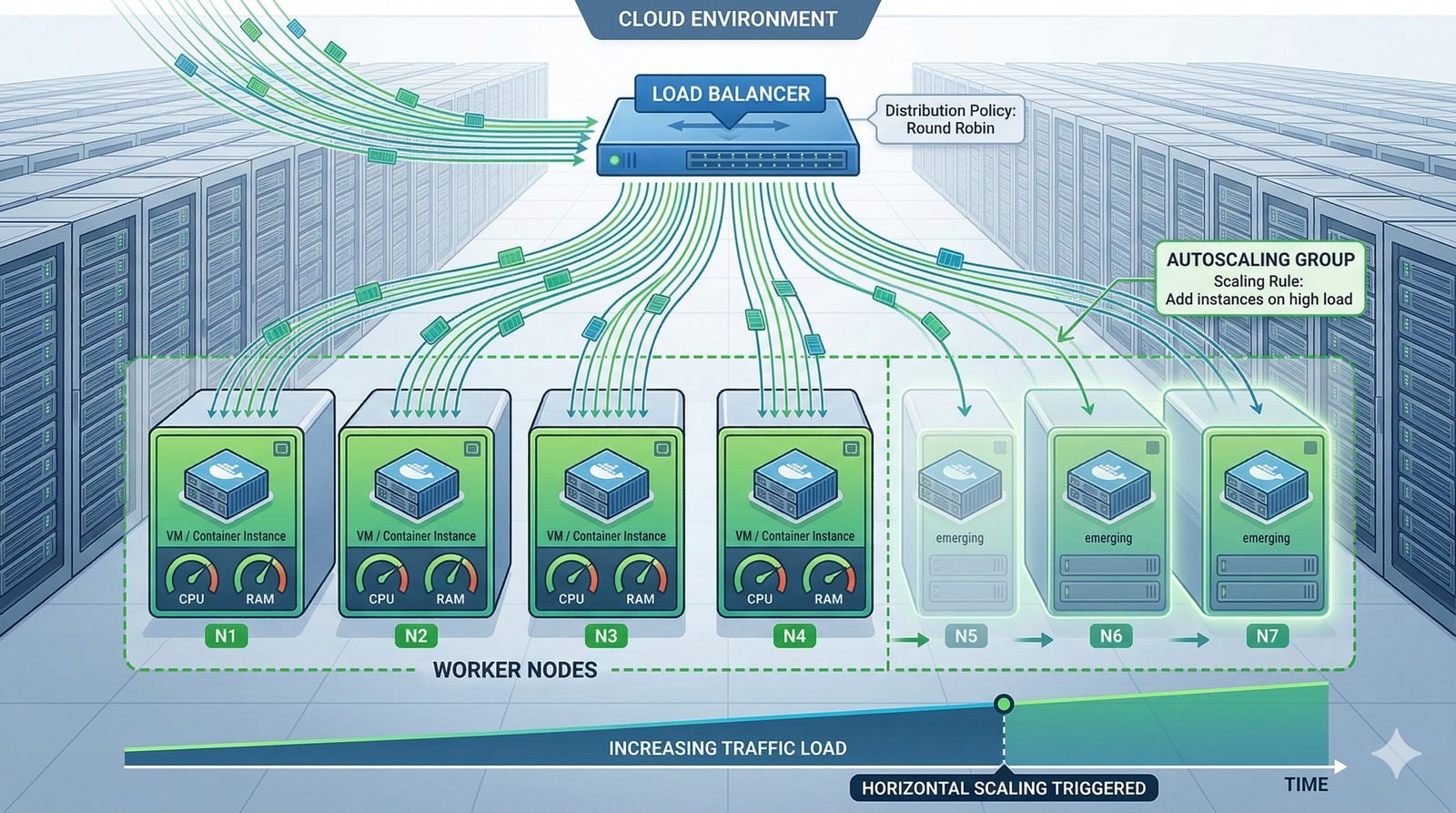

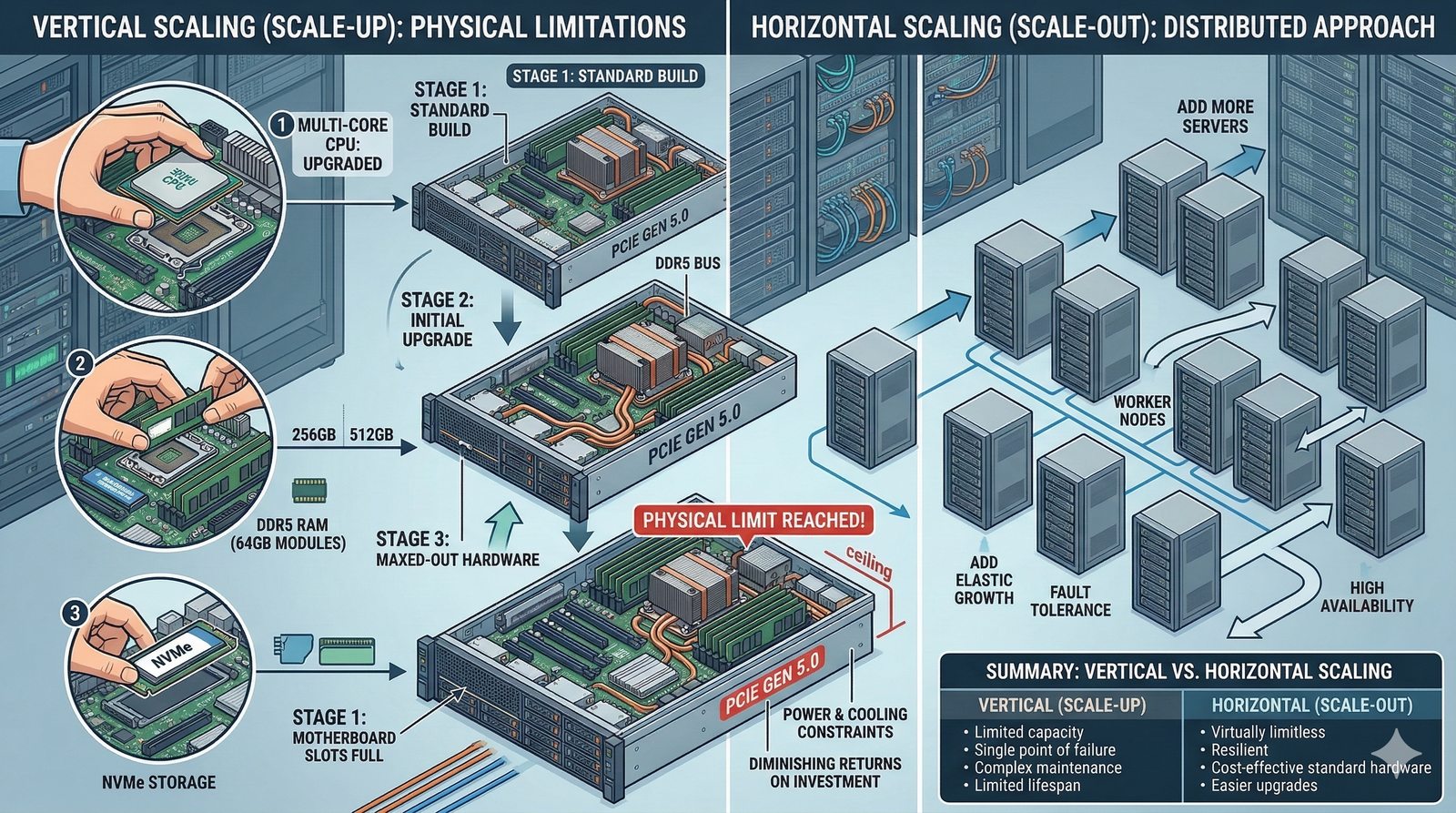

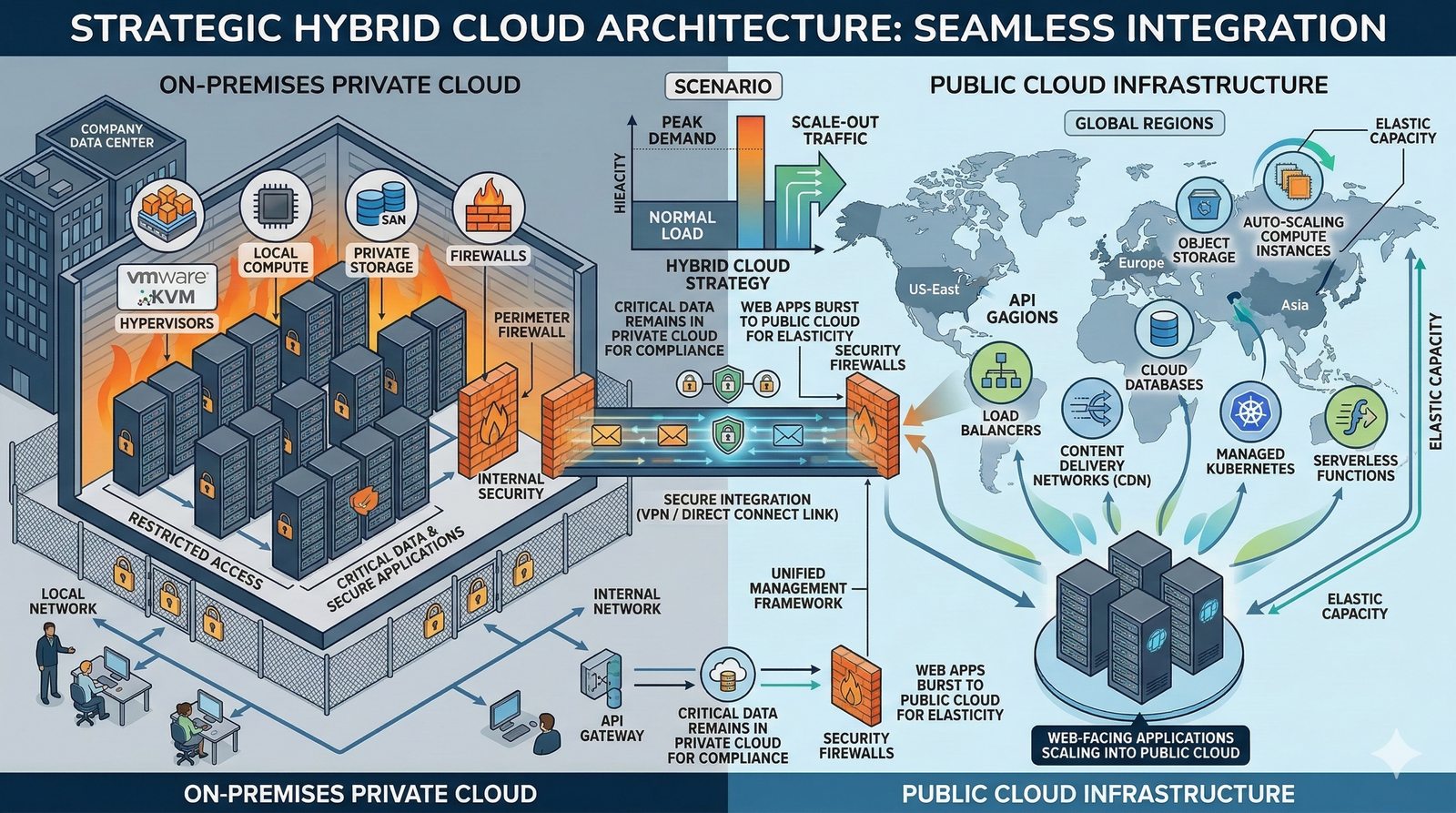

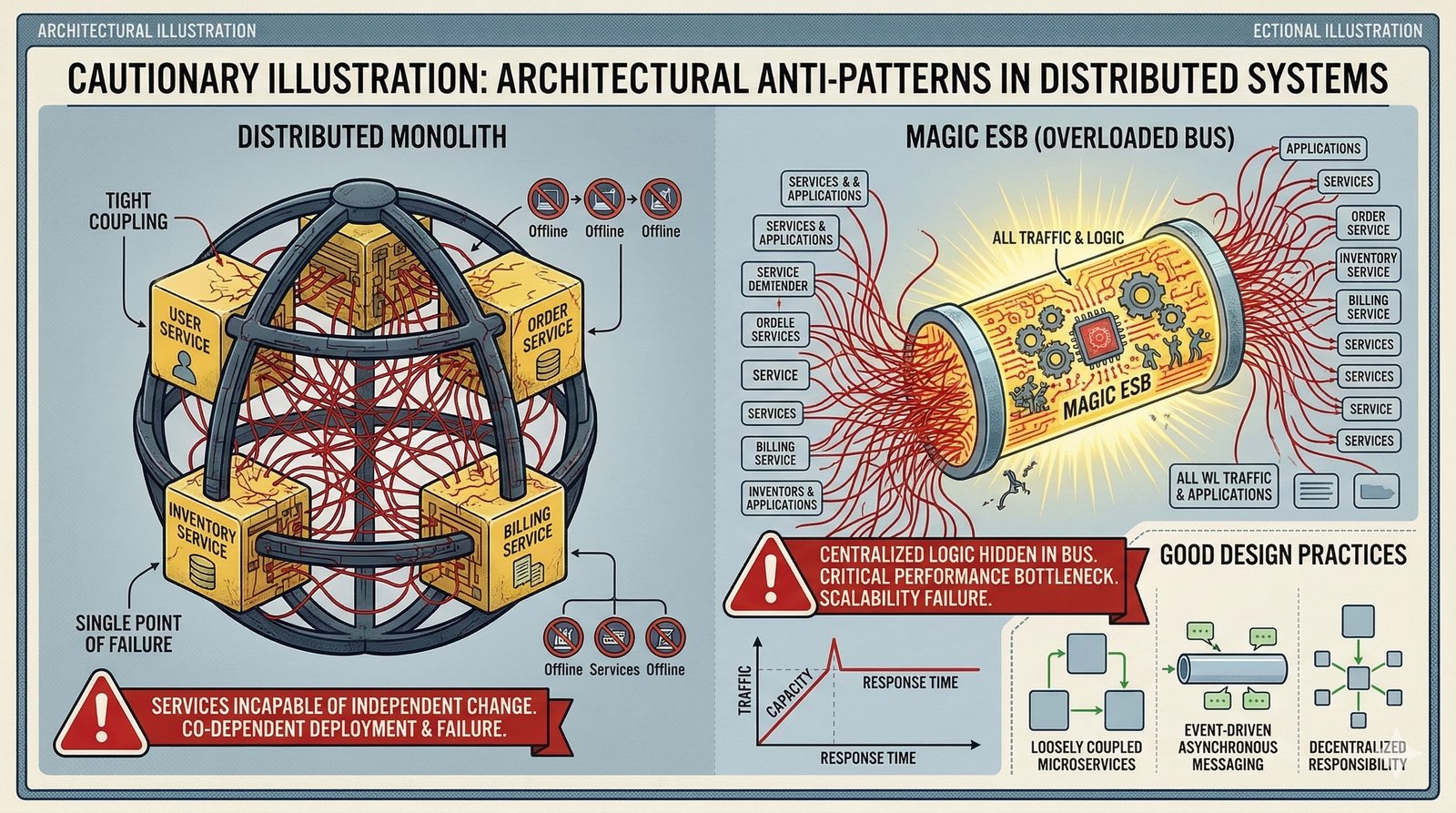

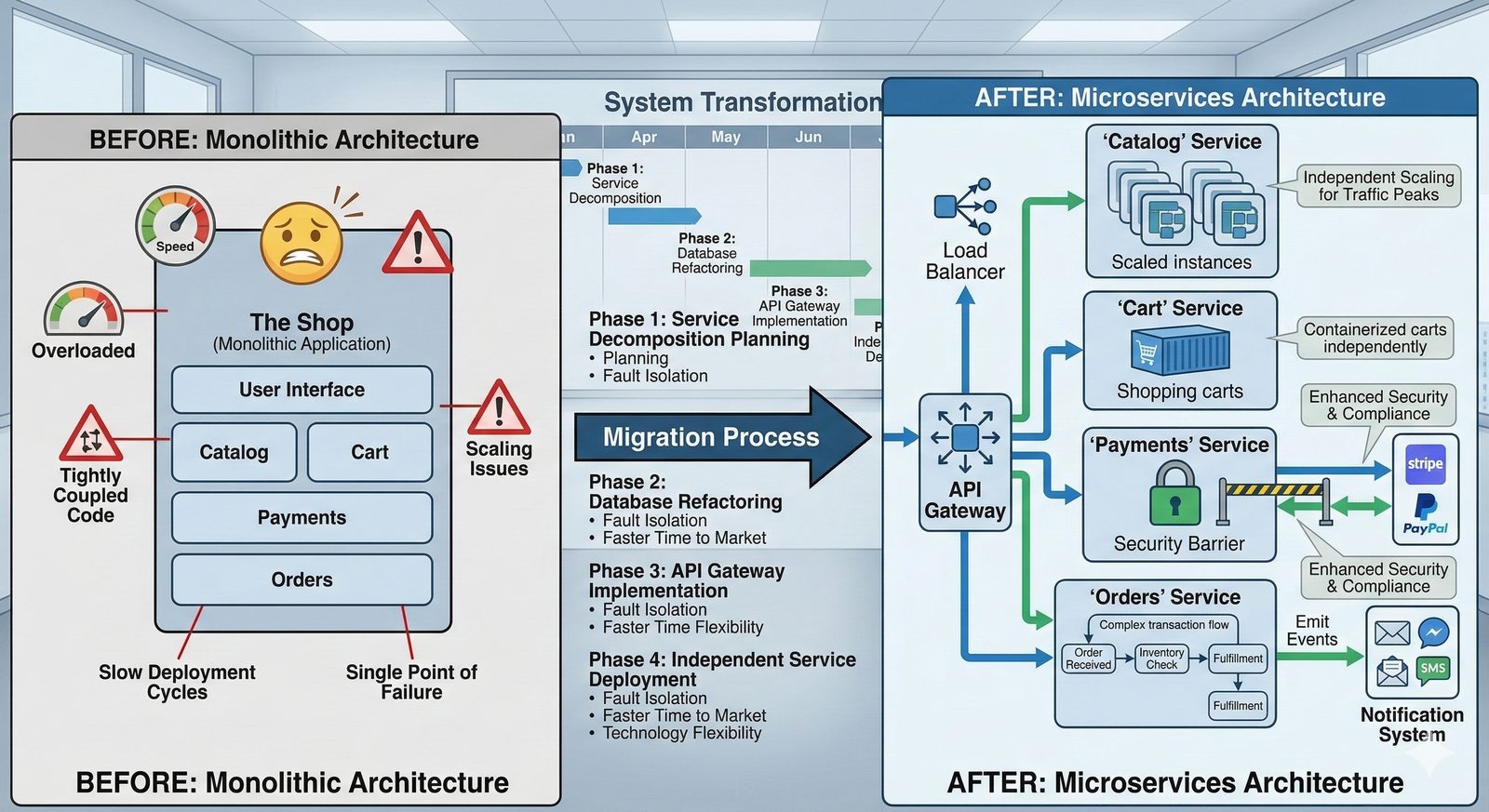

Architektura w technologiach informatycznych (IT) to strukturalny projekt systemu, który definiuje jego komponenty, ich wzajemne relacje oraz zasady rządzące ich projektowaniem i ewolucją. Jest to plan, który zapewnia, że system będzie spełniał wymagania biznesowe, takie jak wydajność, bezpieczeństwo i skalowalność. Dobrze zaprojektowana architektura jest kluczowa dla sukcesu projektu, ponieważ minimalizuje ryzyko techniczne, obniża koszty utrzymania i ułatwia przyszły rozwój. Bez solidnych fundamentów architektonicznych systemy stają się chaotyczne, trudne do modyfikacji i podatne na awarie, co generuje tzw. dług technologiczny.