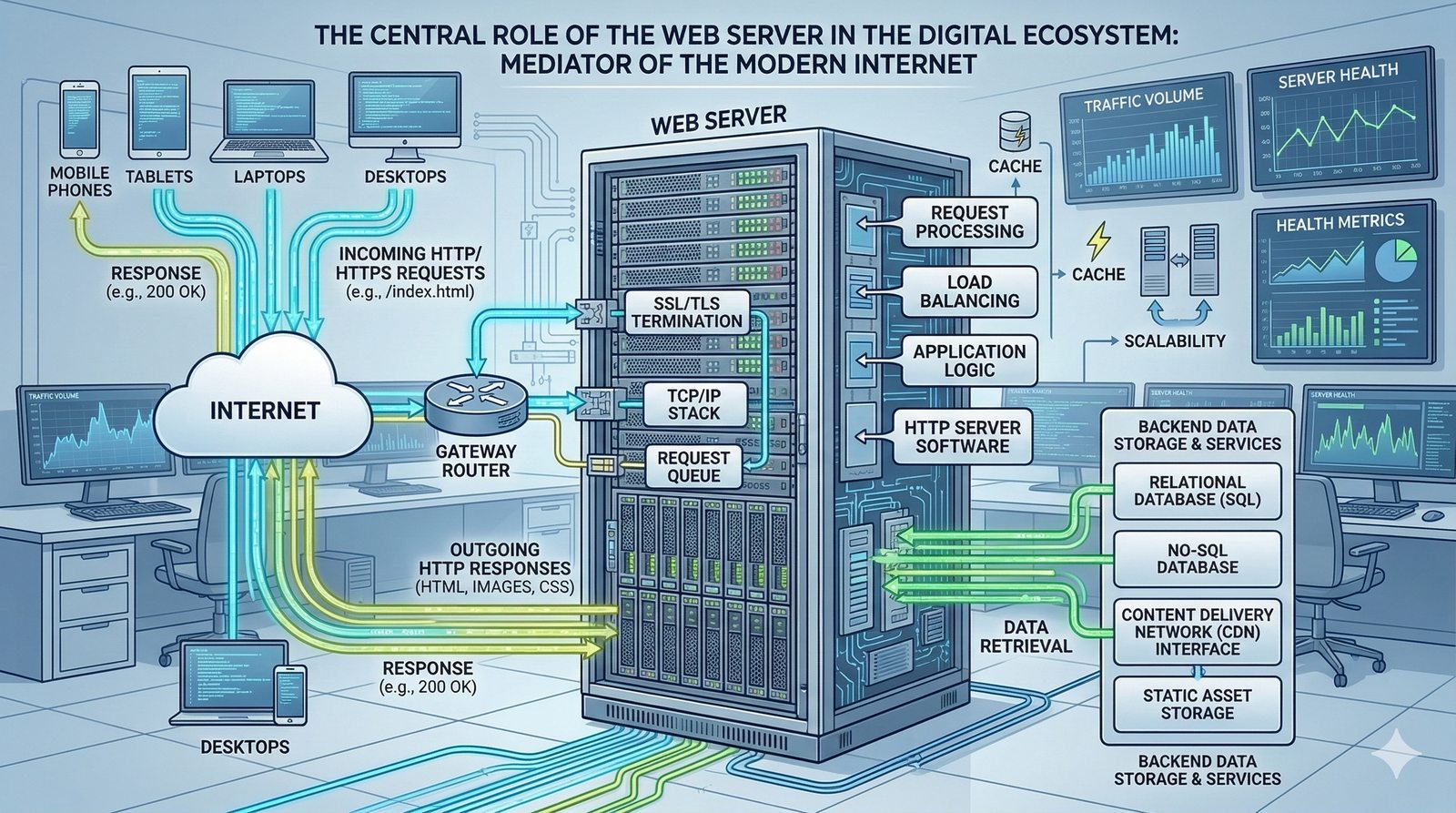

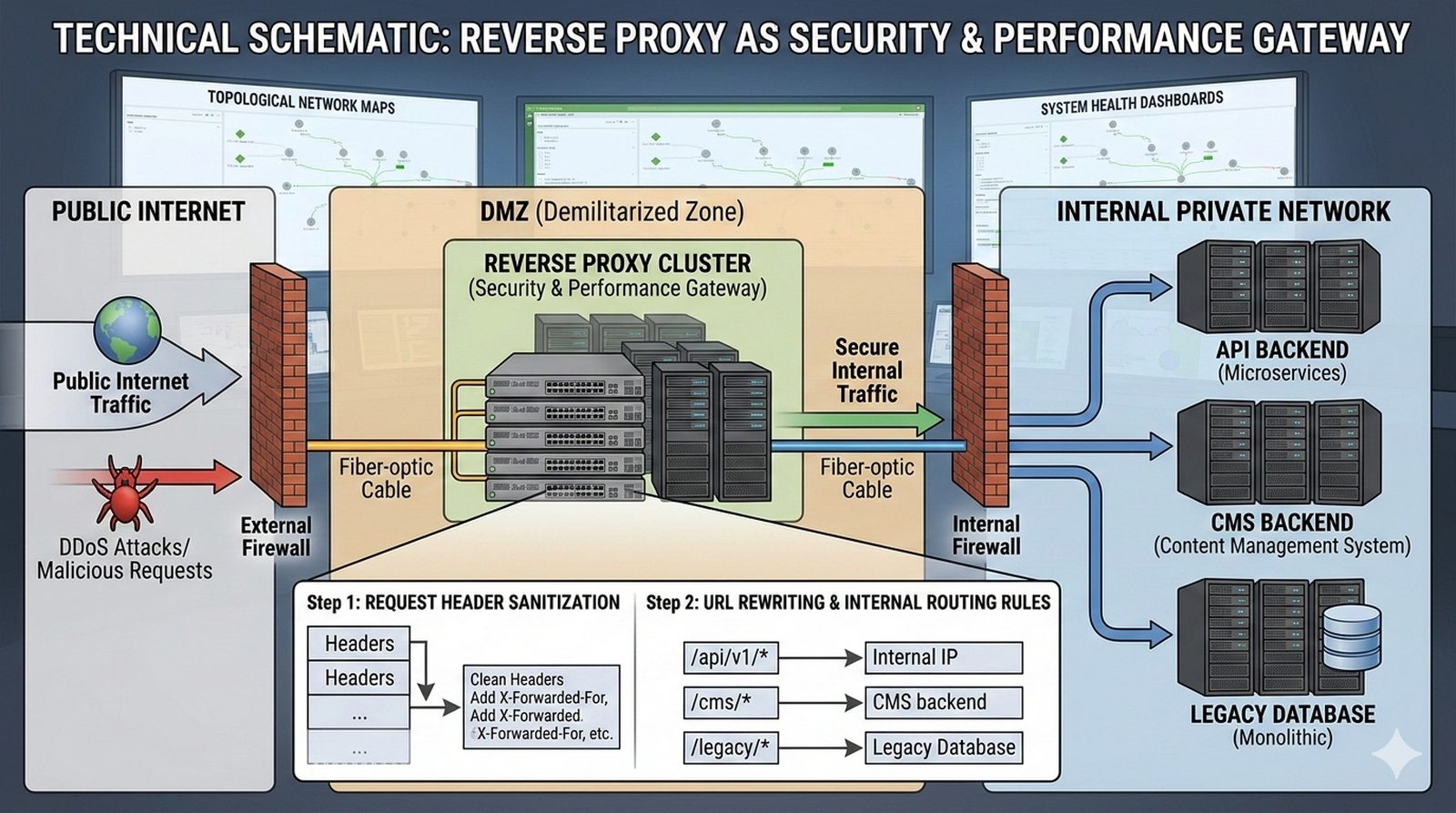

Serwer WWW to oprogramowanie, które stanowi fundament obecności w Internecie, działając jako pośrednik między zasobami na serwerze a przeglądarką internetową użytkownika. Jego podstawowym zadaniem jest nasłuchiwanie na żądania przychodzące za pośrednictwem protokołu HTTP lub HTTPS, a następnie wyszukiwanie i dostarczanie odpowiednich zasobów, takich jak strony HTML, obrazy czy pliki stylów. Oprócz serwowania statycznej treści, nowoczesne serwery WWW pełnią wiele dodatkowych funkcji, w tym zarządzanie bezpieczeństwem, równoważenie obciążenia oraz dynamiczne generowanie treści we współpracy z serwerami aplikacyjnymi.

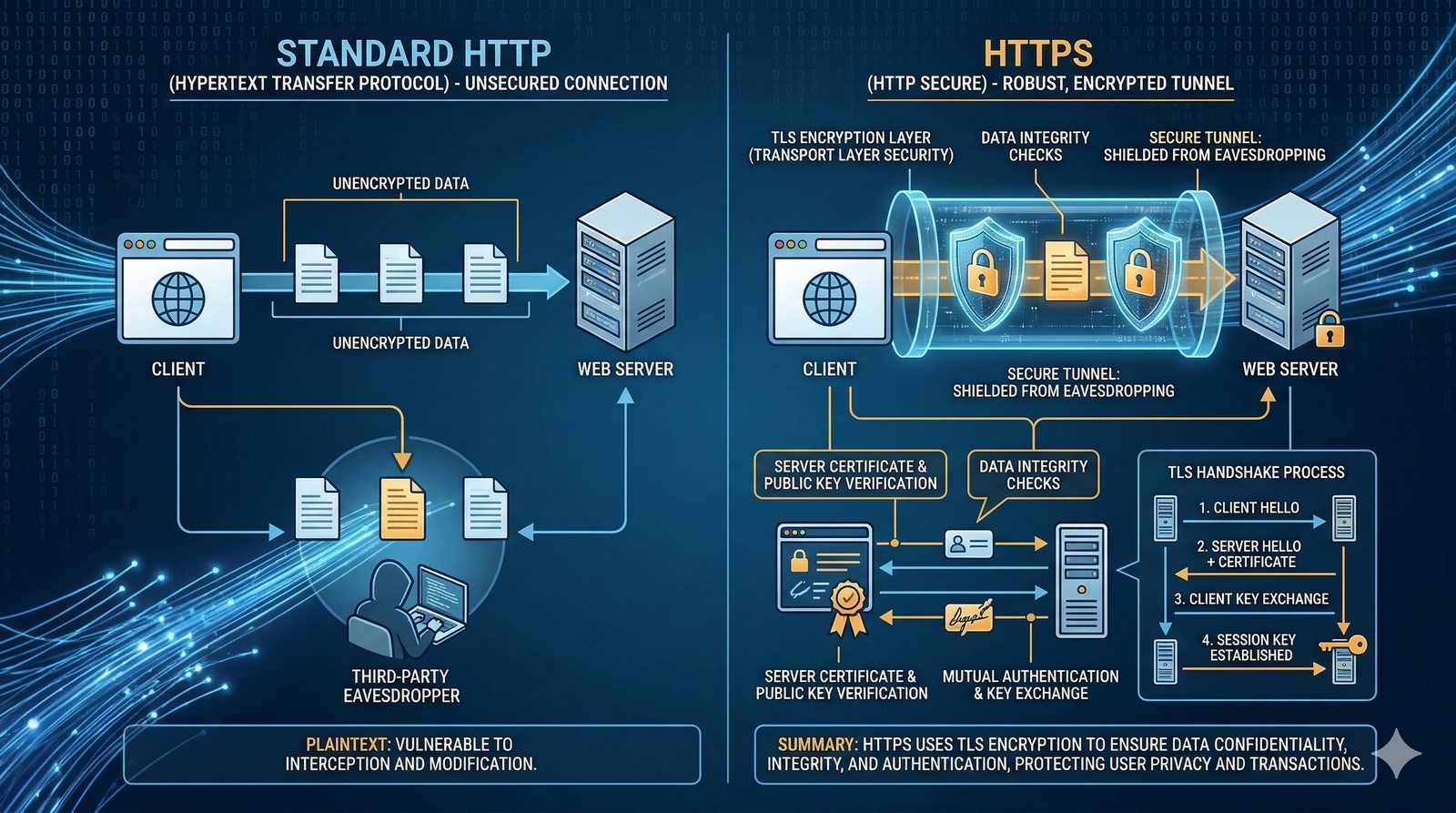

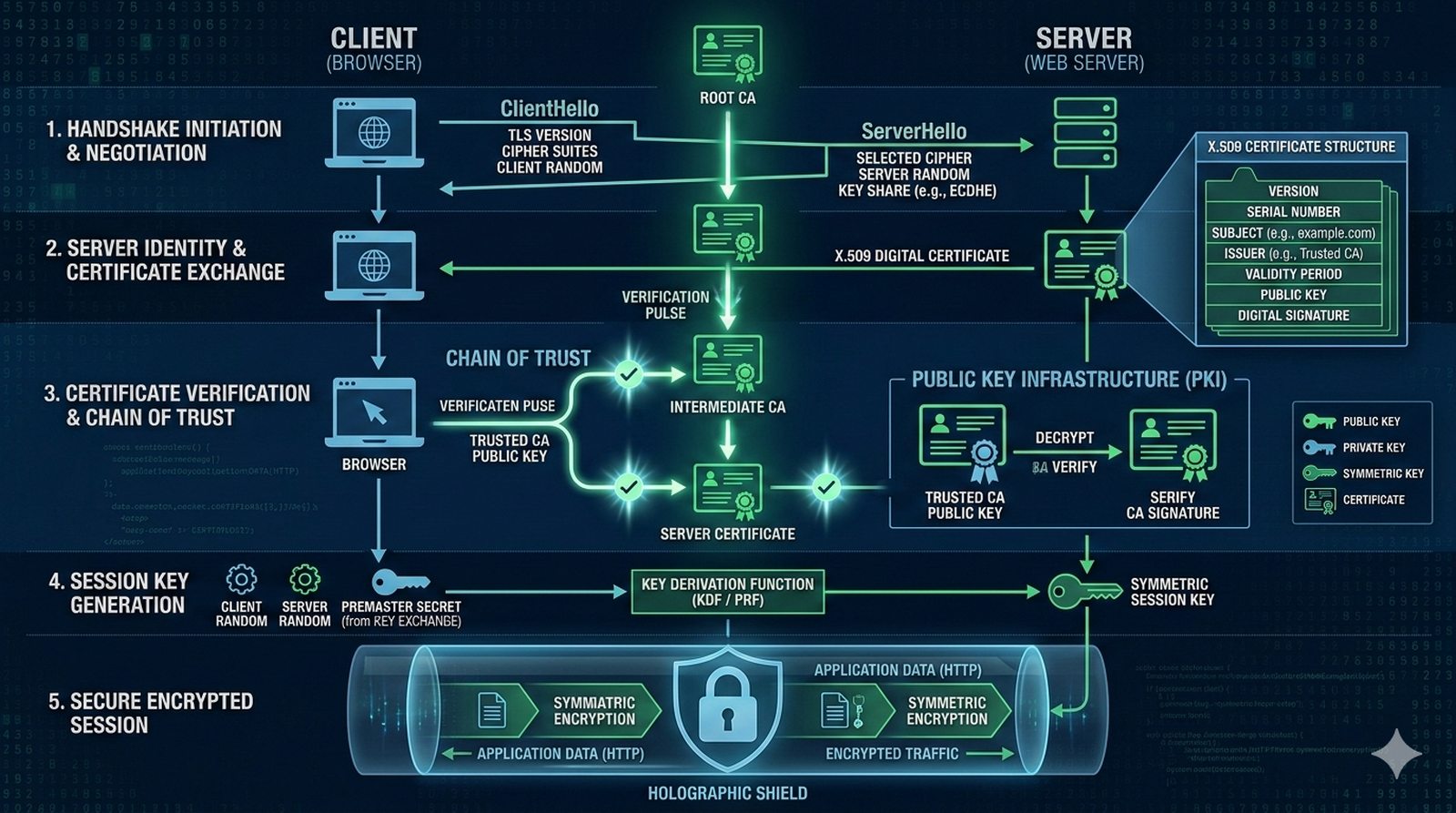

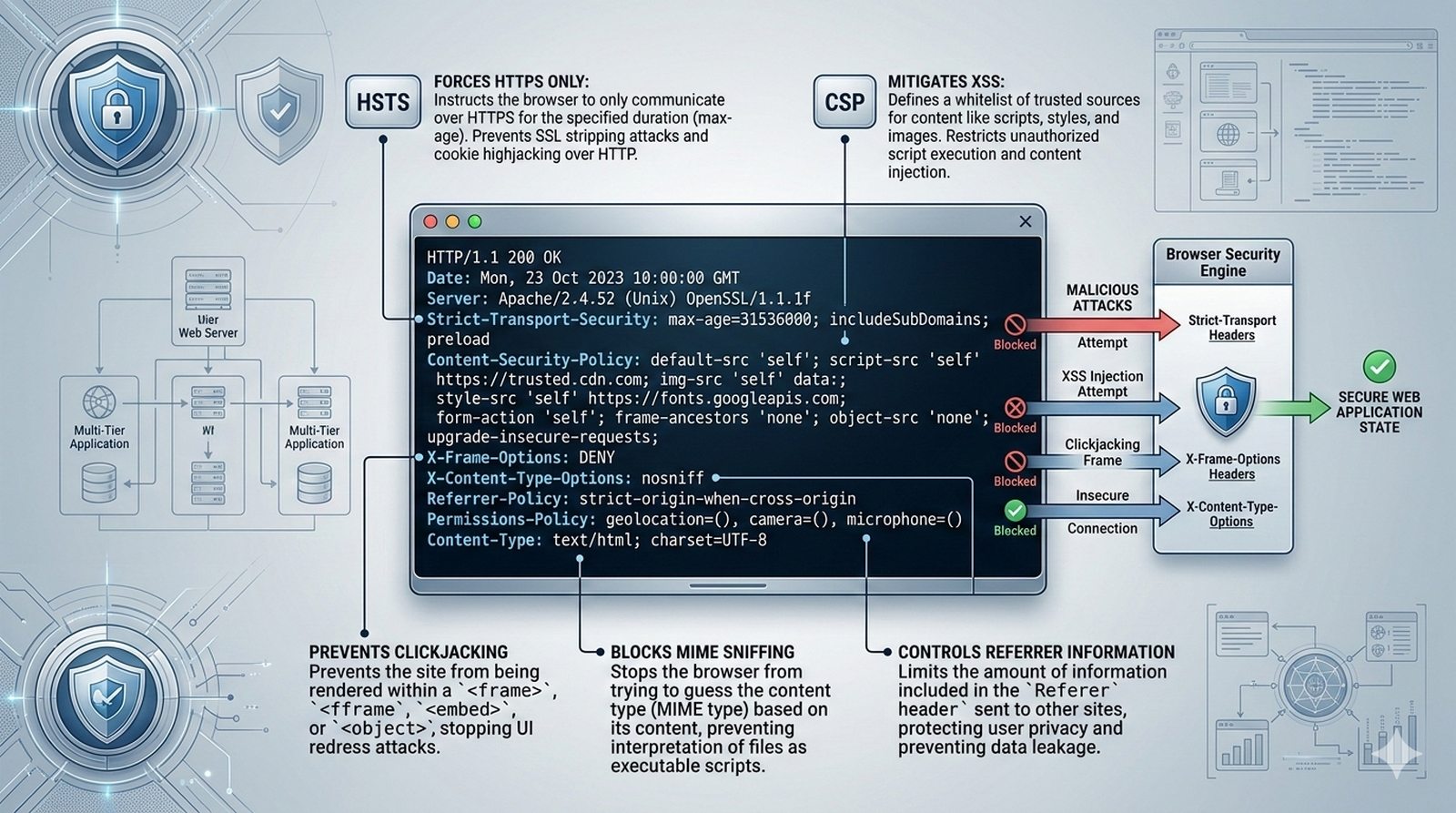

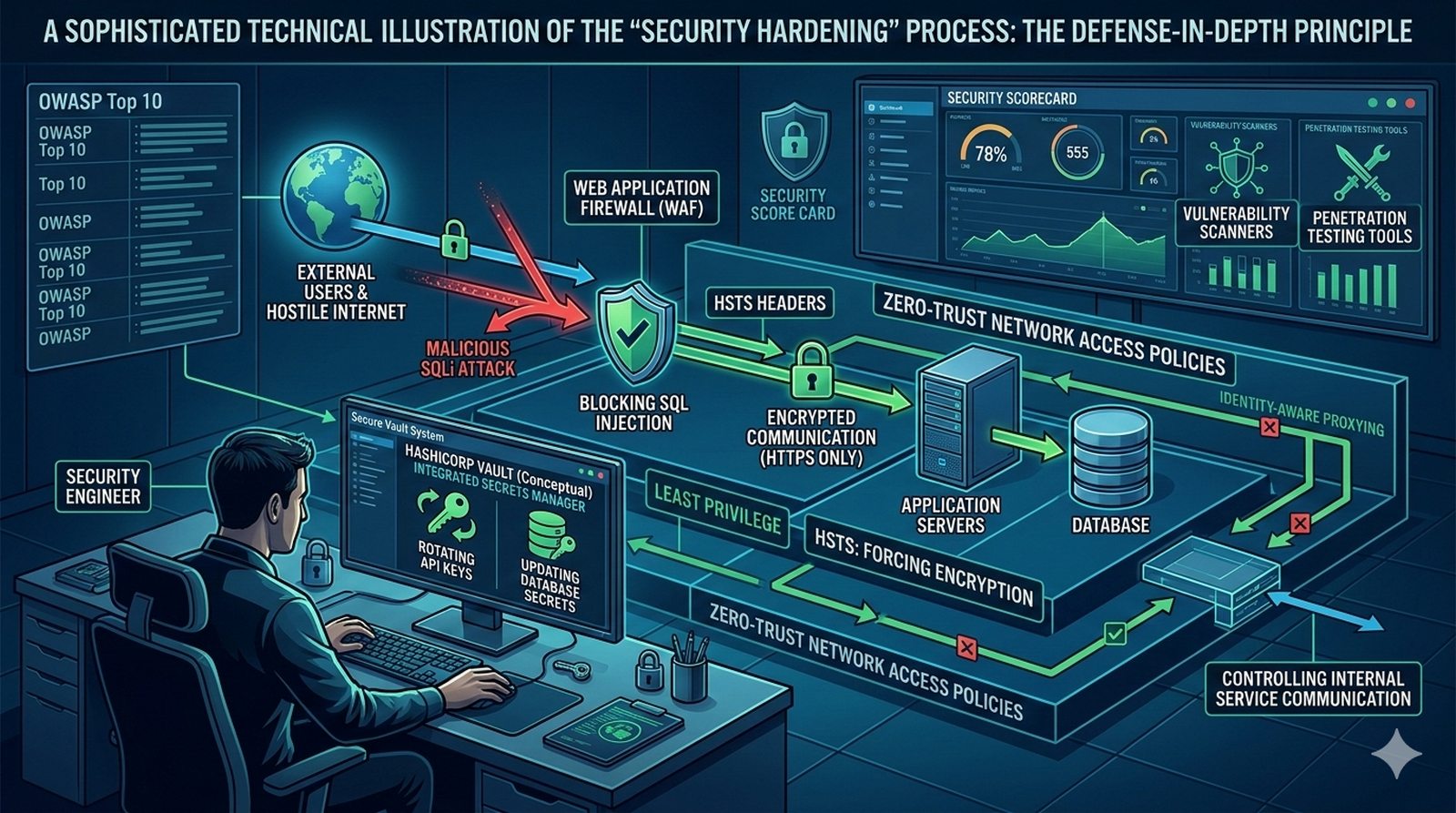

Protokół transferu hipertekstu (HTTP, Hypertext Transfer Protocol) to protokół komunikacyjny oparty na modelu żądanie-odpowiedź, stanowiący podstawę wymiany danych w sieci WWW. HTTPS (HTTP Secure) to jego bezpieczna wersja, która szyfruje całą komunikację między klientem a serwerem przy użyciu protokołu TLS (Transport Layer Security). Szyfrowanie to zapewnia poufność, integralność i autentyczność przesyłanych danych, chroniąc je przed podsłuchem i modyfikacją. Obecnie stosowanie HTTPS jest standardem, niezbędnym do ochrony danych logowania, transakcji finansowych i zapewnienia prywatności użytkowników.