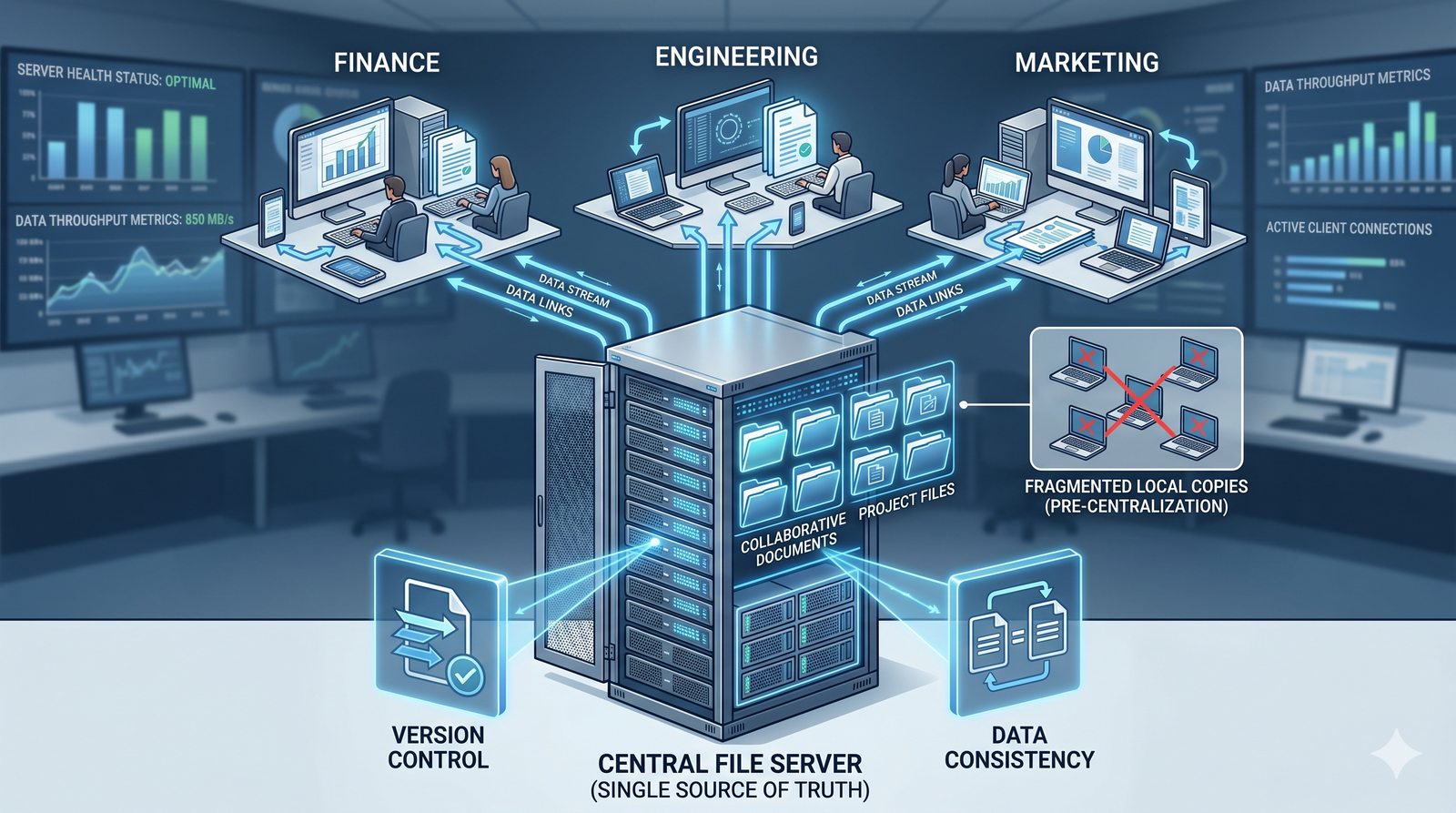

Usługi plików stanowią kręgosłup centralizacji i współdzielenia danych w środowiskach sieciowych. Ich fundamentalną rolą jest umożliwienie wielu użytkownikom i aplikacjom jednoczesnego dostępu do tego samego zbioru plików, tak jakby znajdowały się one na ich lokalnym dysku. Eliminuje to potrzebę kopiowania danych między komputerami, co prowadzi do problemów z kontrolą wersji i spójnością. Centralne przechowywanie danych ułatwia również zarządzanie nimi, w tym tworzenie kopii zapasowych, kontrolowanie dostępu i wdrażanie polityk bezpieczeństwa, co jest kluczowe dla każdej organizacji.

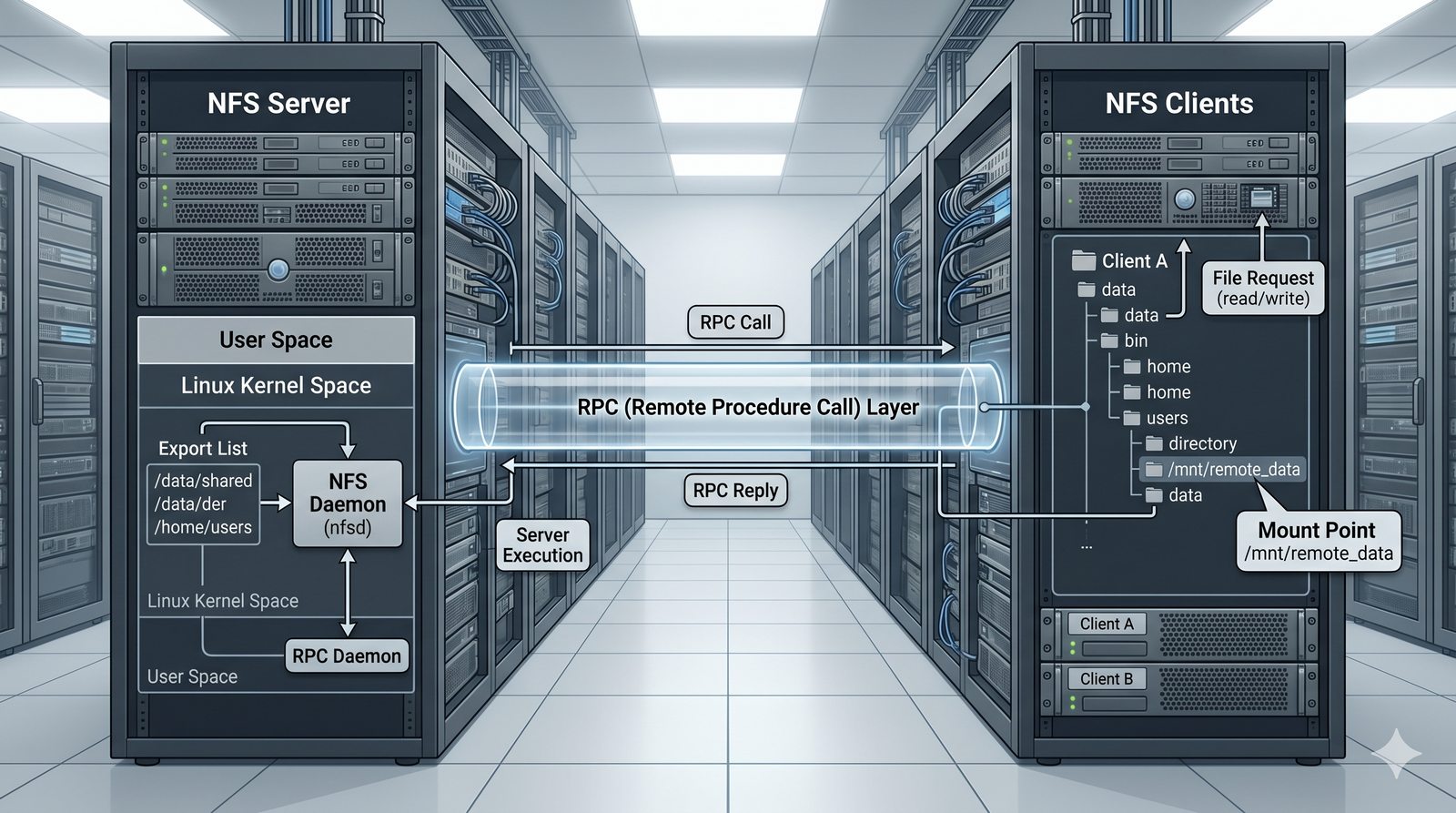

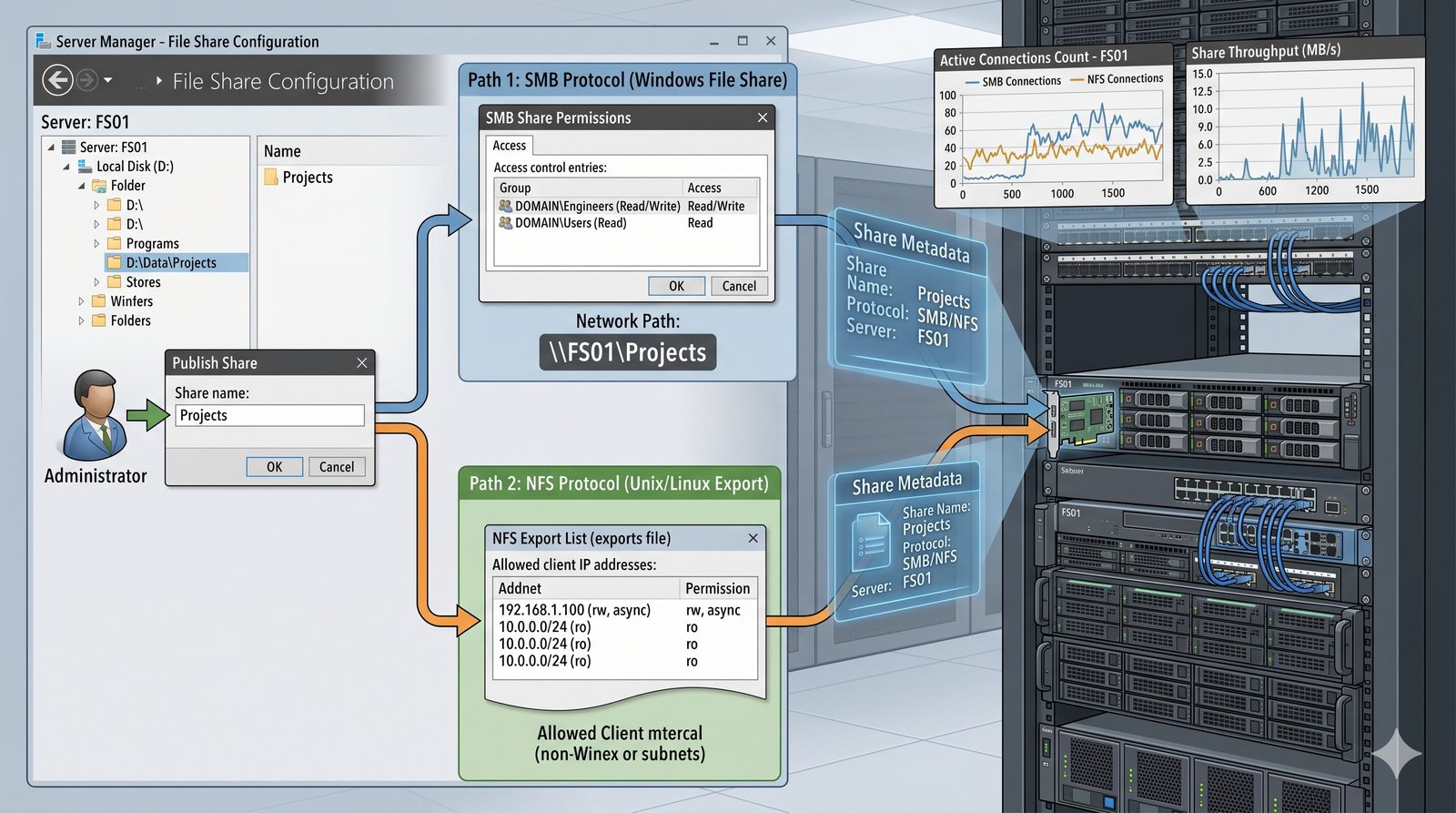

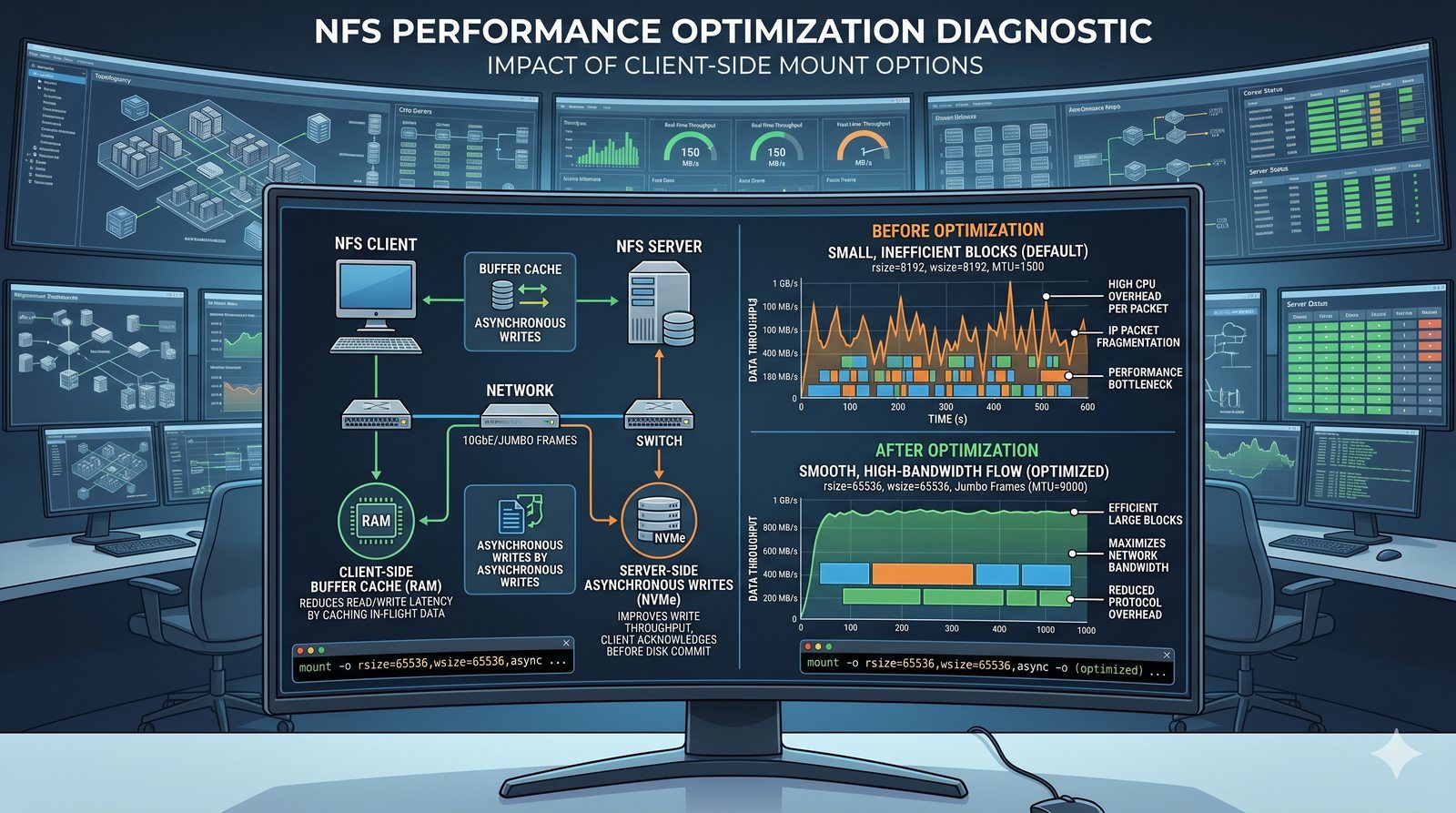

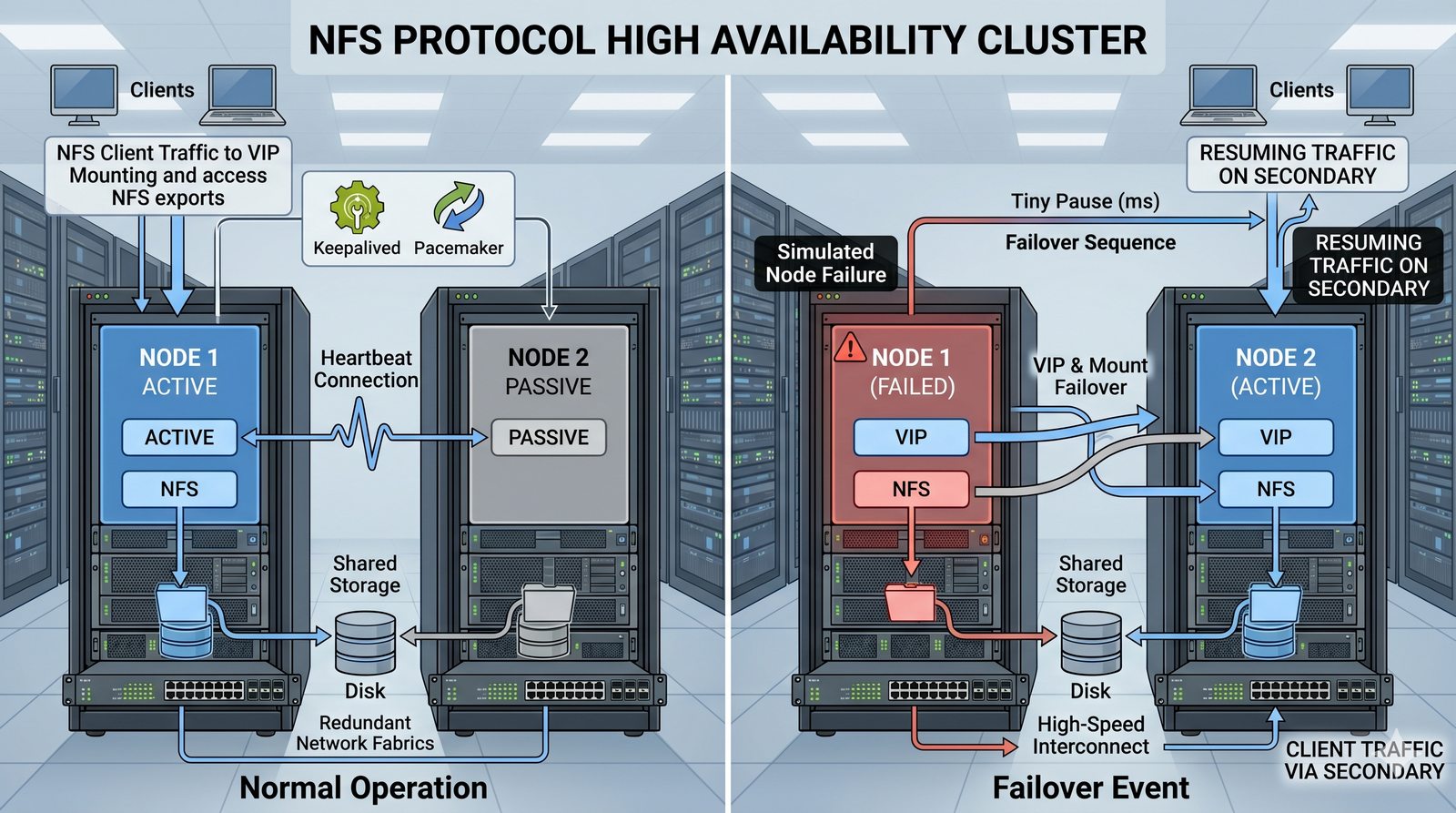

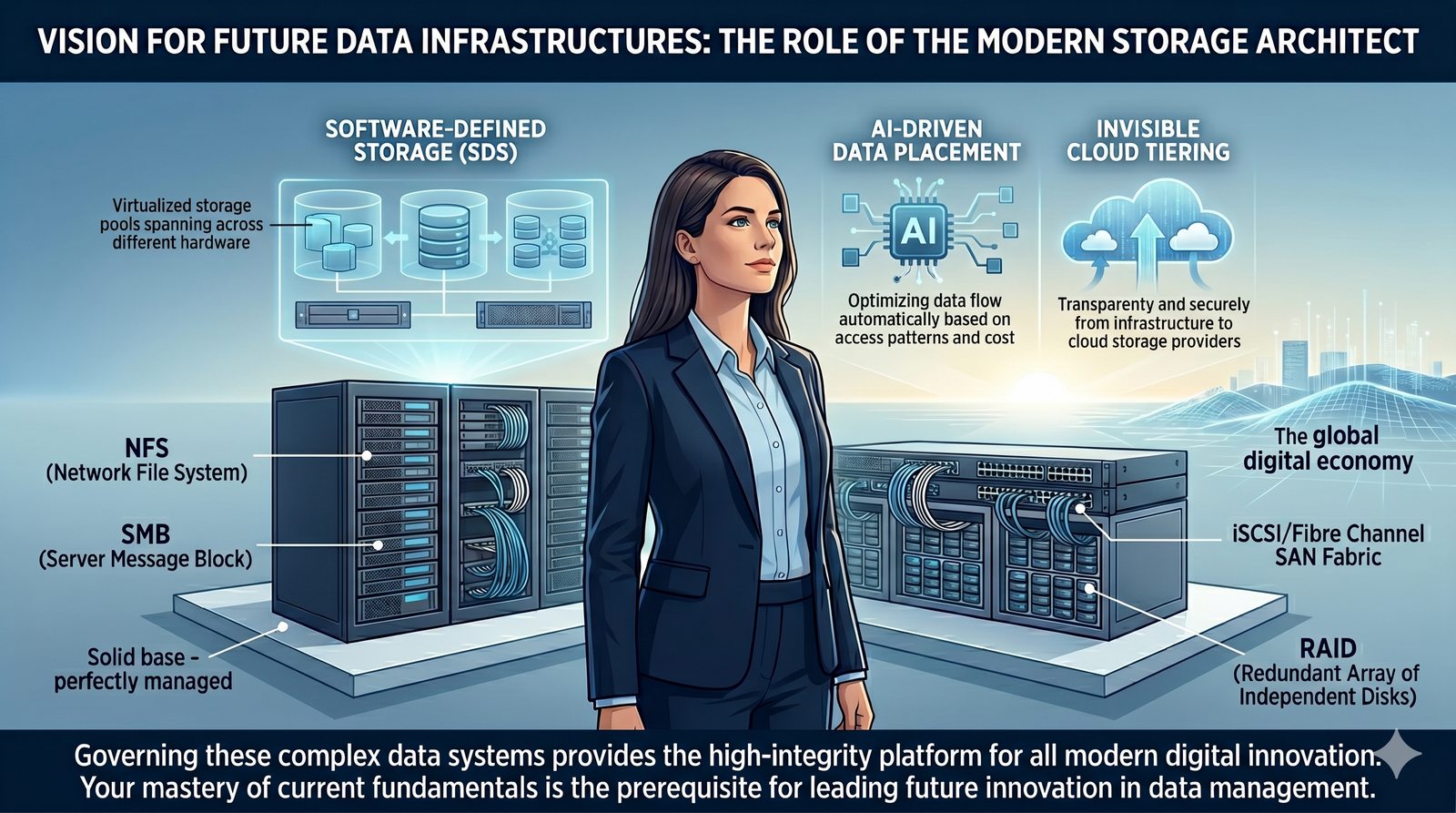

Sieciowy System Plików (NFS, Network File System) to protokół pierwotnie opracowany przez Sun Microsystems, który stał się standardem udostępniania plików w środowiskach uniksowych i linuksowych. Działa on w architekturze klient-serwer, gdzie serwer eksportuje określone katalogi ze swojego lokalnego systemu plików. Klient, po uzyskaniu odpowiednich uprawnień, montuje te zdalne katalogi w swoim własnym drzewie katalogów, co sprawia, że stają się one przezroczyste dla użytkownika i aplikacji. Komunikacja w NFS opiera się na zdalnym wywoływaniu procedur (RPC), co pozwala klientowi na wykonywanie operacji na plikach tak, jakby były one lokalne.