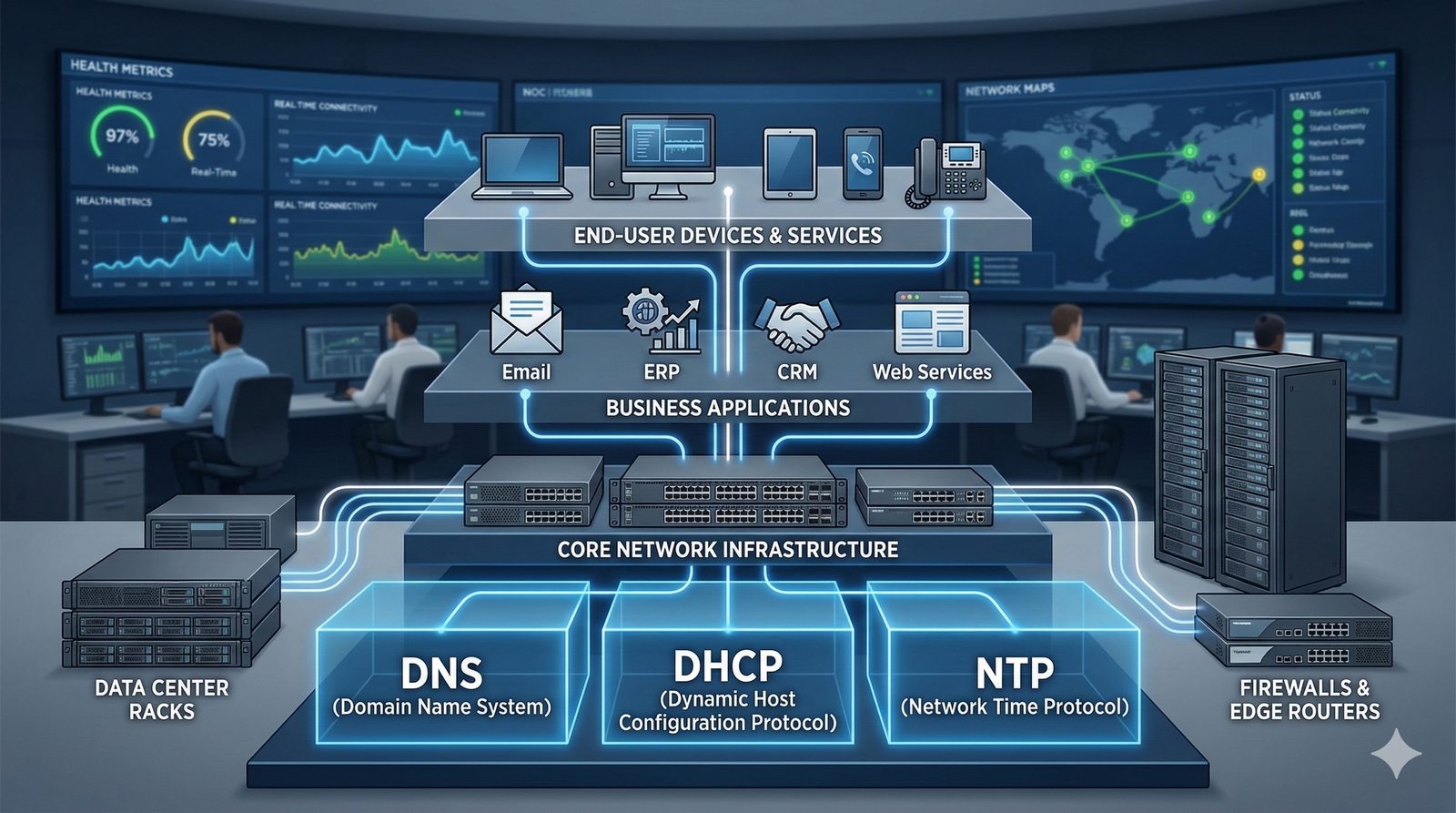

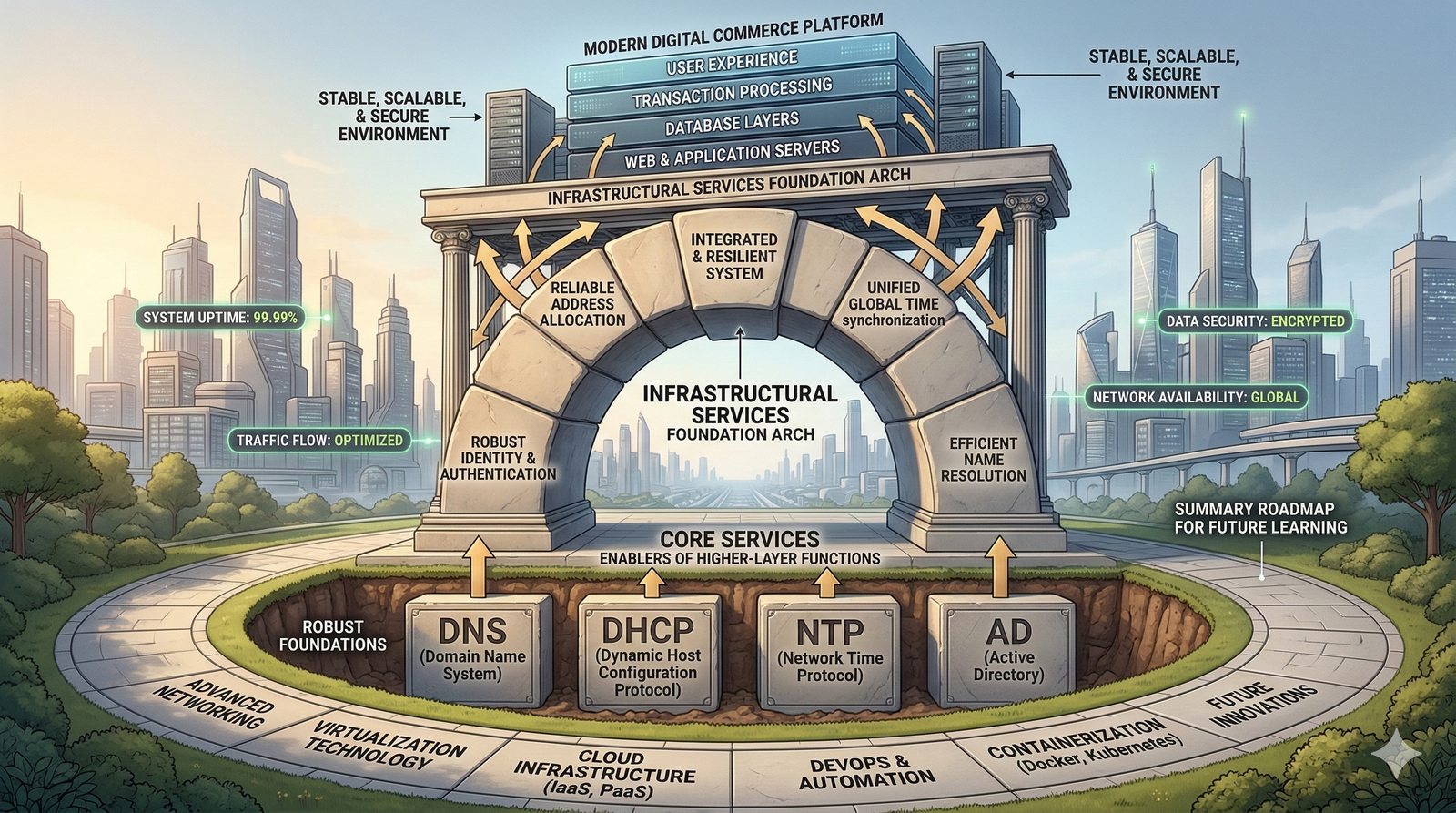

Usługi infrastrukturalne stanowią fundament, na którym opiera się cała komunikacja w sieciach komputerowych. Są to niewidoczne dla przeciętnego użytkownika, lecz absolutnie kluczowe mechanizmy, które umożliwiają urządzeniom odnajdywanie się nawzajem, automatyczne uzyskiwanie konfiguracji sieciowej oraz synchronizację czasu. Usługi takie jak DNS, DHCP i NTP działają w tle, zapewniając, że wyższe warstwy aplikacji i usług mogą funkcjonować płynnie i niezawodnie. Bez nich każda próba połączenia z zasobem w sieci wymagałaby ręcznej konfiguracji i znajomości skomplikowanych adresów numerycznych.

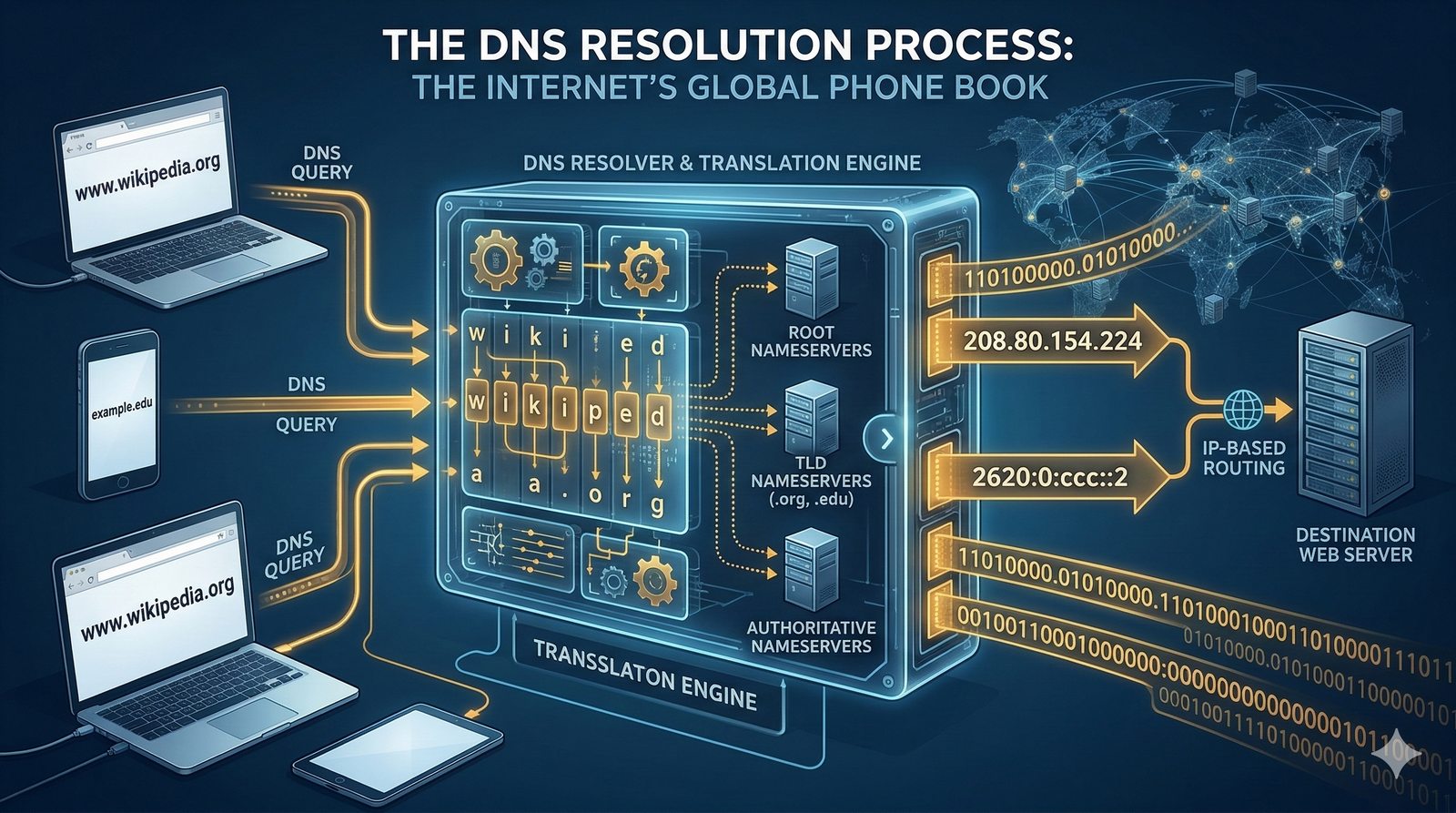

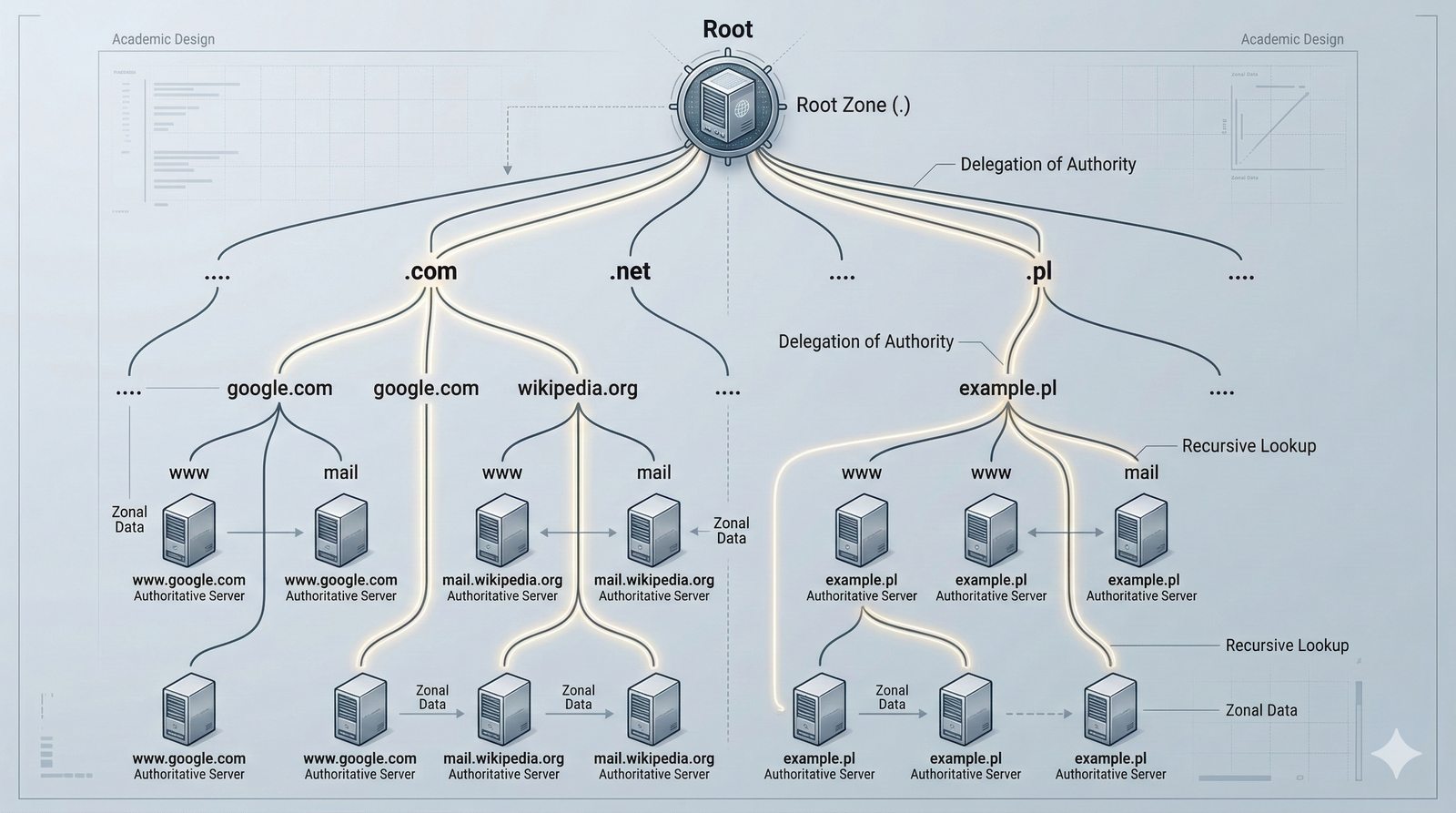

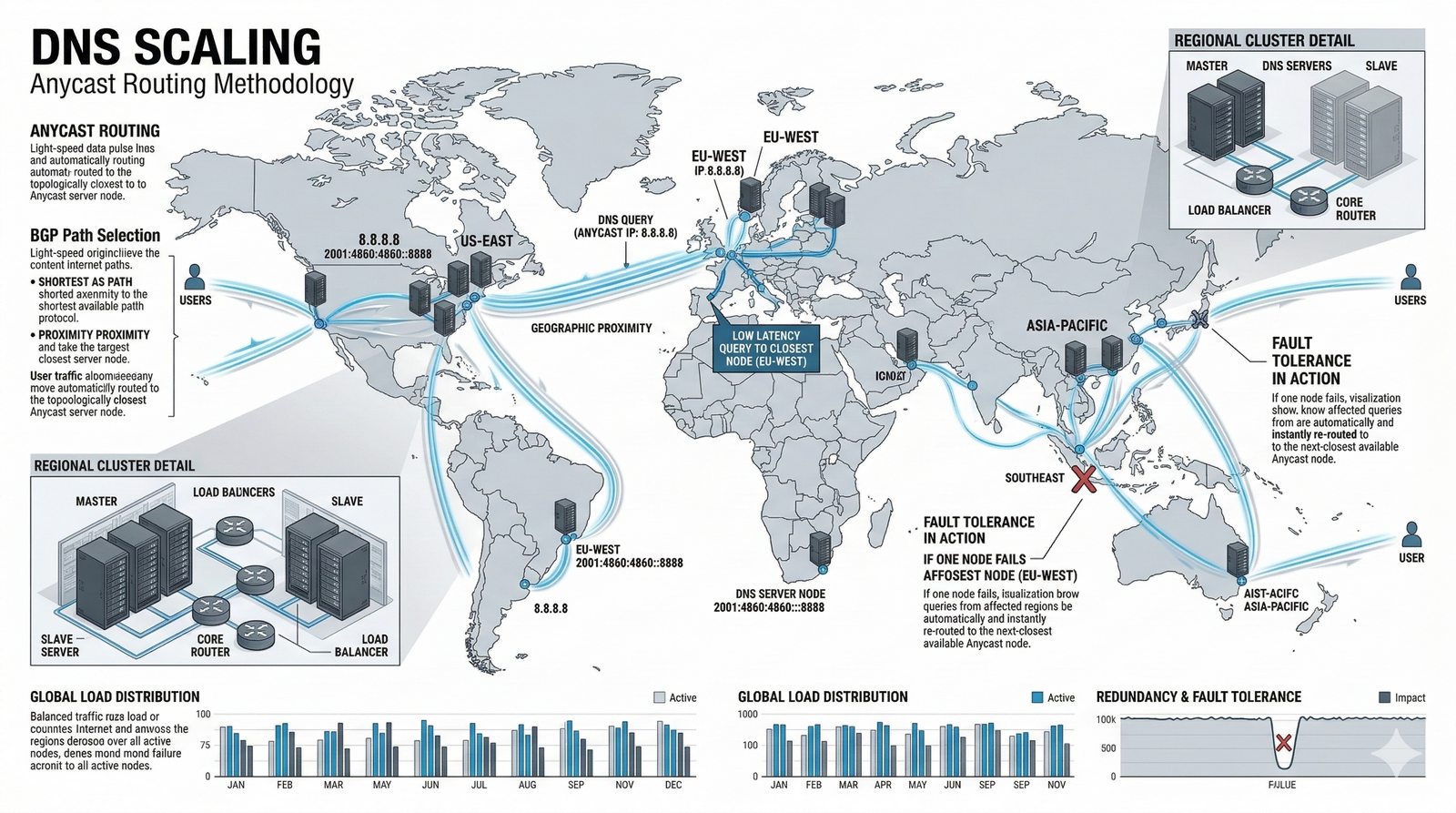

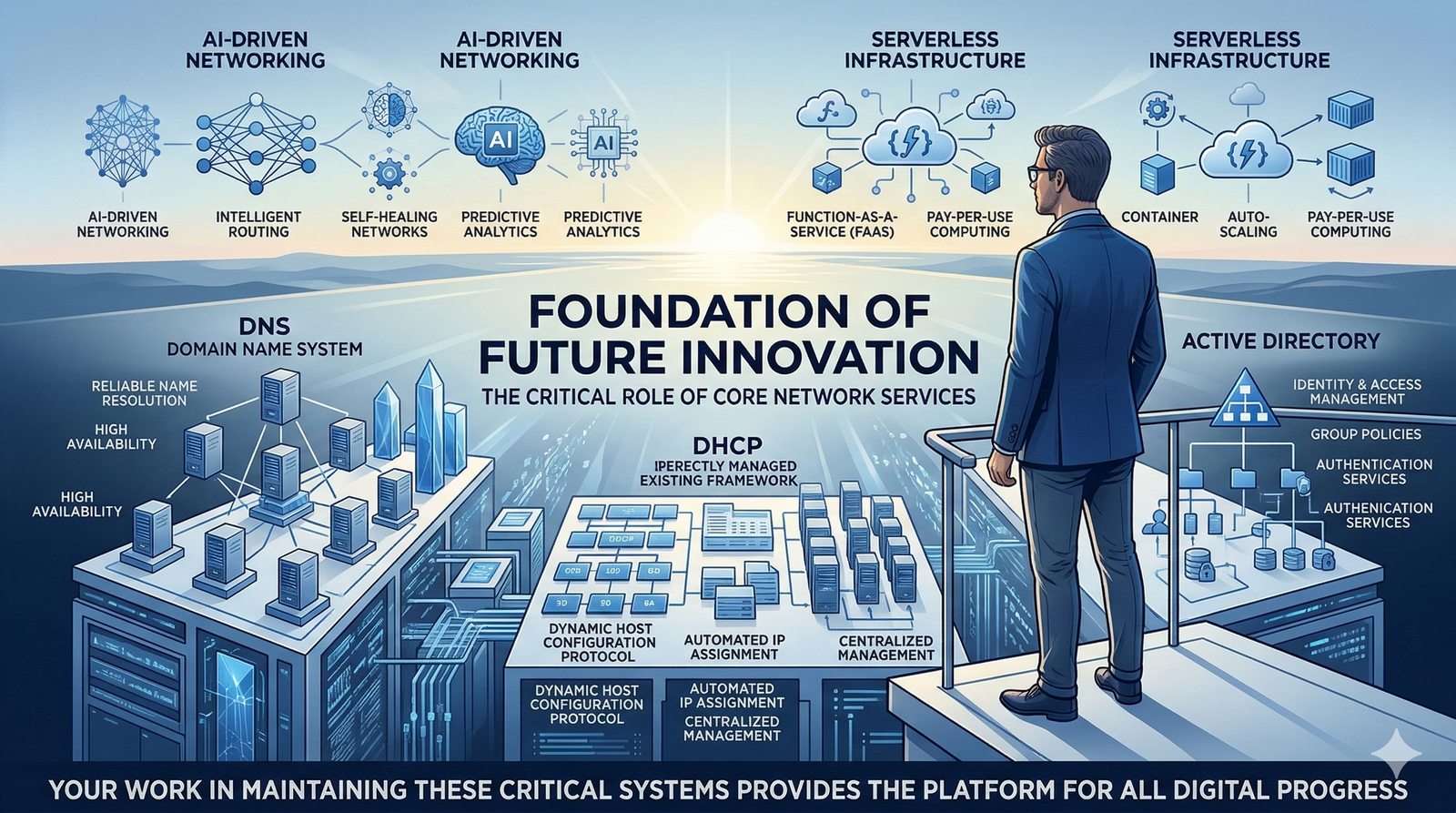

System Nazw Domenowych (DNS, Domain Name System) to rozproszona, hierarchiczna baza danych, której głównym zadaniem jest tłumaczenie zrozumiałych dla ludzi nazw domen (np. www.example.com) na adresy IP (np. 93.184.216.34), które są niezbędne do nawiązania połączenia w sieci. DNS działa jak globalna książka telefoniczna dla Internetu, eliminując potrzebę zapamiętywania przez użytkowników skomplikowanych ciągów cyfr. System ten jest fundamentem niemal każdej transakcji internetowej, od przeglądania stron WWW, przez wysyłanie e-maili, po działanie aplikacji mobilnych.