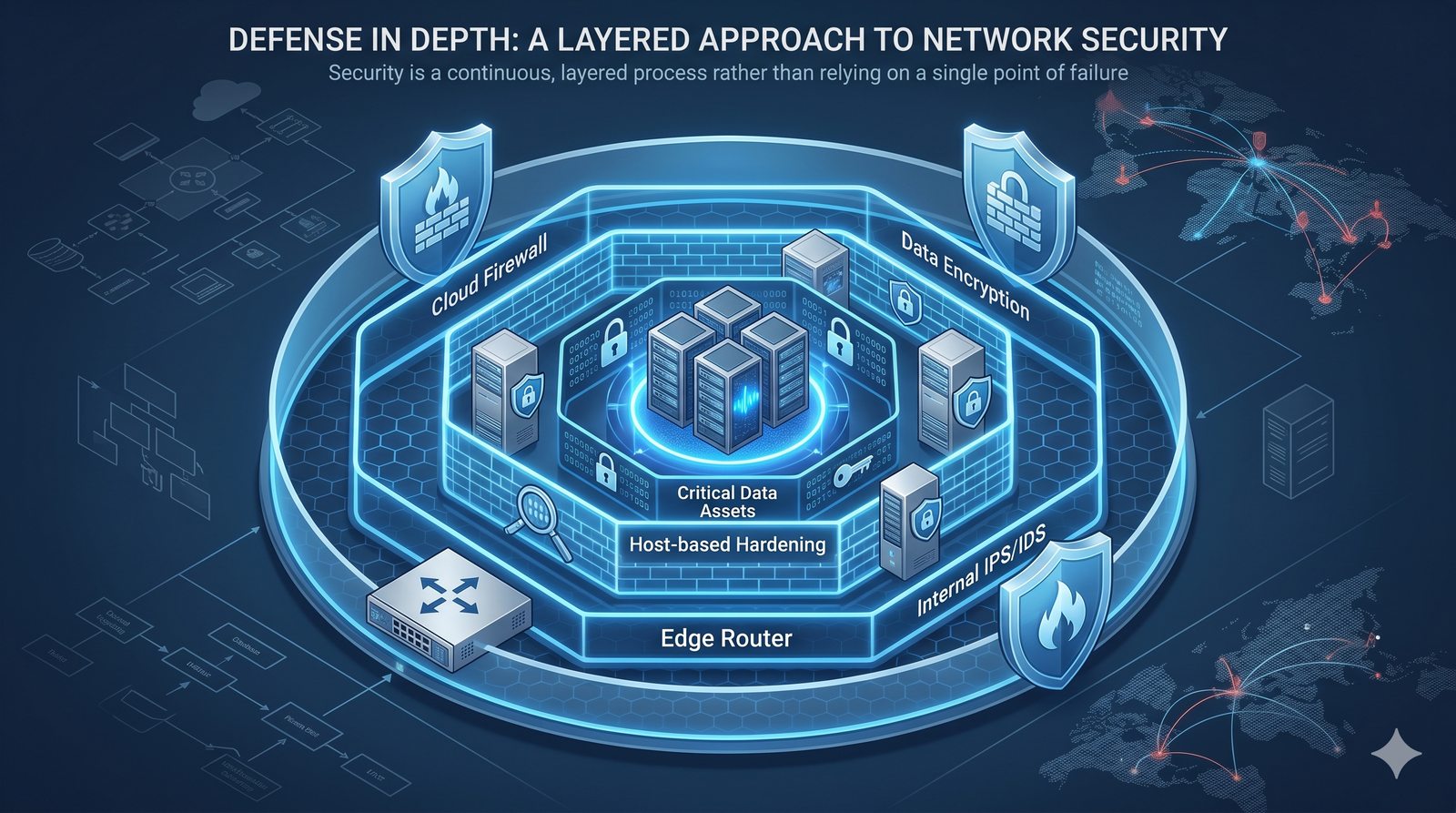

Bezpieczeństwo usług sieciowych to kompleksowa dziedzina obejmująca ochronę infrastruktury, danych i aplikacji przed nieautoryzowanym dostępem, modyfikacją lub zniszczeniem. W dzisiejszym połączonym świecie, gdzie usługi są dostępne globalnie, zapewnienie ich bezpieczeństwa jest absolutnie kluczowe dla ciągłości działania biznesu, ochrony reputacji i zgodności z prawem. Skuteczna strategia bezpieczeństwa opiera się na wielowarstwowym podejściu, znanym jako obrona w głąb (ang. defense in depth), które zakłada, że żadna pojedyncza linia obrony nie jest doskonała.

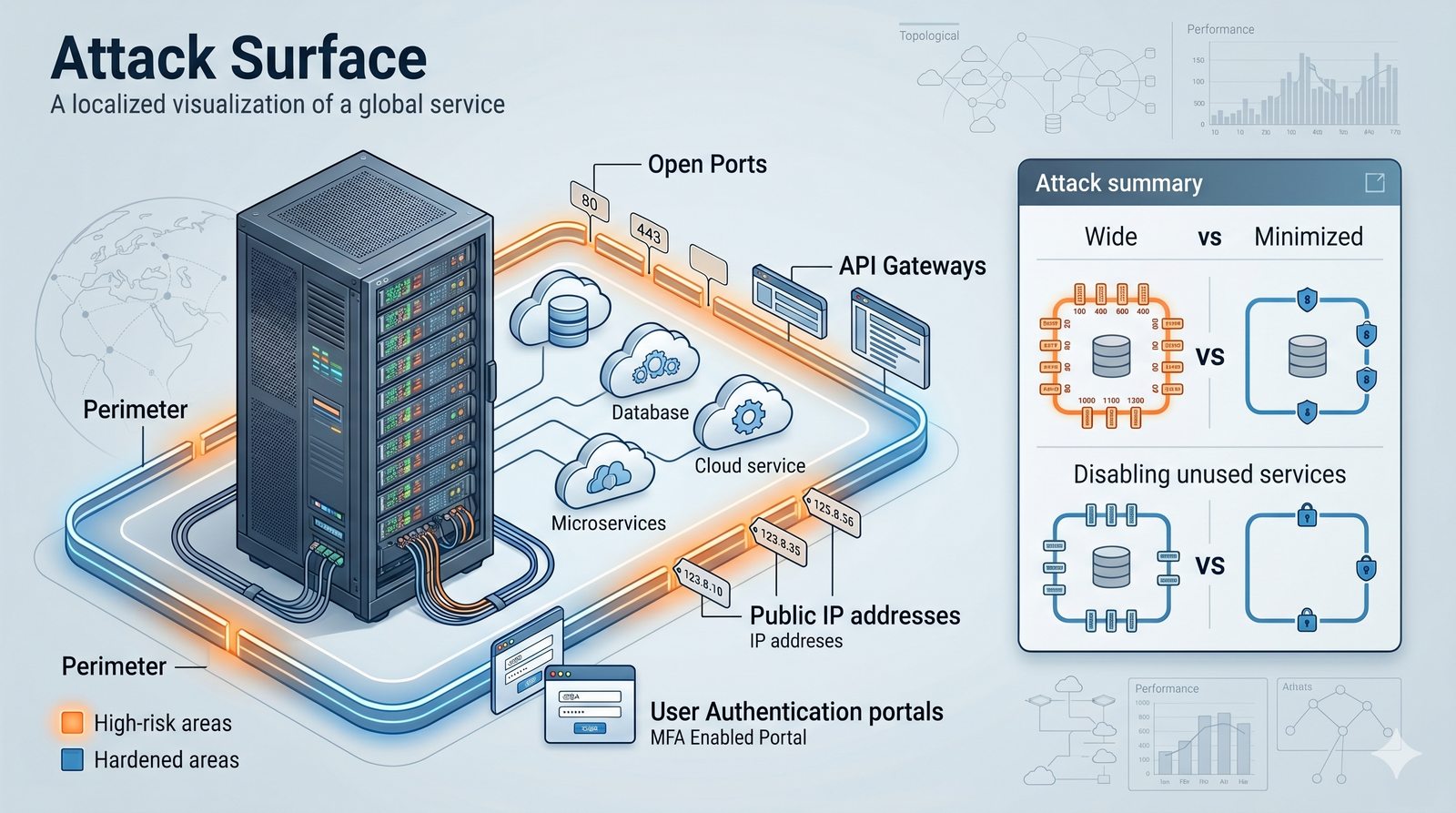

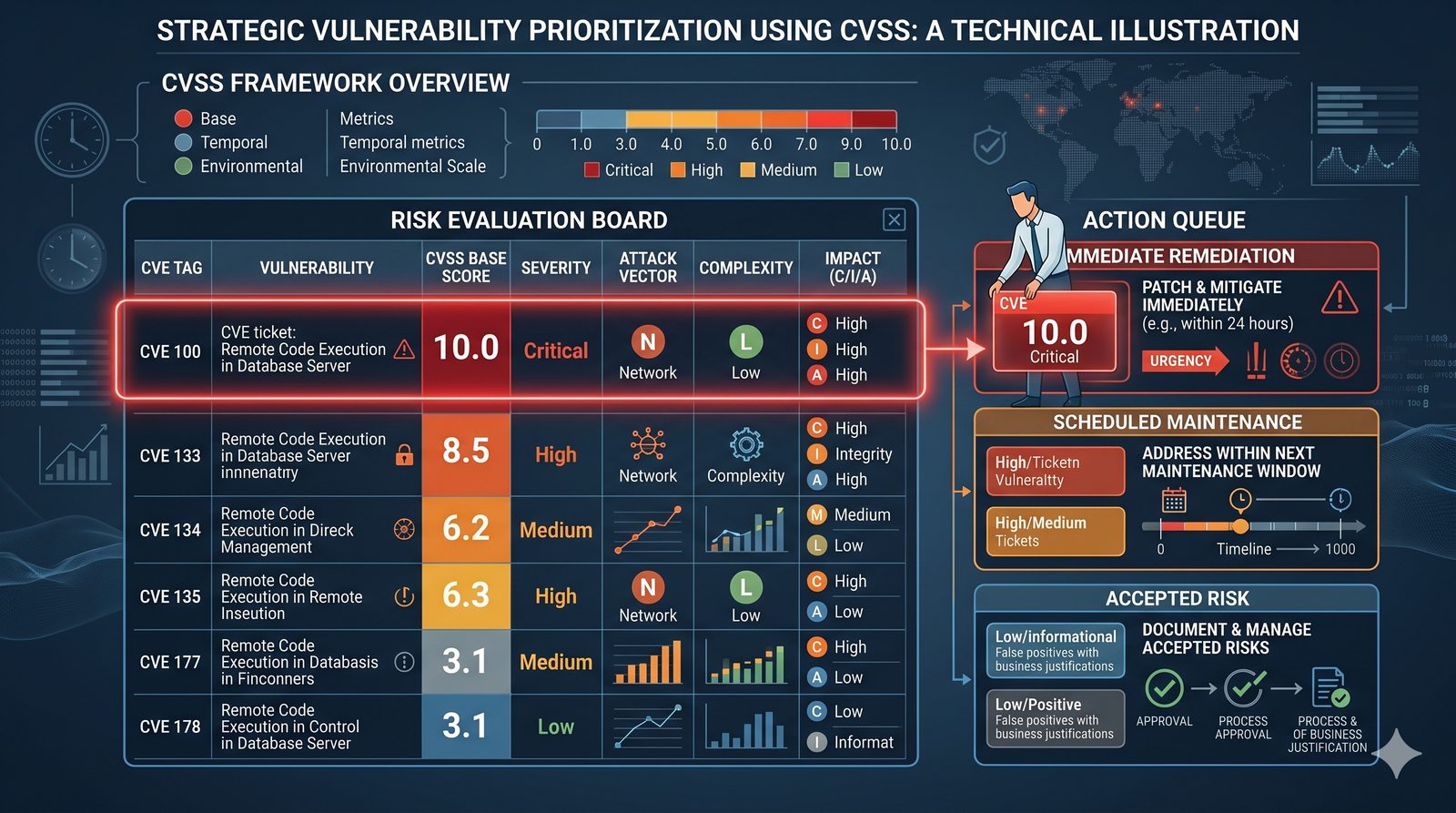

Modelowanie zagrożeń to proaktywny proces identyfikacji potencjalnych zagrożeń i słabości w systemie jeszcze na etapie jego projektowania. Pozwala to na wbudowanie mechanizmów bezpieczeństwa w architekturę, a nie dodawanie ich jako "łaty" po fakcie. Analiza ryzyka to z kolei proces oceny zidentyfikowanych zagrożeń pod kątem prawdopodobieństwa ich wystąpienia oraz potencjalnego wpływu na organizację. Wynik tej analizy pozwala na priorytetyzację działań i świadome podjęcie decyzji, które ryzyka należy zminimalizować, które zaakceptować, a które przenieść (np. poprzez ubezpieczenie).