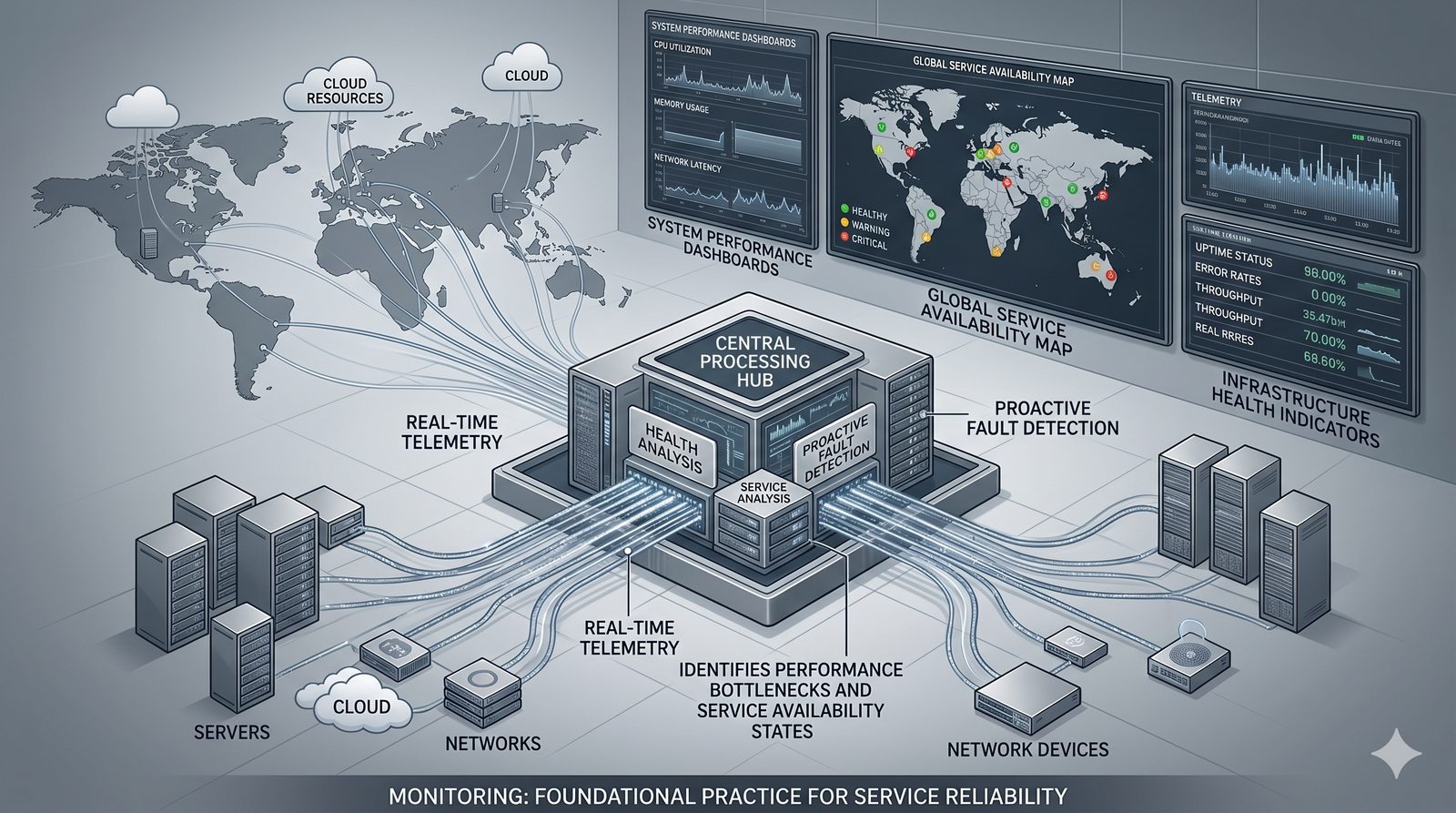

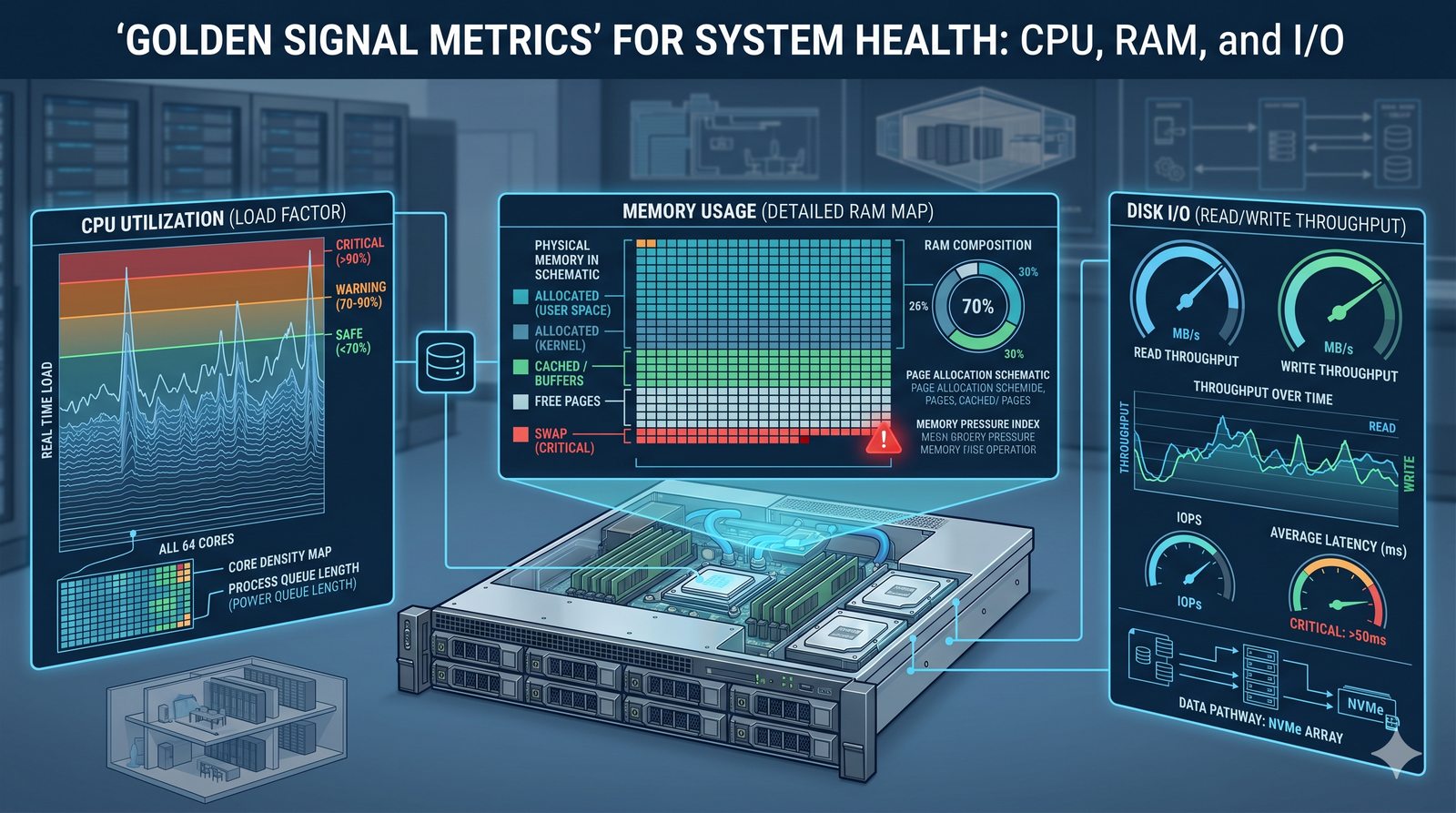

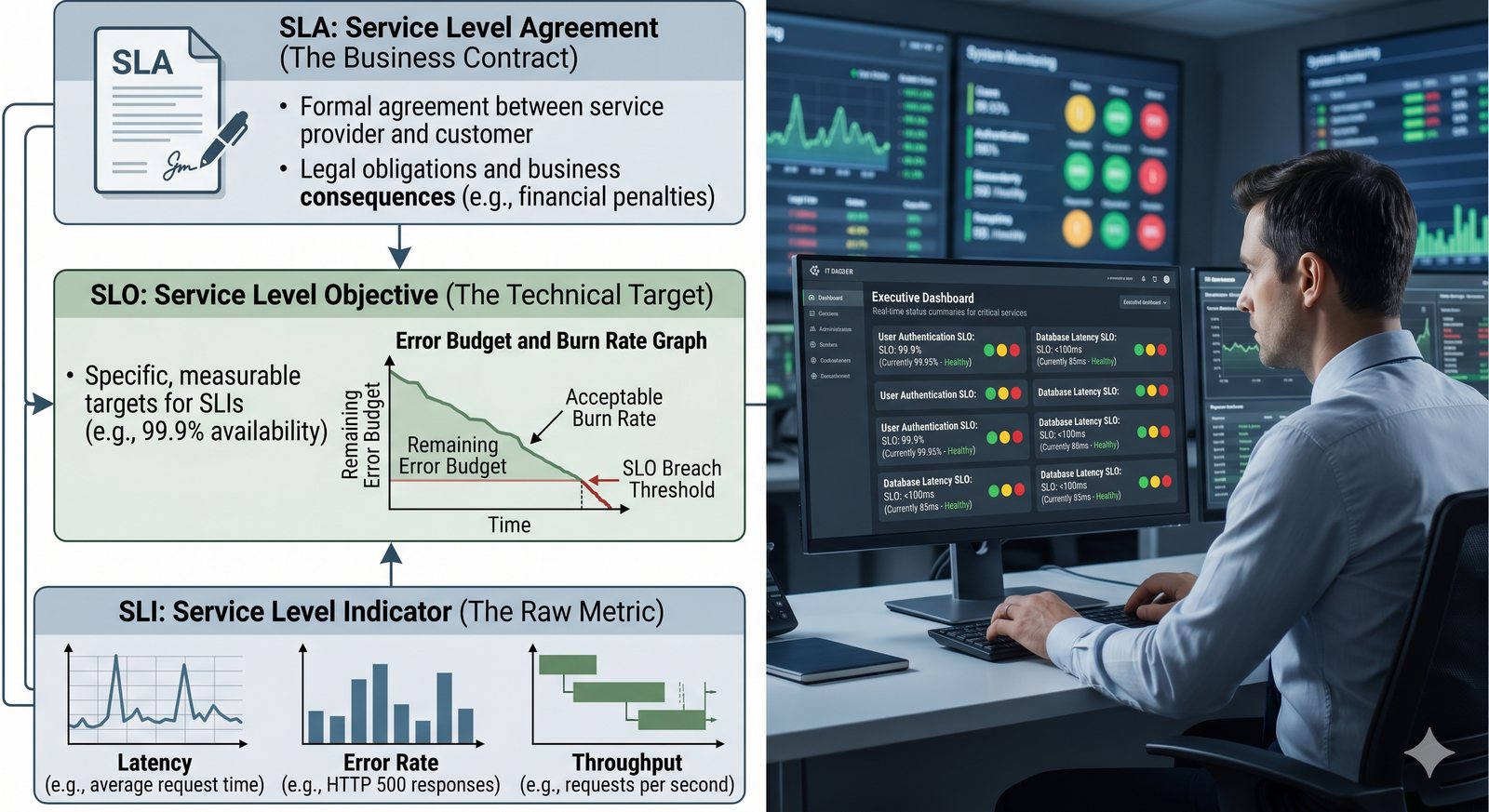

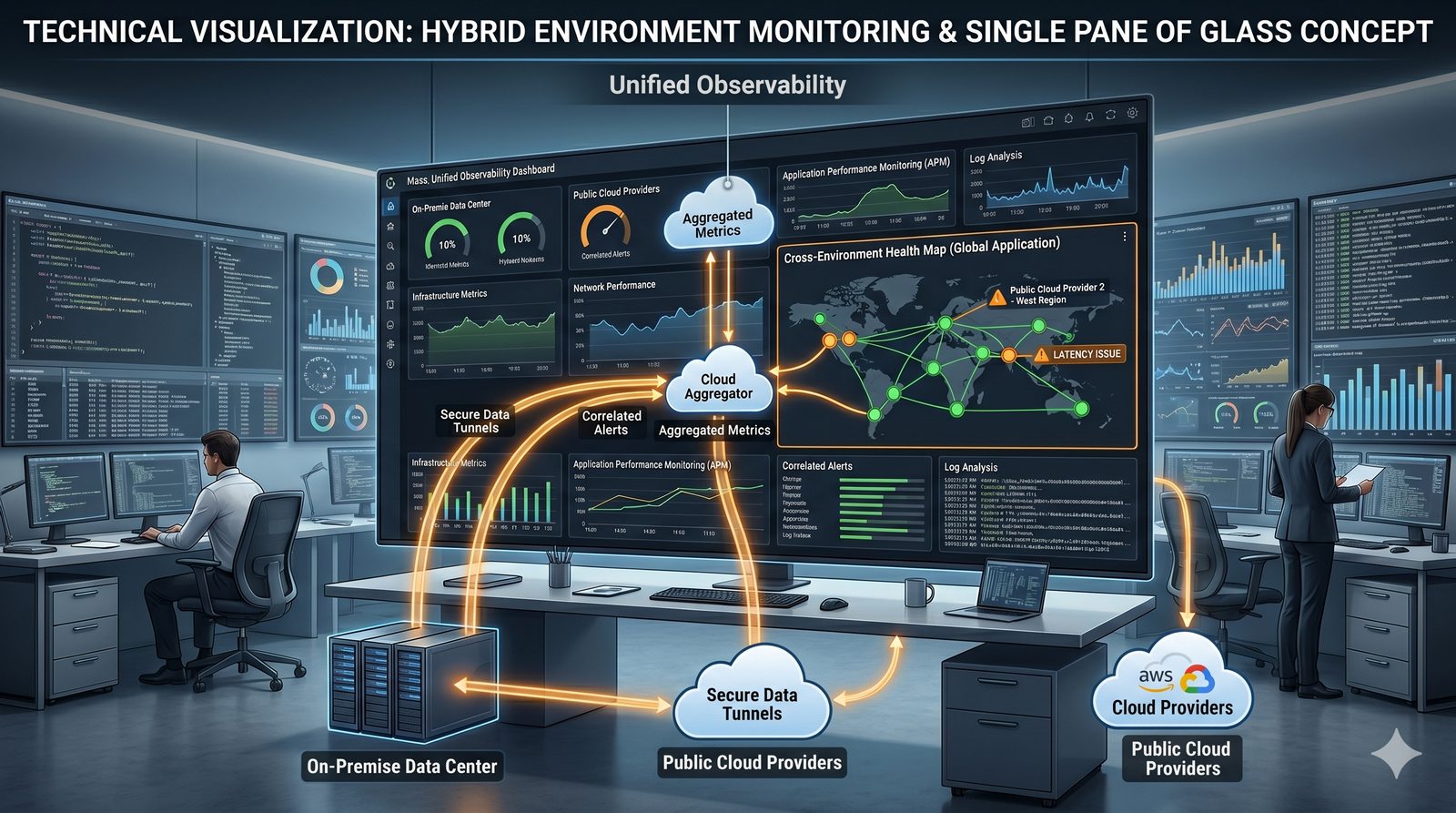

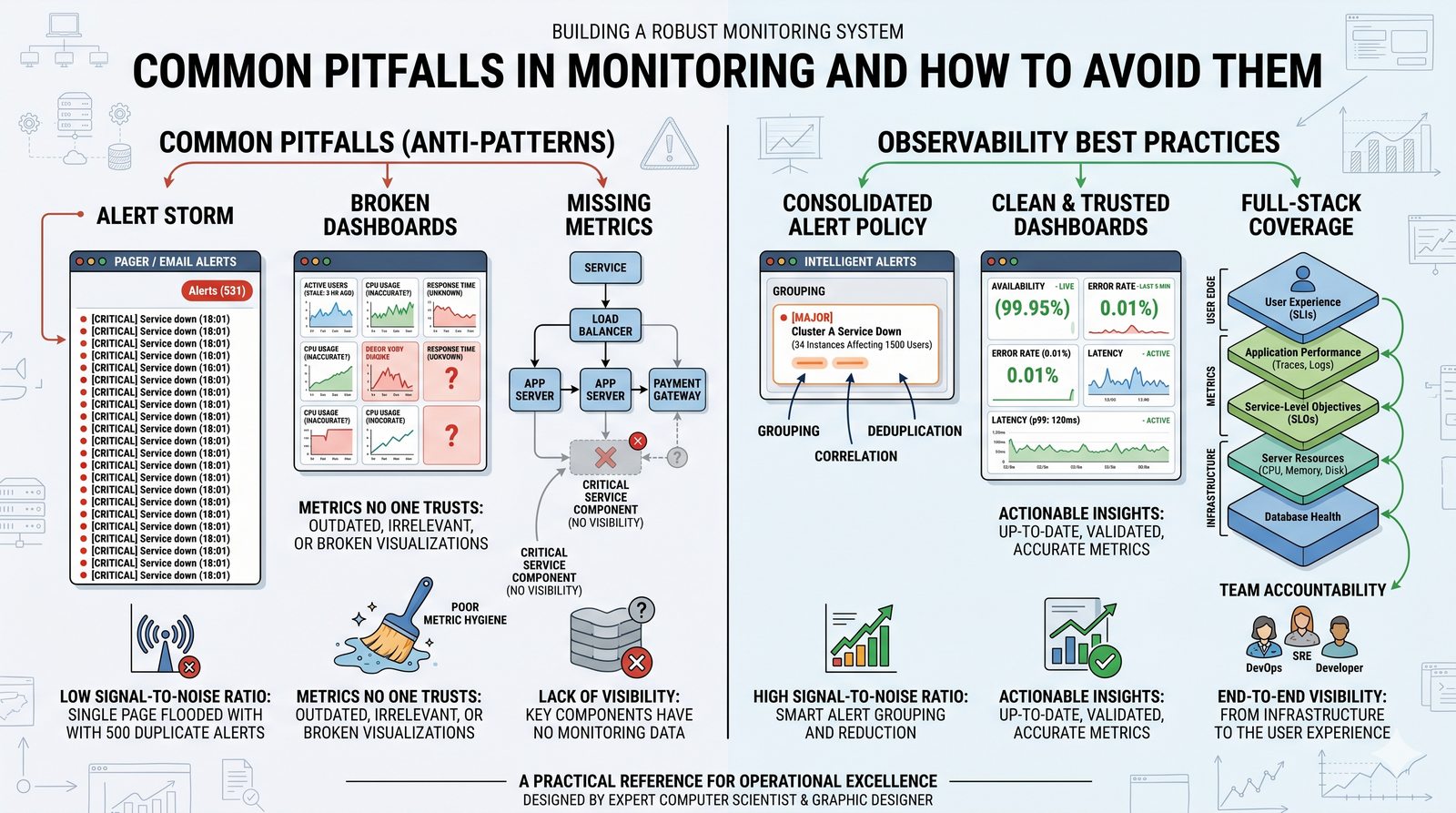

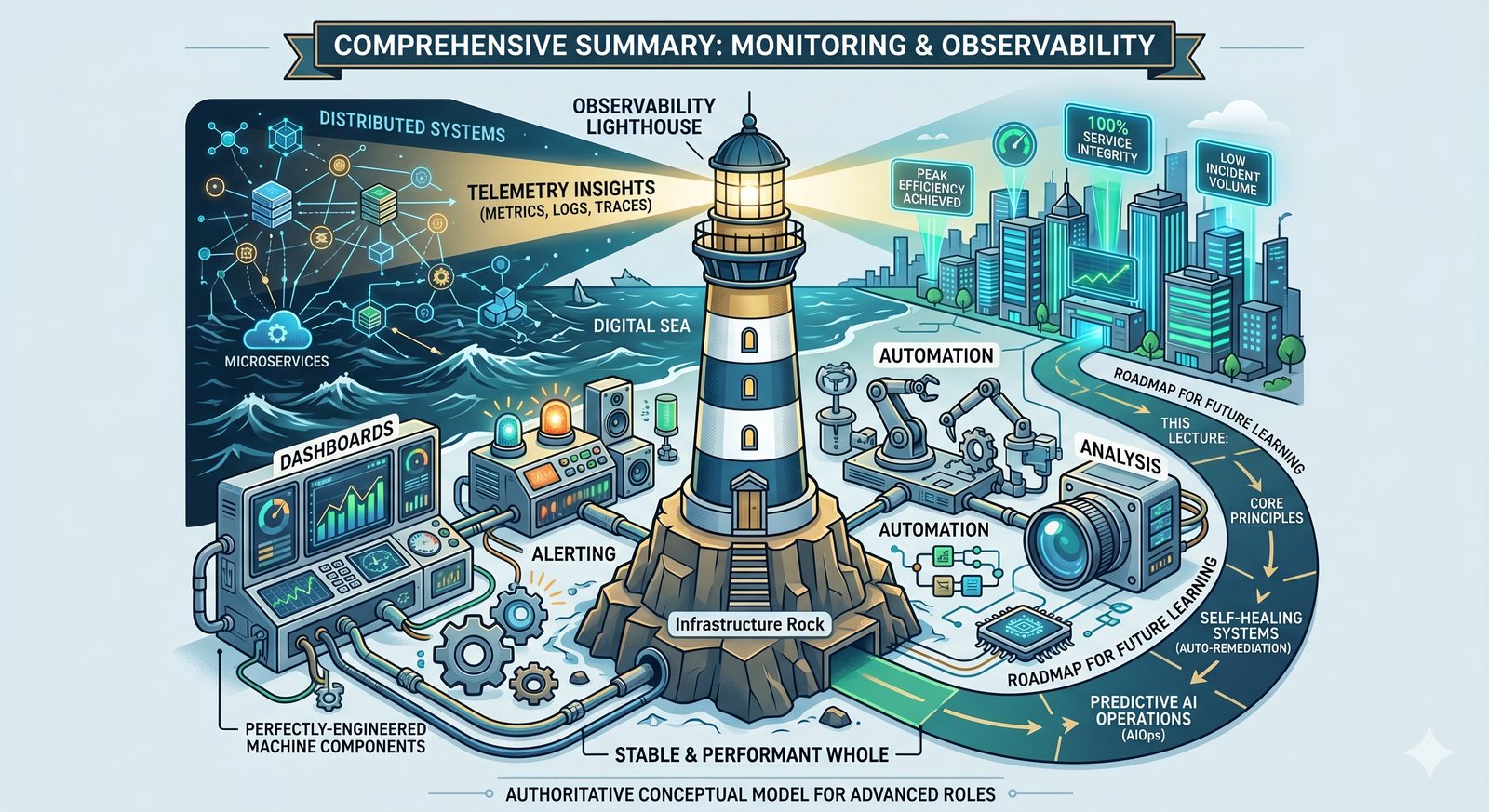

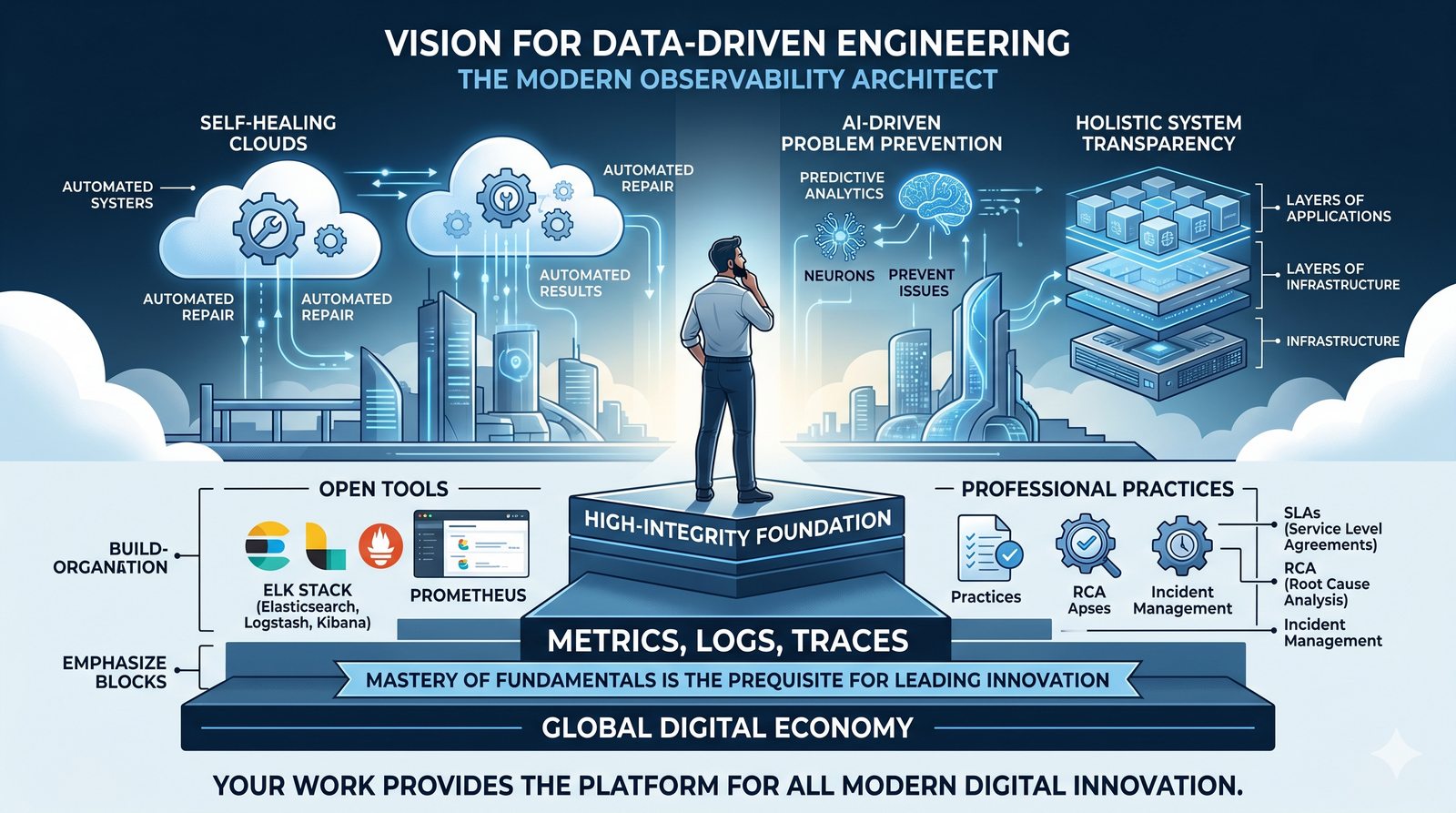

Monitorowanie w IT to proces systematycznego zbierania, analizowania i wizualizowania danych o stanie i wydajności systemów komputerowych, sieci i aplikacji. Jego głównym celem jest zapewnienie, że usługi działają zgodnie z oczekiwaniami, oraz proaktywne wykrywanie problemów, zanim wpłyną one na użytkowników końcowych. Skuteczne monitorowanie pozwala na szybką identyfikację przyczyn awarii, optymalizację wydajności oraz planowanie przyszłej rozbudowy infrastruktury. Jest to fundamentalna praktyka, bez której zarządzanie złożonymi, nowoczesnymi środowiskami IT byłoby niemożliwe.

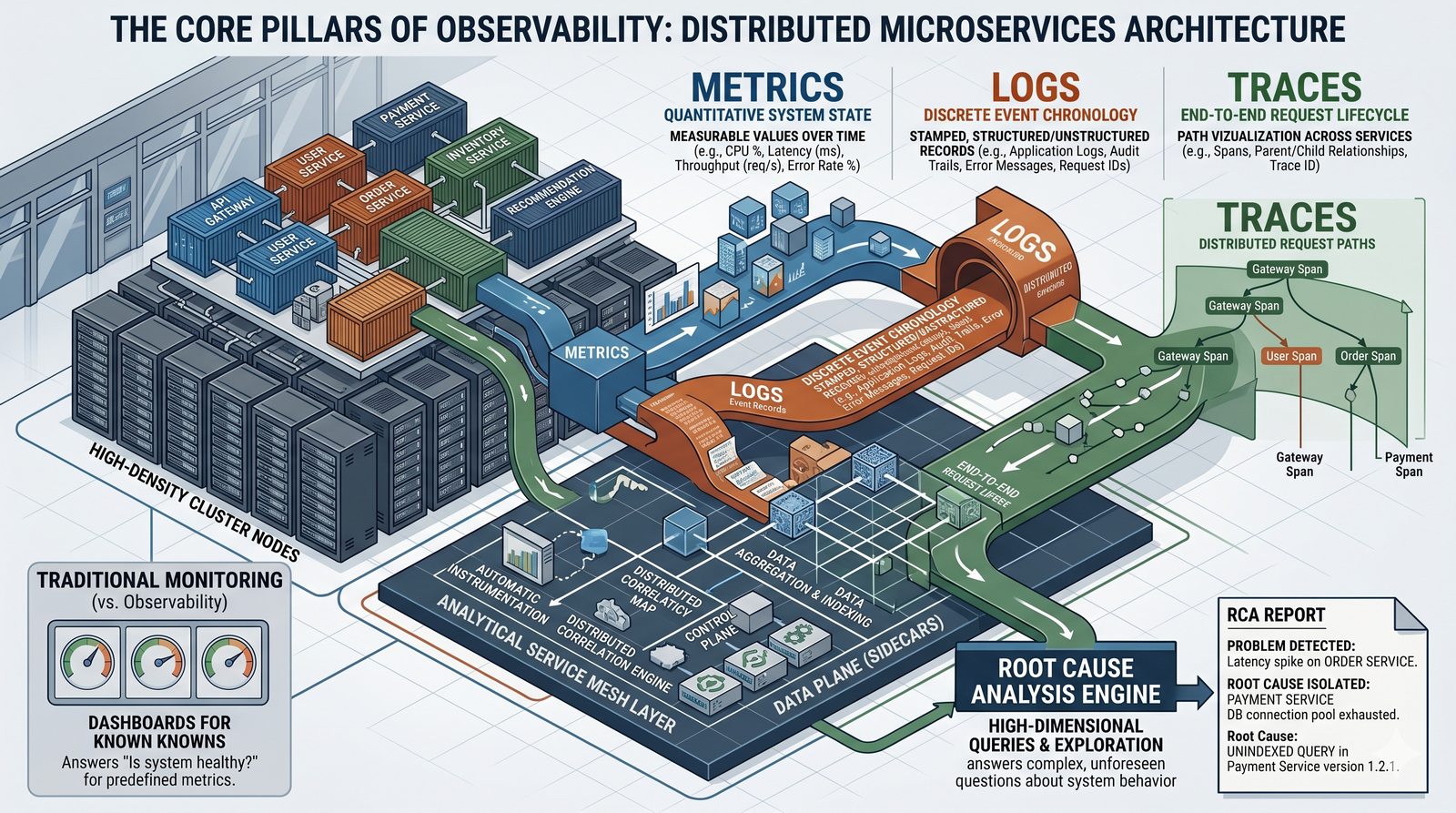

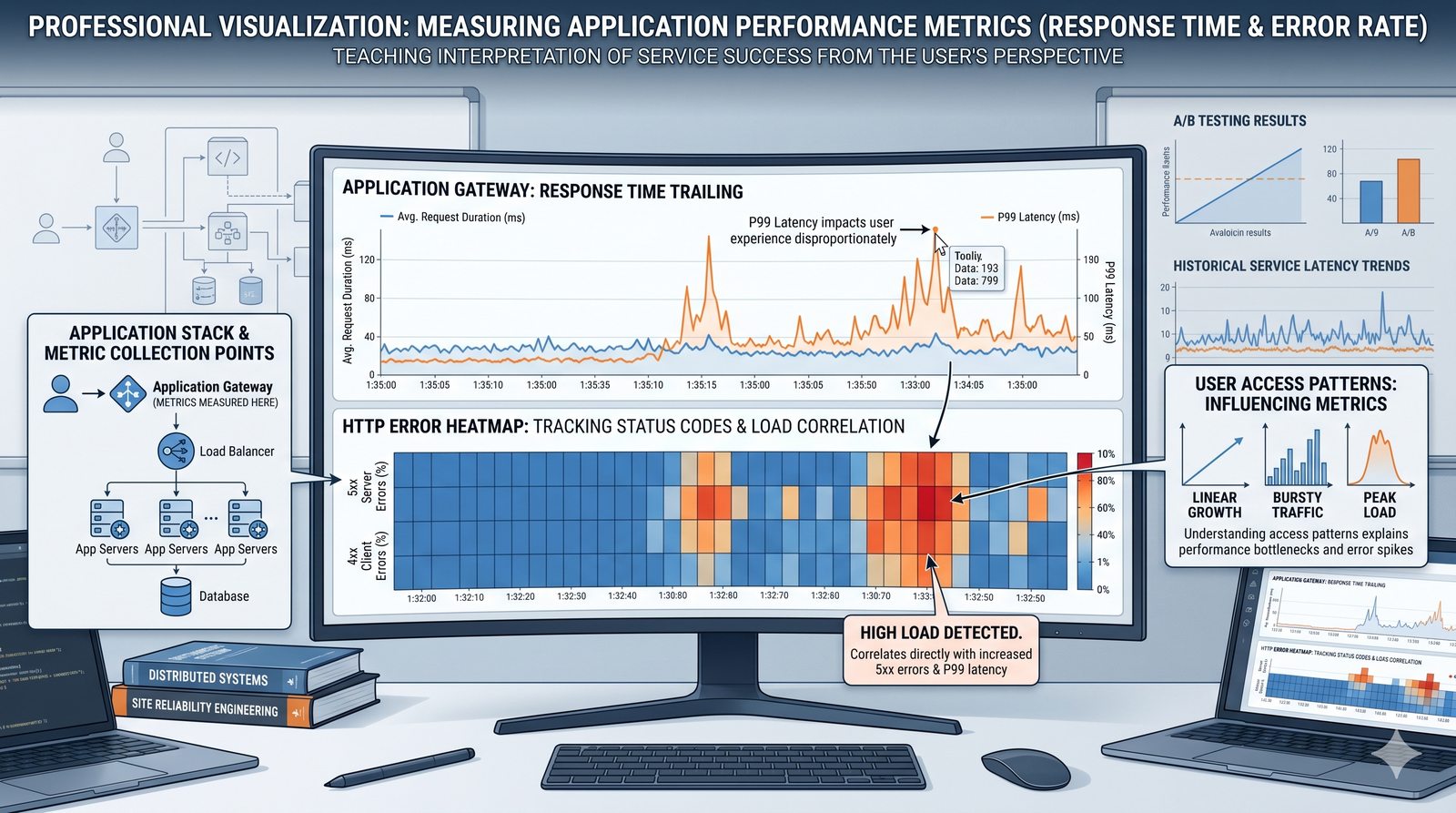

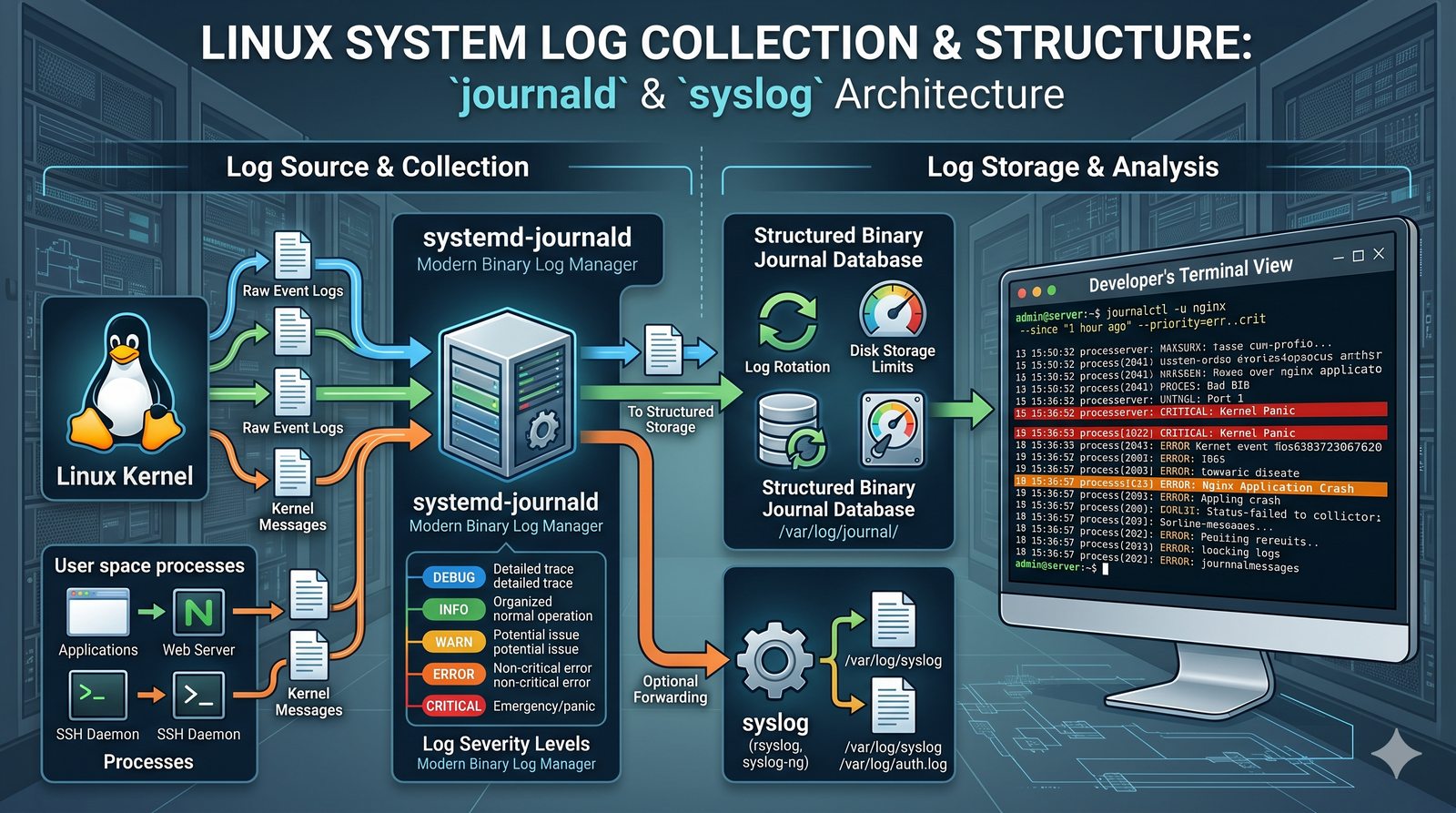

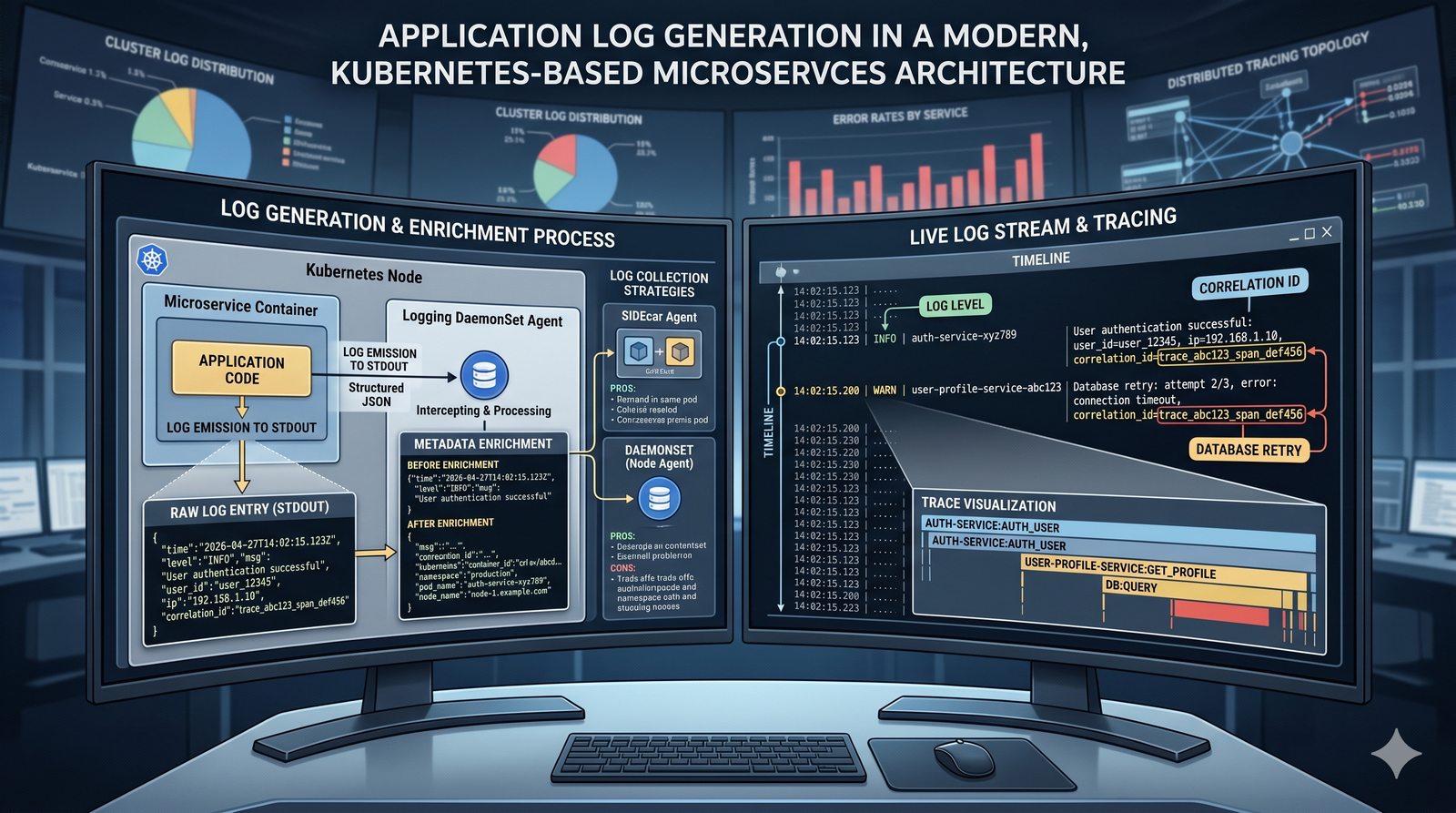

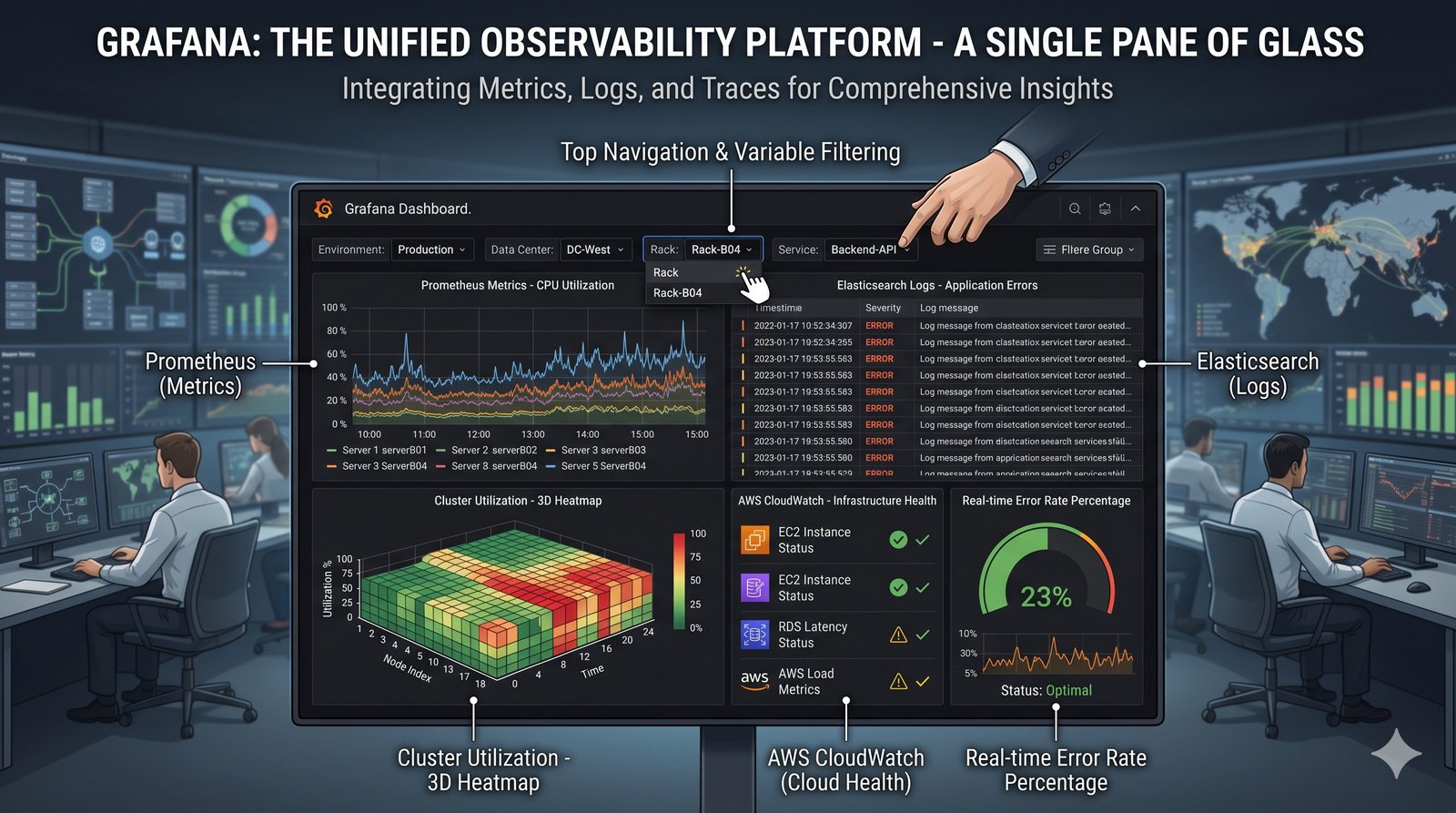

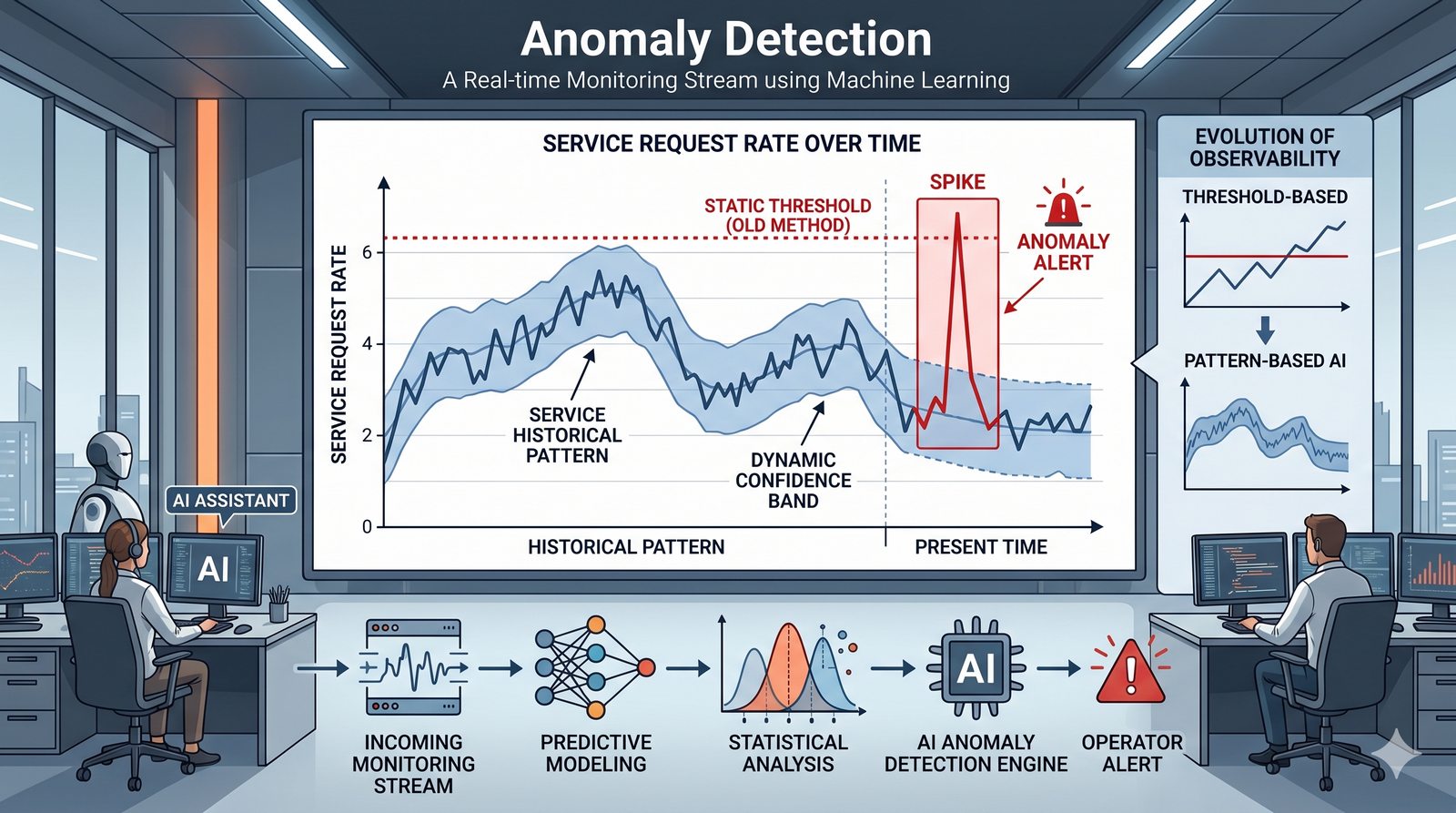

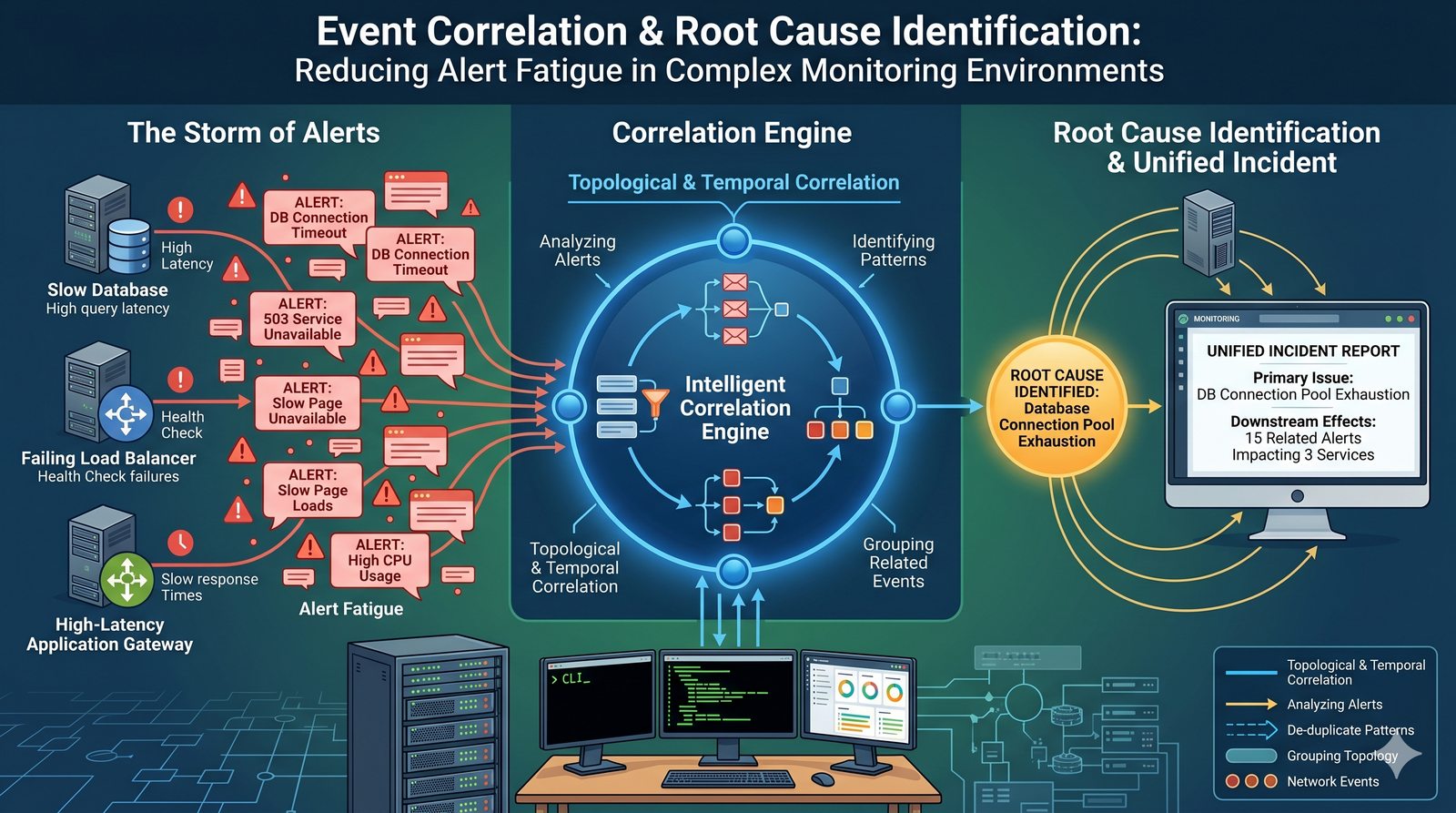

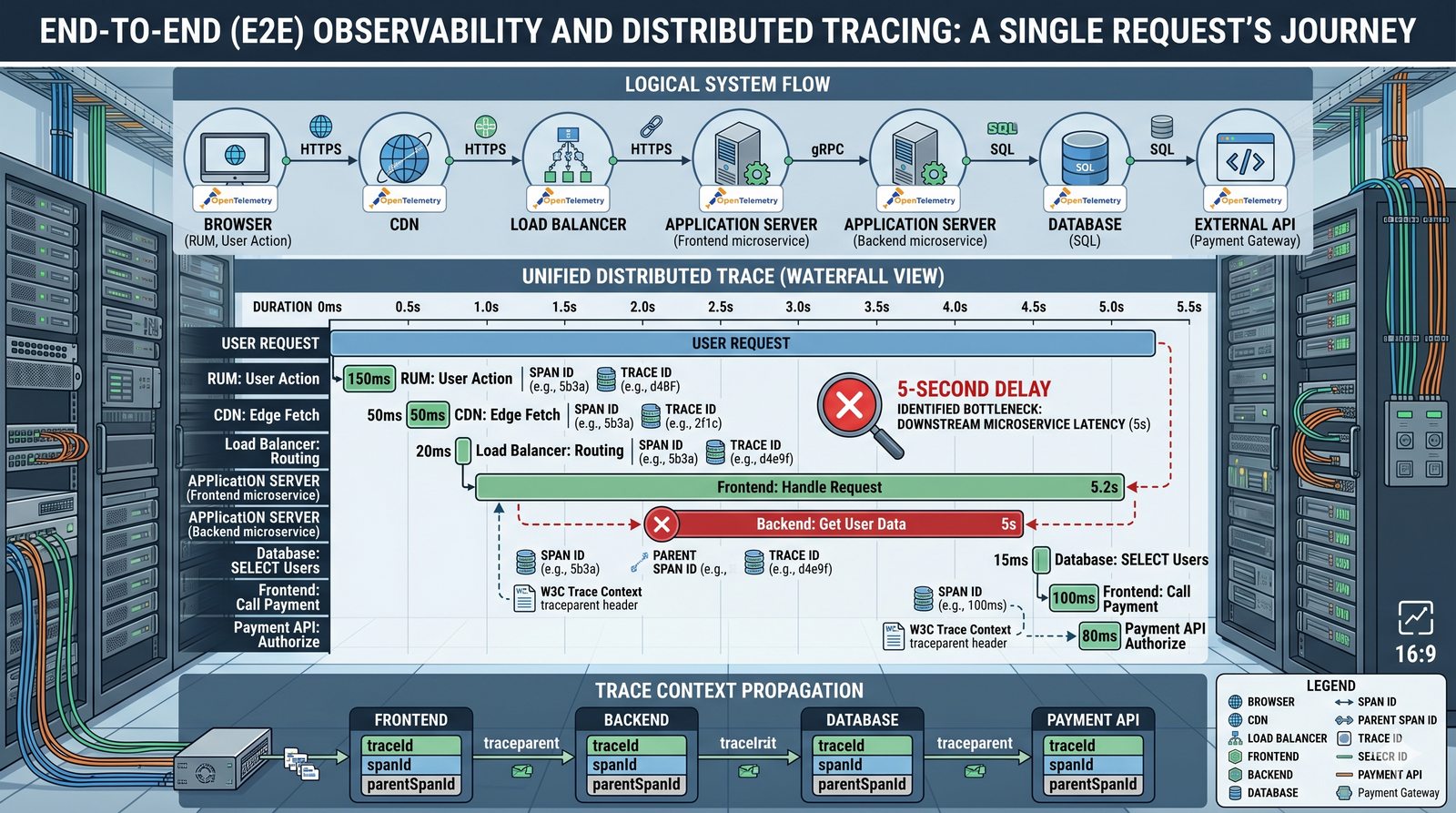

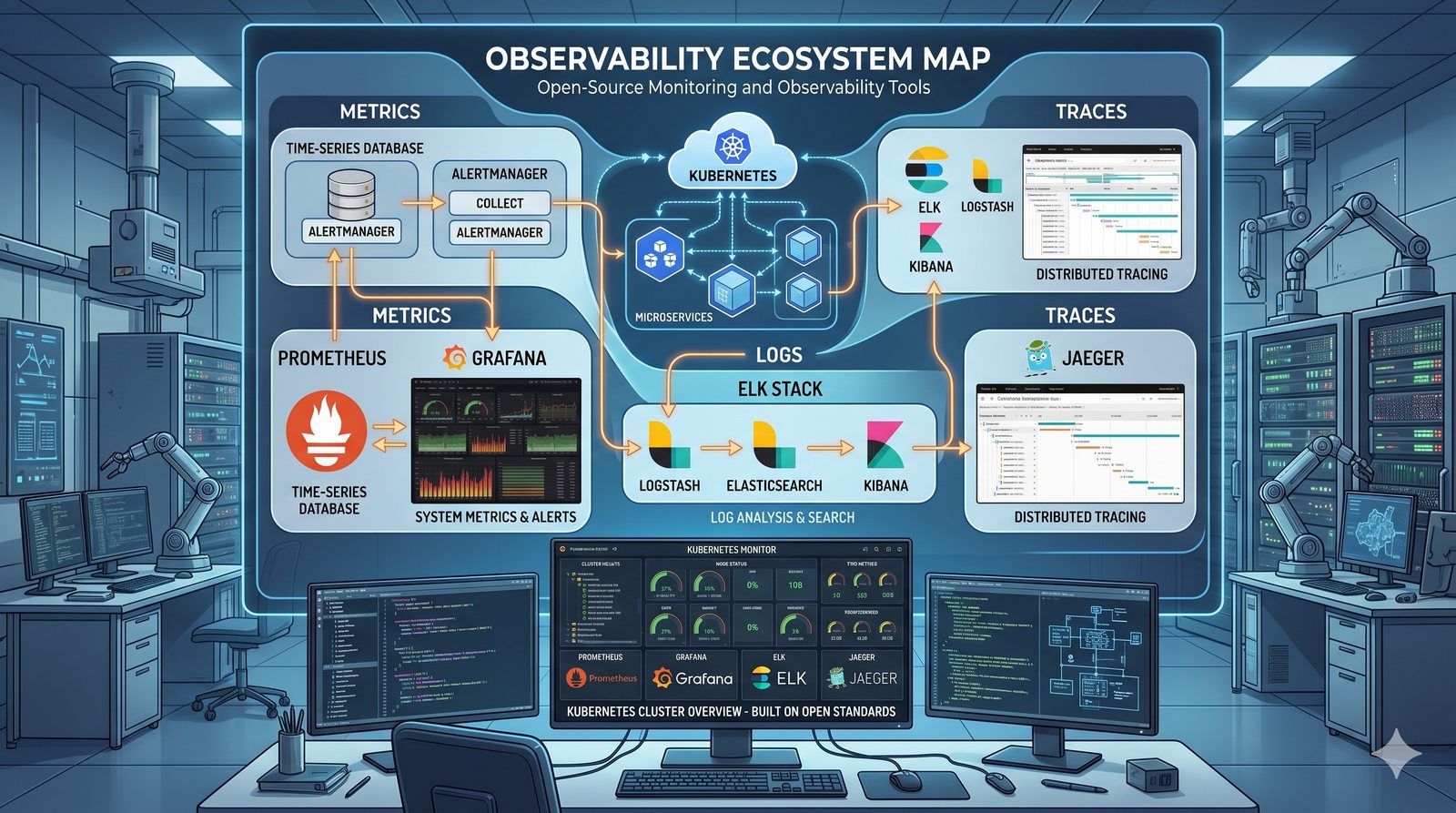

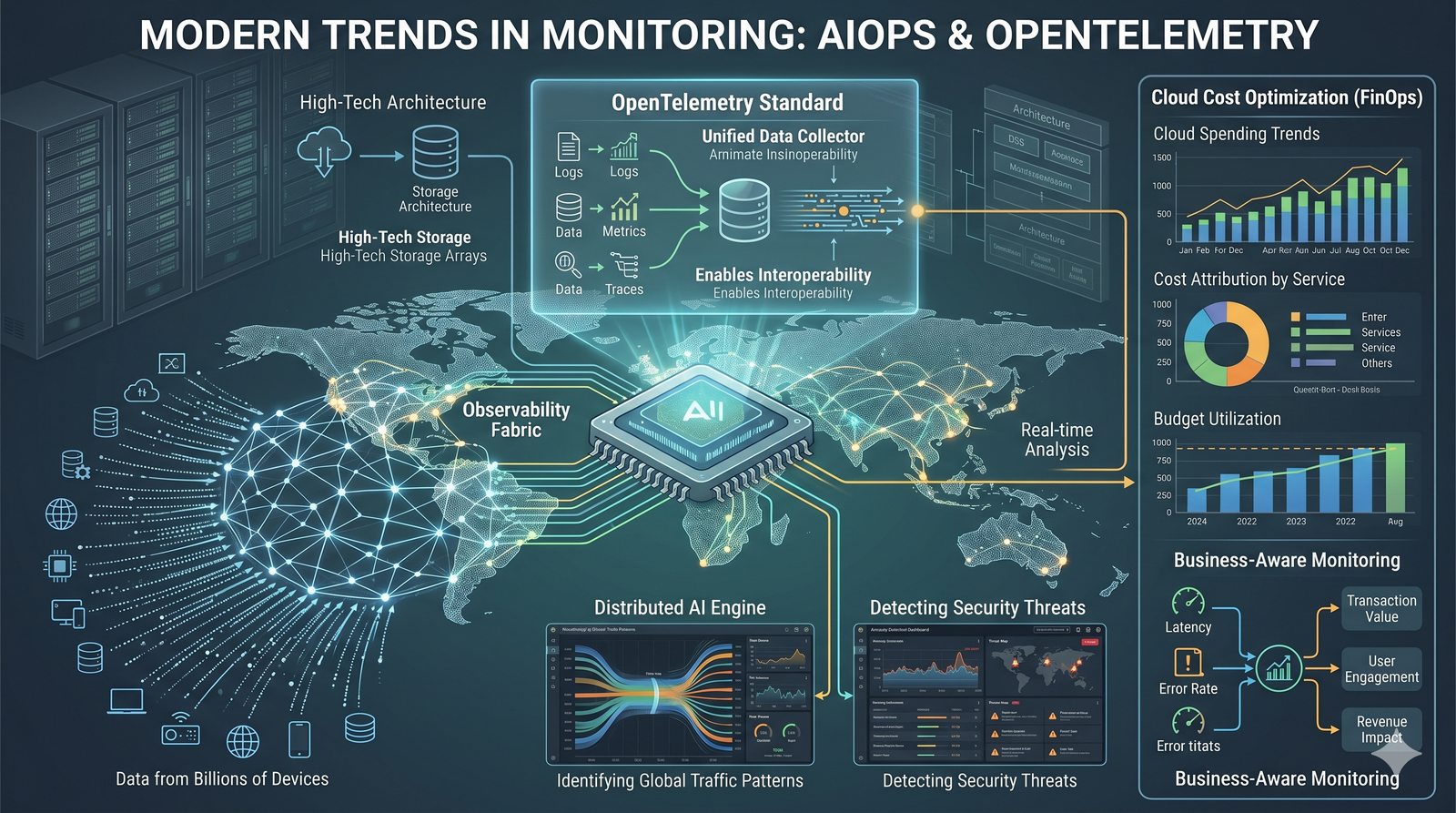

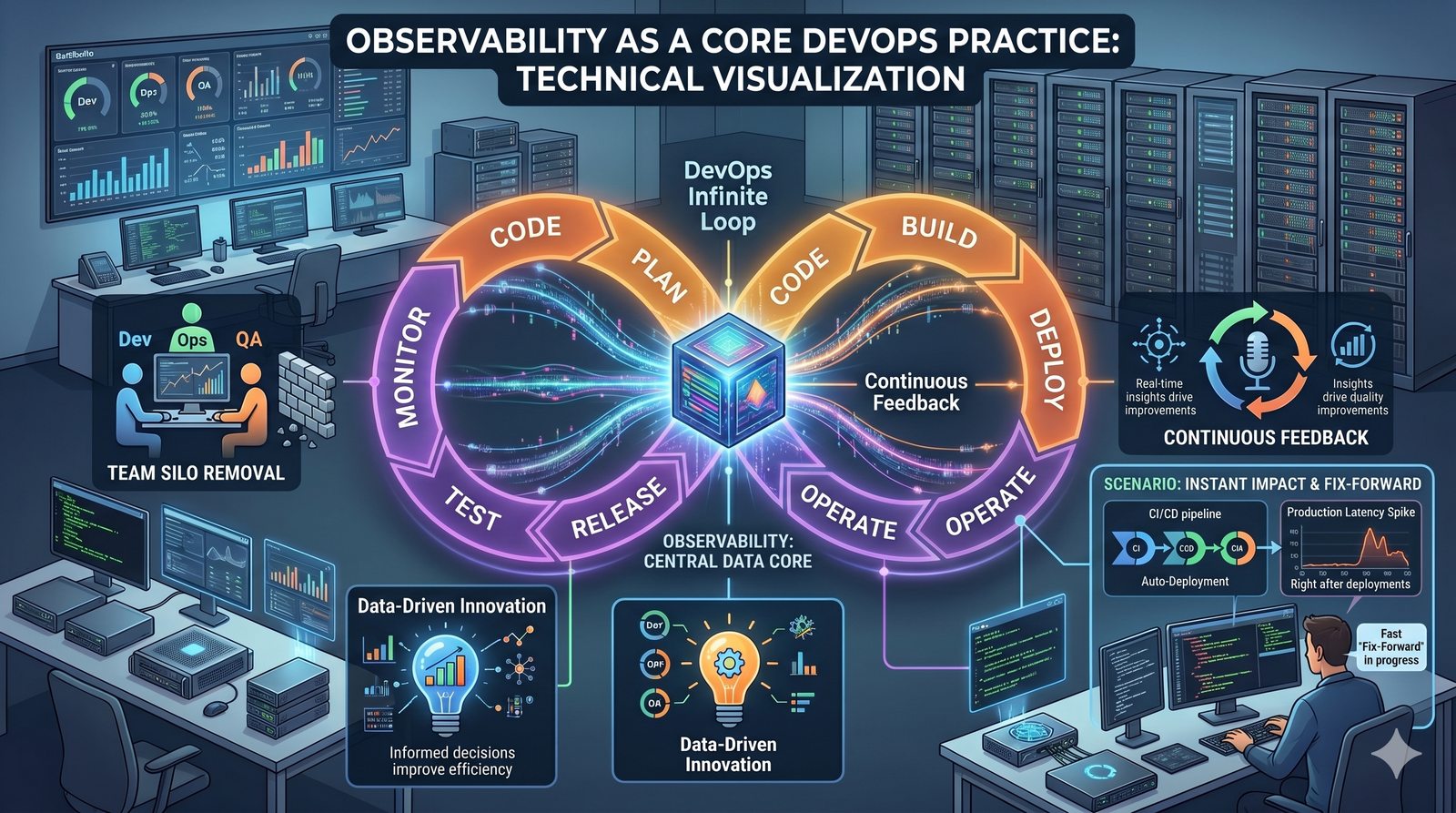

Obserwowalność (observability) to ewolucja tradycyjnego monitoringu, szczególnie istotna w kontekście złożonych, rozproszonych systemów, takich jak mikroserwisy. Podczas gdy monitoring skupia się na zbieraniu z góry zdefiniowanych metryk (np. użycie CPU), obserwowalność polega na projektowaniu systemów w taki sposób, aby emitowały one bogate dane telemetryczne (logi, metryki, ślady), które pozwalają na zadawanie dowolnych pytań o ich wewnętrzny stan i zachowanie, nawet w przypadku nieprzewidzianych problemów. Obserwowalność pozwala nie tylko stwierdzić, że "coś jest nie tak", ale także zrozumieć "dlaczego".